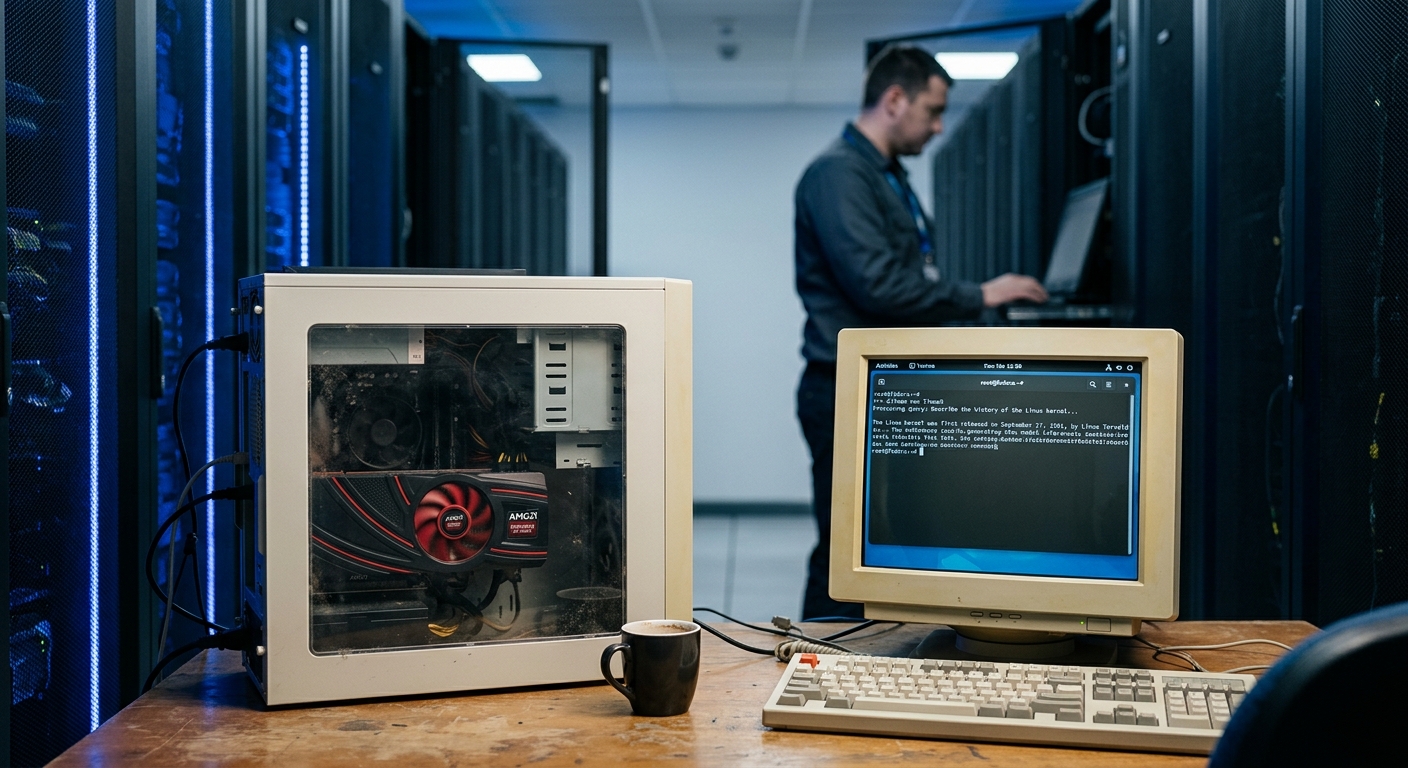

LLM local sur une carte graphique de 2017 : AMD RX 580 + Vulkan + Ollama

La carte graphique AMD RX 580 de 2017 peut faire tourner des modèles de langage modernes grâce à Vulkan. Sans la complexité de ROCm, utilisez Vulkan simplement

L'IA locale est devenue une réalité même pour le matériel ancien. AMD RX 580, une carte graphique de 2017, est capable d'exécuter des modèles de langage modernes sur un ordinateur local à une vitesse de 15–35 tokens par seconde. Pas de cloud, pas d'API, pas d'abonnements — de la pure IA locale sur une machine oubliée dans un tiroir.

Vulkan au lieu de ROCm ROCm — le support officiel d'AMD pour

l'accélération GPU — crée souvent des problèmes sur Fedora : installation complexe, incompatibilités de versions, lacunes dans la documentation. Vulkan offre une alternative : c'est une API graphique standard disponible partout, fonctionnant sans tracas. Ollama supporte Vulkan, et cela change la donne — plus besoin de se battre avec ROCm. Une vitesse de 15–35 tokens par seconde est tout à fait réaliste pour une carte graphique de 2017. Cela ne rivalise pas avec les GPU modernes comme la RTX 4090, mais c'est suffisant pour une utilisation locale : exécuter Llama 3.1, DeepSeek, Qwen 3.5, expérimenter avec des modèles, intégrer dans vos propres applications sans APIs cloud.

Comment mettre en place une pile d'IA locale

Le processus est étonnamment simple : Installez Ollama — un lanceur minimaliste de modèles pour n'importe quel OS Exécutez Open WebUI — une interface web pour interagir avec les modèles Connectez n8n — une plateforme pour l'automatisation et les flux de travail complexes Chargez n'importe quel modèle ouvert — Llama 3.1, DeepSeek V2, Qwen 3.5 Vulkan est automatiquement utilisé par Ollama si la carte graphique est compatible. Sur Fedora, tout fonctionne prêt à l'emploi — aucune configuration supplémentaire nécessaire.

Performance réelle

Sur AMD RX 580 vous obtiendrez : Llama 3.1 70B avec quantification : ~20 tokens par seconde DeepSeek V2 : ~18 tokens par seconde * Qwen 3.5 32B : ~32 tokens par seconde Cela suffit pour une utilisation interactive — vous n'obtiendrez pas une réponse instantanée comme dans ChatGPT, mais un résultat entièrement prêt arrivera en 5–15 secondes. Pour le traitement par lots de centaines de textes, la vitesse n'a aucune importance. Plus : confidentialité totale. Toutes les données restent sur votre machine, aucune demande à OpenAI, Anthropic ou autres services cloud.

Ce que cela signifie L'IA locale n'est plus un privilège des propriétaires de matériel premium.

Une vieille carte graphique qui restait inutilisée devient soudainement un outil utile pour le développement et les expériences. Cela ouvre la porte à une IA privée, à des expériences indépendantes des services cloud et à l'intégration de modèles directement dans vos propres projets.