Plusieurs LLM dans un même chat Telegram : comment combiner Groq et Google AI

Un développeur a créé un bot Telegram dans lequel plusieurs modèles LLM fonctionnent simultanément dans un même chat en se faisant passer pour des employés d'un

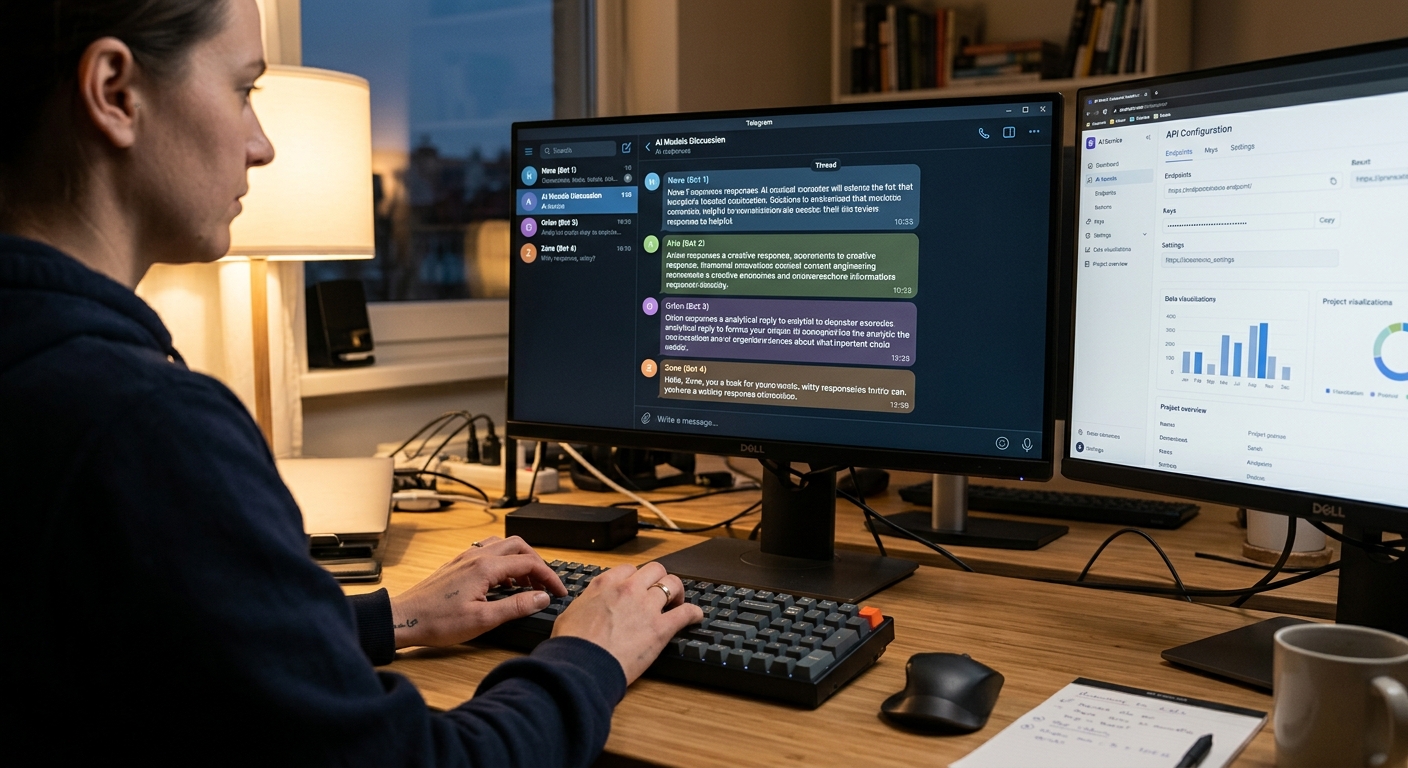

Un développeur de Habr a créé un amusant bot Telegram dans lequel plusieurs modèles LLM travaillent simultanément dans un seul chat, et chacun prétend être un employé d'une entreprise. L'idée a émergé comme une blague lors d'une réunion entre amis, mais s'est rapidement transformée en un cas technique intéressant sur l'intégration de plusieurs modèles en utilisant uniquement des APIs gratuites.

Comment

Mettre Plusieurs Modèles Différents dans Un Seul Chat

Le concept original était simple et léger : créer un chat où plusieurs réseaux de neurones « travaillent » simultanément, pensant qu'ils sont de véritables employés d'entreprise. Chaque modèle reçoit son propre rôle et son historique, et l'utilisateur peut basculer entre eux à tout moment, posant la même question à différents LLMs. Ce n'est pas simplement des tests parallèles — c'est une tentative de faire apprendre aux réseaux de neurones et respecter leurs personas au sein d'un dialogue unique.

Où Obtenir des APIs Gratuitement

La première tâche pratique était banale mais critique : trouver un ensemble d'outils avec des limites gratuites décentes. Le développeur a mené une recherche et s'est décidé pour trois options principales :

- Groq — pour LLama avec une vitesse d'inférence record

- Google AI Studio — pour Gemma et Gemini avec des tiers gratuits décents

- De simples requêtes HTTP pour l'intégration entre les composants

Au stade initial, le code s'avéra être relativement simple : sélection de modèle par commande utilisateur, redirection de la requête vers l'API nécessaire, insertion de la réponse dans le contexte général du chat. La logique était minimale ; la complexité résidait dans la gestion de l'état et du contexte pour chaque modèle simultanément.

Quand un Modèle Oublie Qui Il Est

Bientôt, un problème amusant mais persistant a émergé : lors du basculement entre modèles, l'un d'eux refusait de céder la parole et prétendait simplement être l'autre, perdant complètement son identité. Le développeur a résolu la plupart du problème par le biais d'un prompt système bien pensé qui « rappelle » explicitement à chaque modèle qui il devrait être dans ce dialogue. Cependant, ils n'ont pas pu éliminer complètement le problème. Les modèles se confondent encore parfois sur leurs rôles, en particulier dans les dialogues longs multi-tours. Selon les observations du développeur, c'est une limitation fondamentale des LLMs eux-mêmes : ils génèrent bien du texte et copient le style, mais perdent souvent l'identité contextuelle lors des changements d'attention.

Ce Que Cela Signifie

Le cas démontre qu'une interface multi-modèles peut être assemblée même avec des APIs gratuites si vous investissez dans l'architecture et le prompting. La fiabilité totale dans la gestion du contexte et de l'identité n'est pas encore réalisable, mais pour l'expérimentation, le prototypage et l'apprentissage, c'est plus que suffisant.