Alibaba, Baidu et Huawei s'éloignent de Nvidia au profit de leurs propres accélérateurs AI

Alibaba, Baidu et d'autres géants chinois augmentent la production de leurs propres accélérateurs AI. C'est un choix stratégique visant à garantir l'indépendanc

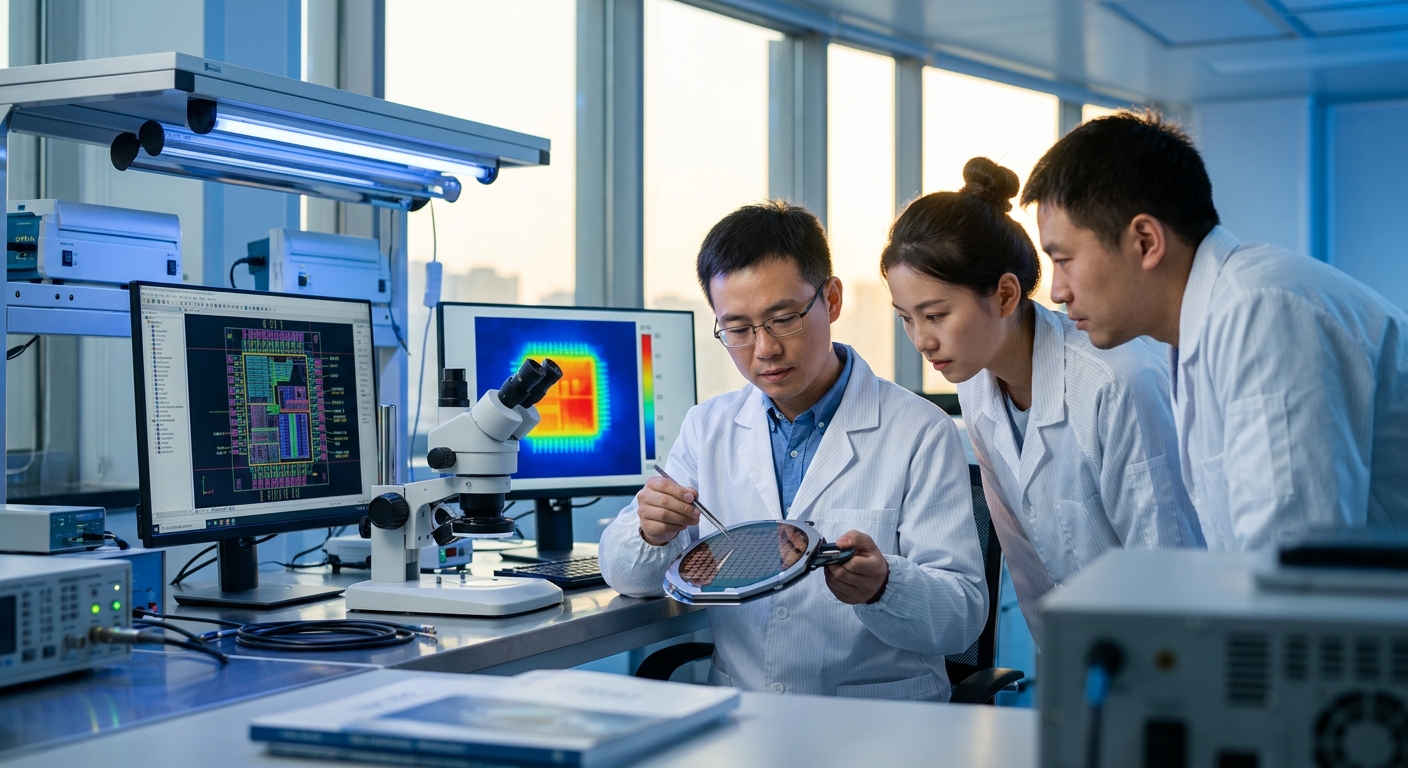

Les géants chinois de l'informatique Alibaba, Baidu et Huawei augmentent activement leur propre production d'accélérateurs d'IA. Ceci se fait malgré les rumeurs sur le possible retour de Nvidia sur le marché chinois et fait partie d'une stratégie d'indépendance technologique.

Pourquoi la transition s'est accélérée

Les sanctions occidentales sur l'exportation de puces informatiques avancées ont forcé la Chine à investir dans ses propres solutions. Nvidia, le principal fournisseur de GPU pour l'IA, est pratiquement inaccessible à la région en raison des restrictions américaines. Construire des systèmes d'apprentissage automatique sans dépendance à la technologie américaine est désormais une question non seulement économique, mais de souveraineté technologique. Même si les États-Unis rendent Nvidia au marché, les entreprises comprennent : dépendre d'équipements étrangers est risqué.

Qui augmente les capacités

Les plus grandes entreprises chinoises ont investi des dizaines de milliards de yuans dans le développement de leurs propres accélérateurs d'IA :

- Alibaba — gamme Dharma et Yitian, déjà intégrée aux services cloud Aliyun

- Baidu — série Kunlun quatrième génération, fonctionne dans ses propres centres de données

- Huawei — Ascend, utilisé dans le cloud et les processeurs mobiles Kirin

- Tencent — développements pour les systèmes de recommandation et les tâches PNL

- ByteDance — investissements dans des startups spécialisées et ses propres puces

Chaque entreprise optimise pour ses propres tâches : Alibaba pour le commerce électronique et le cloud, Baidu pour la recherche et LLM, Huawei pour la mobilité.

La technologie locale devient compétitive

Les accélérateurs chinois ont déjà atteint un processus de 5 nanomètres et se rapprochent de Nvidia A100 en performance. L'architecture s'est stabilisée, les équipes d'ingénierie ont acquis de l'expérience et les coûts de développement baissent le long de la courbe d'apprentissage. Ce ne sont plus des copies primitives — ce sont des solutions entièrement compétitives optimisées pour les piles locales et les exigences. En parallèle, l'écosystème se développe : frameworks (MindSpore, PaddlePaddle), outils d'optimisation, drivers. Si l'année dernière les développeurs se demandaient comment le code s'exécuterait sur une puce chinoise, il y a maintenant des solutions prêtes à l'emploi.

«

Nous ne copions pas simplement Nvidia, nous construisons un système adapté aux exigences et à l'échelle chinoise », décrivent les analystes locaux la position.

Ce que cela signifie

Le marché mondial du matériel IA se fragmente. Nvidia perd son monopole sur le plus grand marché asiatique, mais ce n'est pas son effondrement — c'est normal pour toute technologie : les acteurs locaux finissent par combler le déficit critique de la chaîne d'approvisionnement. Pour les entreprises occidentales, cela signifie que le contrôle stratégique sur le « matériel » n'est plus une garantie de domination. Pour les chercheurs, cela signifie que les modèles d'IA seront désormais entraînés sur différentes architectures, ce qui pourrait conduire à de nouvelles optimisations et compromis. Le processus sera long — pas en un ou deux ans — mais irréversible.