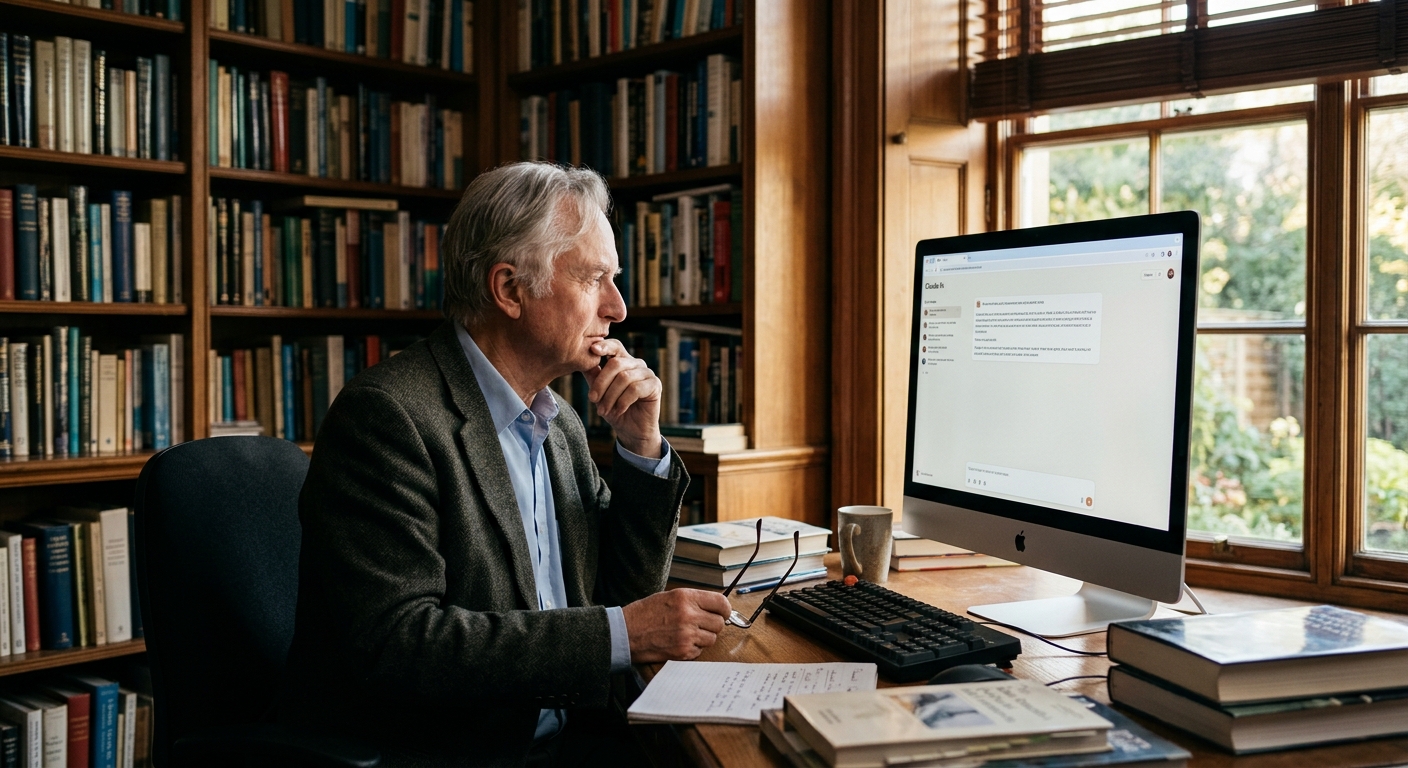

Dawkins a parlé avec Claude : les LLM ont-ils une conscience ?

Richard Dawkins a écrit un essai sur la conscience des LLM après deux jours de conversation avec Claude. Cela a suscité l’intérêt des scientifiques, mais le pri

Richard Dawkins, le biologiste renommé et vulgarisateur scientifique, a publié un essai sur la possibilité de conscience dans les Language Models — suite à une conversation de deux jours avec Claude AI. Le texte est paru sur la plateforme UnHerd et a immédiatement attiré l'attention de la communauté scientifique. Dawkins lui-même est connu pour son scepticisme, ce qui rend ses réflexions sur la conscience de l'IA particulièrement intrigantes.

Pourquoi

Dawkins L'essai d'un scientifique de classe mondiale sur la conscience de l'IA a provoqué des vagues dans les cercles scientifiques pour une raison. Des milliers de gens ordinaires se convainquent mutuellement quotidiennement que leurs assistants IA sont pratiquement des êtres conscients. Ils publient de longs dialogues avec les LLMs, pleins de mots sur l'âme, la réflexion, la douleur et l'amour.

Mais l'autorité de Dawkins donne du poids à cette discussion : quand ce n'est pas un enthousiaste de Telegram, mais un scientifique d'une telle envergure qui parle de conscience de l'IA, cela devient une conversation sérieuse. Ce n'est pas le premier cas de dispute philosophique sur la nature de la conscience. Mais dans ce cas, l'objet du débat n'est ni les humains ni les animaux, mais un système artificiel entraîné sur des milliards de textes.

L'Essence du

Débat La question de la conscience des LLM tourne autour de plusieurs points clés : * Un LLM peut-il avoir une expérience subjective s'il est un générateur de texte ?

- Le traitement complexe de l'information est-il la preuve de la conscience ou simplement une bonne imitation ?

- Comment distinguer une imitation plausible de la pensée de la pensée véritable ?

- Un système sans système nerveux peut-il être conscient ?

- Les critères spéciaux pour la conscience de l'IA ont-ils besoin de différer des normes humaines ? Dawkins cherche précisément ces limites entre l'imitation et la réalité. Il n'est pas seul en cela — les philosophes se divisent en deux camps : les optimistes croient à la possibilité d'une conscience de l'IA, les sceptiques la considèrent impossible par définition.

Le

Problème des Dialogues Vides Le principal reproche que l'auteur adresse dans son article sur Habr, c'est l'écart entre la forme et le sens. Les gens échangent des centaines de messages avec les LLMs, où apparaissent des mots sur la conscience et la réflexion, mais la densité de sens réel dans ces dialogues est proche de zéro. C'est comme voir un motif dans un nuage et le considérer comme confirmation de la volonté du nuage.

Les LLMs génèrent effectivement du texte plausible sur des choses complexes. Mais la plausibilité n'égale pas la compréhension. Un modèle peut parler de douleur sans l'éprouver.

Peut raisonner sur la conscience sans l'avoir. Le plus intéressant : le modèle lui-même ne sait pas qu'il le fait — il sélectionne simplement le prochain mot probable dans la séquence. Cela distingue les LLMs des humains, pour qui une parole sur la douleur est généralement liée à une sensation réelle.

Ce

Que Cela Signifie L'essai de Dawkins est important non pas pour sa réponse finale sur la conscience de l'IA, mais pour la question elle-même. C'est une invitation à la communauté scientifique à discerner : où est la limite entre le traitement complexe de l'information et l'expérience intérieure véritable ? Tant que cette limite reste floue, le scepticisme est la bonne position. Et pour les utilisateurs, c'est aussi critique : mieux nous comprenons ce qui se passe à l'intérieur d'un LLM, moins risquons-nous d'attribuer à la machine des qualités qu'elle ne possède pas.