Thinking Machines crée une AI qui parle et écoute en même temps

Thinking Machines travaille sur une AI qui écoute et répond en même temps, comme lors d'une conversation téléphonique. Les modèles classiques fonctionnent de ma

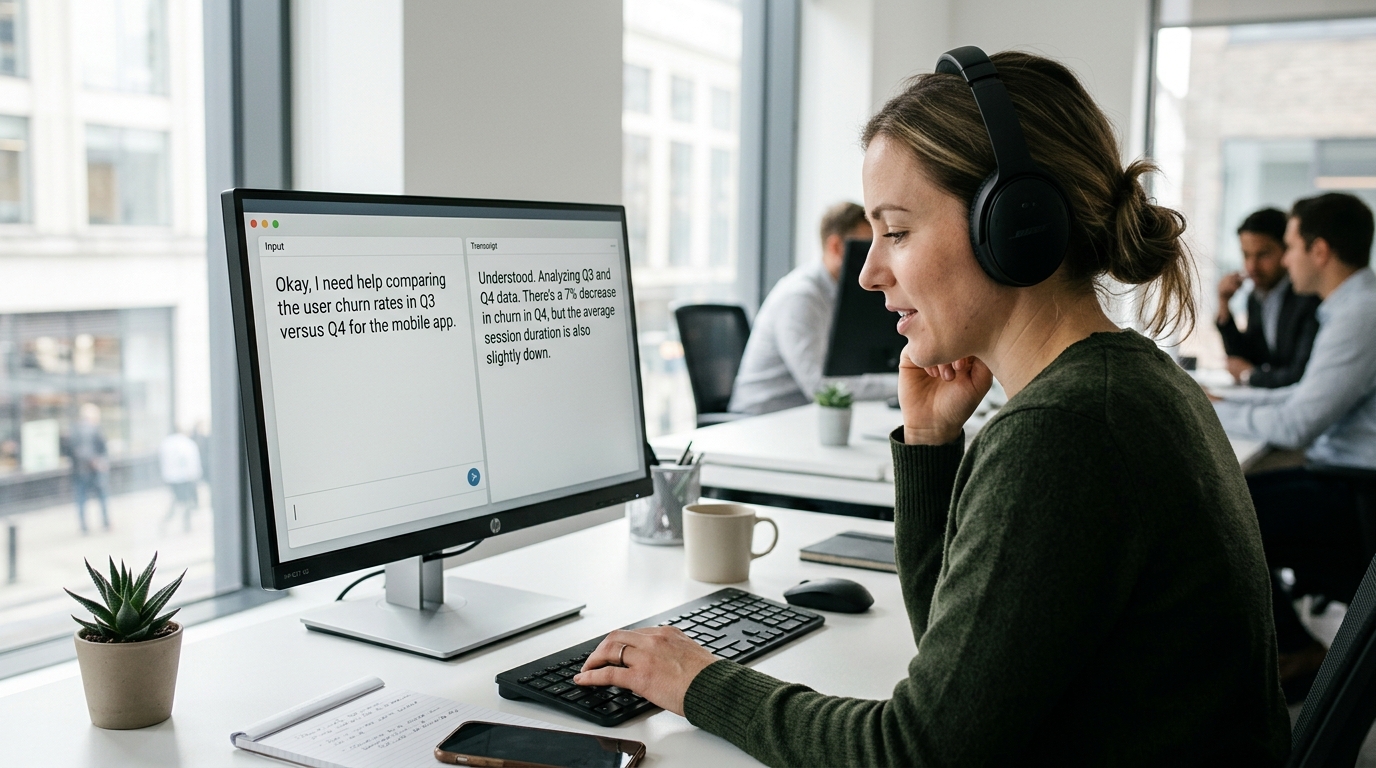

Actuellement, chaque modèle d'IA fonctionne selon un seul principe : vous écrivez, le modèle écoute. Vous attendez, le modèle répond. Thinking Machines essaie de changer cela en créant une architecture qui traite votre message et génère une réponse simultanément — comme une conversation téléphonique normale.

Le Problème de l'Approche Actuelle

Tous les modèles de langage modernes — de ChatGPT à Claude — fonctionnent selon le principe requête-réponse. Vous envoyez un message complet, le modèle le traite complètement, puis génère une réponse complète. Cela crée la sensation que vous parlez à un robot, non à une personne.

Dans une vraie conversation, c'est différent. Les gens écoutent tout en générant une réponse. Vous pouvez interrompre quelqu'un, clarifier un détail, ajouter du contexte — et la personne réagit à la volée, sans recommencer de zéro. Personne n'attend que l'autre personne termine un discours complet pour complètement repenser sa réponse.

Cela crée un flux naturel et organique du dialogue. L'approche actuelle de l'IA établit une limite rigide : entrée terminée → traitement → sortie terminée. Il n'y a pas de flexibilité, pas d'adaptation pendant le processus, pas de sensation de communication bidirectionnelle.

Ce que Fait Thinking Machines

La startup développe un modèle qui traite le flux d'entrée en temps réel et génère simultanément un flux de sortie. Au lieu d'attendre l'entrée complète, le système commence à répondre pendant qu'il reçoit des informations de l'utilisateur. Cela ouvre plusieurs possibilités fondamentalement nouvelles :

- Écoute pendant la réponse — réagir à de nouvelles données sans recharger le contexte

- Interruptions naturelles — interrompre, comme dans un dialogue vivant entre personnes

- Adaptation d'intonation — changer le ton en réaction aux signaux vocaux en temps réel

- Signaux non verbaux — tenir compte des gestes et des expressions faciales dans les conversations vidéo

- Latence minimale — pas de pauses mortes entre les échanges

Pour les assistants vocaux, c'est critique. Quand vous appelez un centre d'appels ou commandez un taxi par la voix, vous ne voulez pas attendre 3–5 secondes de traitement. Vous parlez — l'assistant entend et répond immédiatement, comme une personne.

La Complexité Architecturale du Problème

Le traitement simultané de l'entrée et la génération de la sortie sont une refonte architecturale profonde. Les Transformers, sur lesquels reposent presque tous les LLMs modernes, sont conçus pour un fonctionnement séquentiel : lire tout le contexte, générer les jetons un par un. Modifier ce principe fondamental signifie réécrire la mécanique de l'attention, du cache et de la prédiction.

Vous devez maintenir un contexte croissant du flux d'entrée tout en générant simultanément la sortie, sans perdre la cohérence et la logique de la réponse. Les défis pratiques ne sont pas moins graves : la qualité des réponses (ne deviennent-elles pas précipitées et incomplètes ?), la latence (une latence minimale est nécessaire pour la naturalité), la gestion de la mémoire pour les flux croissants. Comment gardez-vous le fil de la conversation si la réponse s'exécute en parallèle avec l'entrée ? Comment ne pas perdre un détail à la fin d'un message si vous avez déjà commencé à répondre au début ?

Ce Que Cela Signifie

Si cette approche réussit, le dialogue avec l'IA ne semblera plus être une interaction avec un système. Ce sera un dialogue — une vraie conversation, sans la sensation de rigidité et de délai, plus proche de la communication humaine.

Pour les assistants vocaux, les chatbots et en particulier les centres d'appels, c'est une amélioration critique. Un client a appelé — l'assistant entend immédiatement et répond, peut interrompre pour clarifier, adapter la réponse en fonction de nouvelles informations. Cela augmentera la satisfaction et la vitesse de résolution des problèmes plusieurs fois.