Gemini 3 Flash: Google учит нейросети не гадать, а всматриваться

Долгое время мультимодальные модели работали как ленивый студент: глянул на картинку один раз и выдал ответ. Если на фото микросхемы не видно серийный номер, не

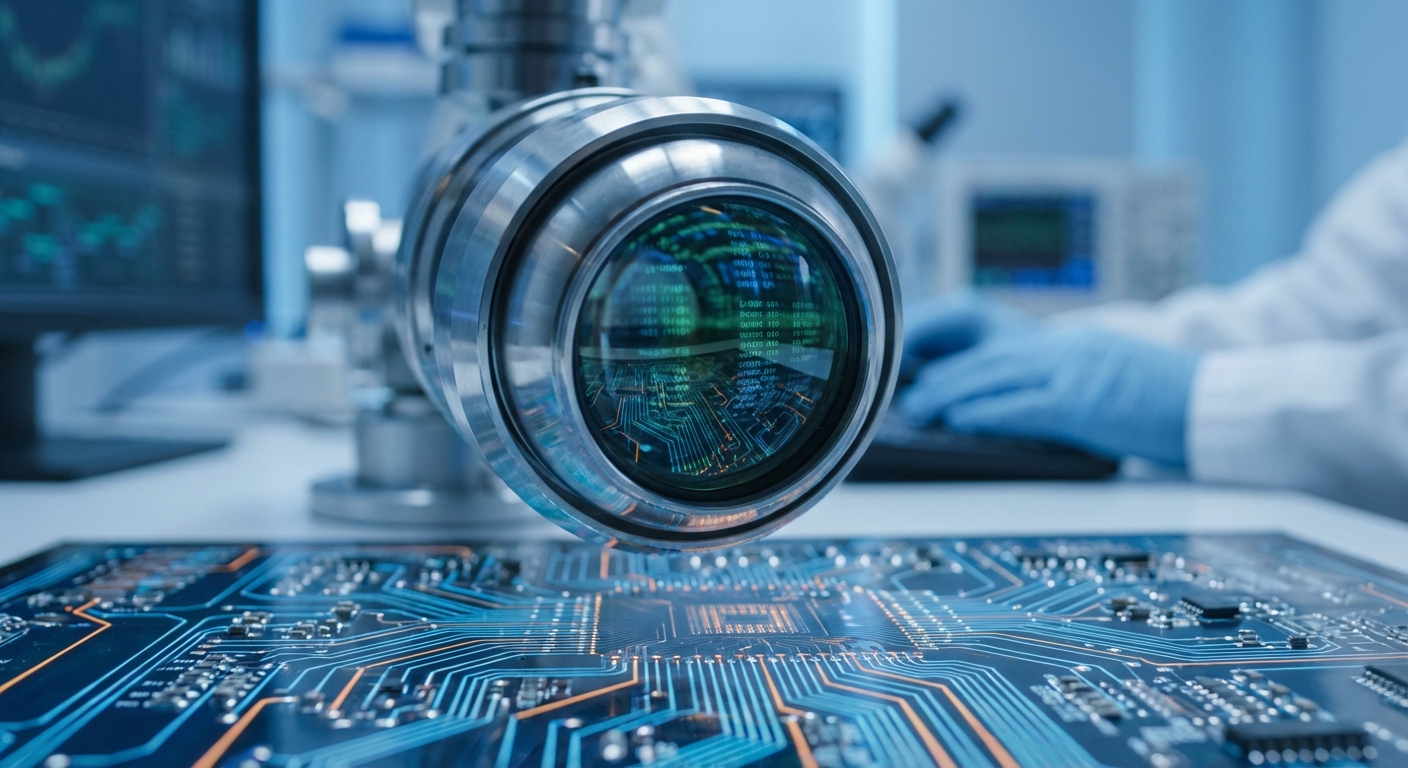

Вы когда-нибудь замечали, как современные нейросети ведут себя при анализе сложных изображений? Это напоминает близорукого человека, который пытается рассмотреть номер автобуса издалека: если он не видит цифры четко, он их просто придумывает, основываясь на контексте. До сих пор даже самые продвинутые мультимодальные модели работали по принципу одного прохода. Они получали картинку, прогоняли её через веса и выдавали результат. Если на чертеже здания затерялся крошечный символ или на материнской плате не читается маркировка чипа, модель не признавалась в поражении. Она галлюцинировала.

Google решила, что пора покончить с этим визуальным легкомыслием. Новая технология Agentic Vision, которую внедрили в Gemini 3 Flash, превращает процесс зрения из пассивного созерцания в активный поиск. Это фундаментальный сдвиг в том, как ИИ взаимодействует с окружающим миром. Вместо того чтобы просто «смотреть», модель теперь умеет «всматриваться». Она понимает границы своего восприятия и, если данных недостаточно для точного ответа, запускает цикл уточнения, используя доступные ей инструменты.

Контекст здесь важнее, чем кажется на первый взгляд. Мы привыкли, что Gemini или GPT-4o могут описать пейзаж или найти котика на фото. Но попробуйте заставить их проанализировать сложную техническую схему или многостраничный юридический документ с мелким шрифтом. Процент ошибок там зашкаливает именно из-за архитектурного ограничения «одного взгляда». Google осознала, что для реального сектора — инженерии, медицины, логистики — точность в 90% не просто бесполезна, она опасна. Поэтому Agentic Vision вводит понятие «активного цикла», где модель сама решает, какой участок изображения нужно увеличить или переснять виртуально, чтобы подтвердить свою гипотезу.

Как это работает на практике? Представьте, что вы даете Gemini 3 Flash фотографию огромного складского стеллажа. Раньше модель могла ошибиться в подсчете коробок или не заметить поврежденную упаковку в углу. Теперь, обнаружив неопределенность, агент внутри модели дает команду: «Мне нужно больше деталей в секторе B-4». Он фокусируется на этом фрагменте, перепроверяет данные и только после этого выдает вердикт. Это превращает ИИ из простого классификатора в полноценного инспектора, который несет ответственность за свои слова.

Почему это происходит именно в Gemini 3 Flash? Это стратегический ход. Flash — самая быстрая и дешевая модель в линейке Google. Внедряя такие сложные функции именно в «легкую» версию, компания намекает, что агентское поведение скоро станет стандартом индустрии, а не элитарной фишкой для тяжелых моделей. Это прямой вызов Anthropic и OpenAI, которые пока делают ставку на увеличение параметров, а не на изменение логики работы с визуальным вводом.

Последствия для рынка будут масштабными. Если нейросеть научится гарантированно считывать мелкие детали, это откроет двери для автоматизации контроля качества на производстве, где раньше требовался только человеческий глаз. Это также шаг к созданию по-настоящему автономных агентов, которые смогут ориентироваться в физическом мире, не теряясь при виде незнакомых объектов или нечетких указателей. Google фактически дает своим моделям возможность сомневаться в себе, что является первым признаком настоящего интеллекта.

Главное: Станет ли «активное зрение» стандартом для всех моделей в 2025 году, или мы продолжим доверять галлюцинациям нейросетей в критически важных задачах?