OpenAI redujo las alucinaciones en ChatGPT en un 52% — nuevo modelo GPT-5.5 Instant

OpenAI mejoró la precisión de ChatGPT. El nuevo modelo GPT-5.5 Instant produce un 52,5% menos de alucinaciones en prompts de riesgo (medicina, derecho, finanzas

OpenAI presentó un modelo predeterminado actualizado para ChatGPT — GPT-5.5 Instant, que funciona significativamente más honestamente y produce muchas menos alucinaciones.

Cifras de Mejora

Las alucinaciones (cuando un modelo inventa información falsa) llevan tiempo frustrando a los usuarios de ChatGPT. OpenAI afirma que, según pruebas internas, GPT-5.5 Instant produjo un 52,5% menos de hechos inventados que el Instant anterior para GPT-5.3, especialmente en preguntas de alto riesgo de medicina, derecho y finanzas. En conversaciones complejas que los propios usuarios marcaron como contenedoras de errores, el nuevo modelo redujo declaraciones inexactas en un 37,3%. Este es un progreso significativo para campos donde un error puede costar dinero o salud.

Dónde Ayuda Más

Las mejoras son más notables donde los errores son críticos:

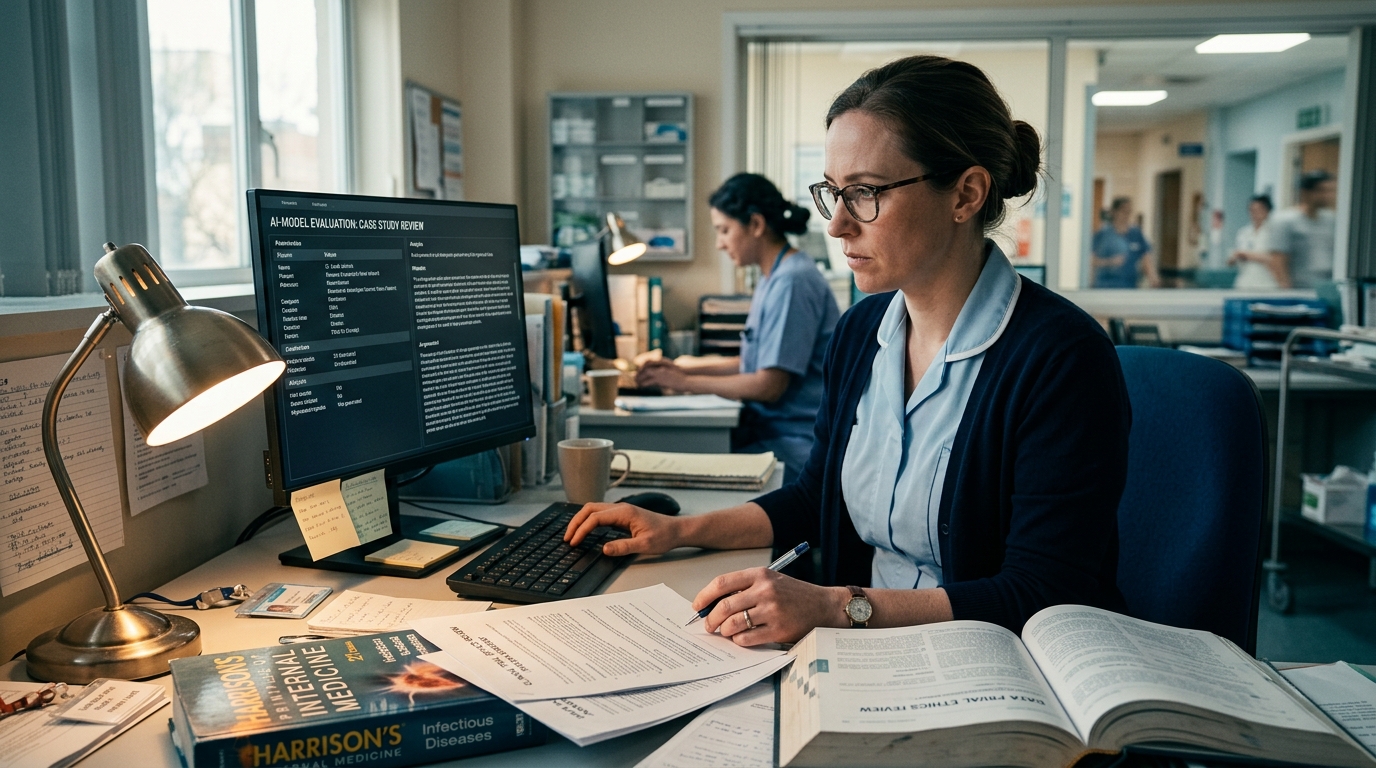

- Medicina y diagnóstico

- Asesoramiento legal e interpretación de leyes

- Planificación financiera e inversiones

- Preguntas técnicas complejas

- Verificación de hechos y verificación de información

Cuándo Aún Puede Cometer Errores

OpenAI no oculta que esto no es una panacea. Aunque las alucinaciones han disminuido, no han desaparecido por completo. El modelo aún puede cometer errores en hechos completamente nuevos que no están en sus datos de entrenamiento y en preguntas altamente especializadas que requieren experiencia rara.

Qué Significa Esto

La transición a GPT-5.5 Instant como predeterminado es una señal de que OpenAI está serio sobre la confiabilidad. Para usuarios que confían en ChatGPT para trabajar con información crítica, esta mejora es notable. Pero el escepticismo saludable sigue siendo necesario: verifica hechos en decisiones importantes, no confíes ciegamente en las respuestas.