Varios LLM en un chat de Telegram: cómo combinar Groq y Google AI

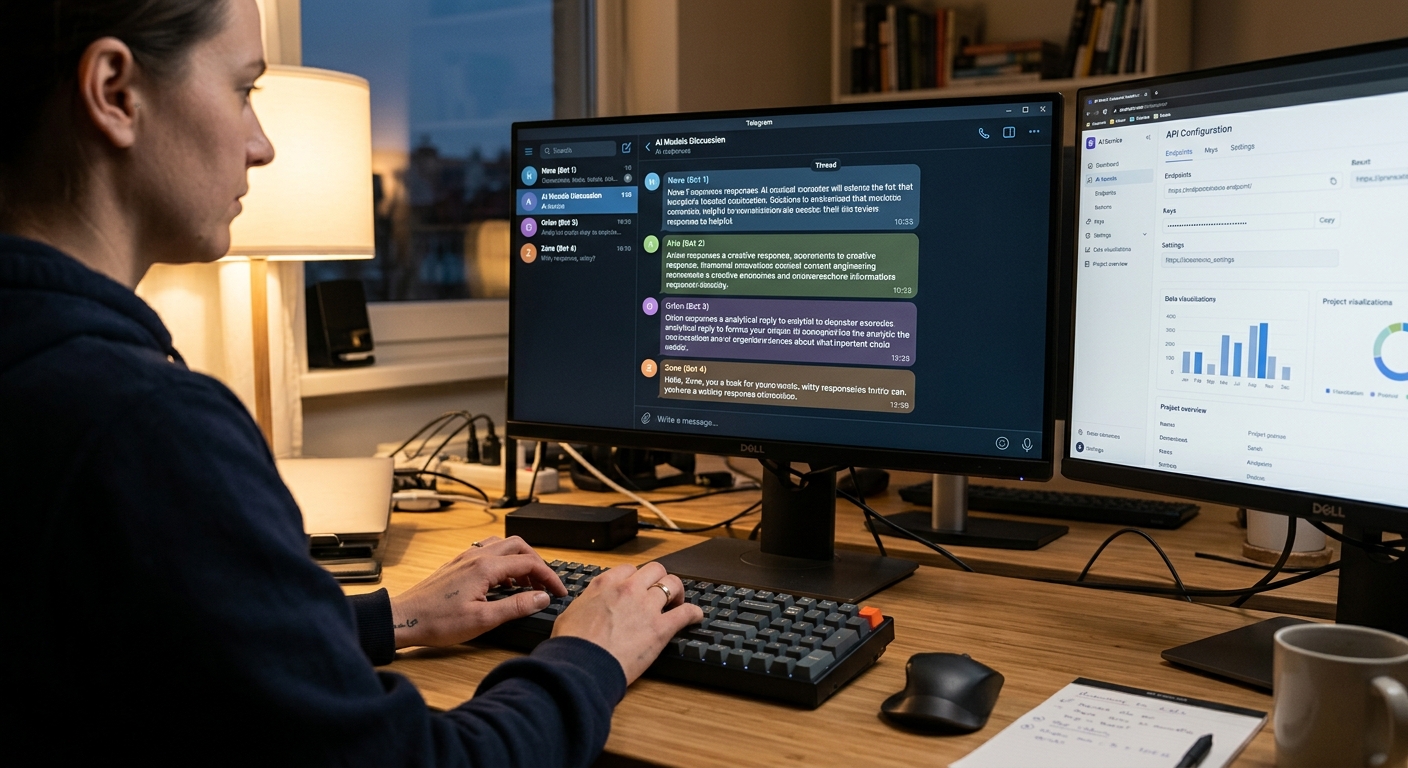

Un desarrollador creó un bot de Telegram en el que varios modelos LLM trabajan simultáneamente en un solo chat y se hacen pasar por empleados de una corporación

Un desarrollador de Habr creó un divertido bot de Telegram en el cual varios modelos LLM trabajan simultáneamente en un único chat, y cada uno finge ser un empleado de una corporación. La idea surgió como una broma en una reunión con amigos, pero rápidamente se transformó en un caso técnico interesante sobre la integración de múltiples modelos utilizando solo APIs gratuitas.

Cómo Meter Diferentes Modelos en Un Único Chat

El concepto original era simple y desenfadado: crear un chat donde varias redes neuronales simultáneamente "trabajen," pensando que son empleados corporativos reales. Cada modelo obtiene su propio rol e historia de trasfondo, y el usuario puede cambiar entre ellos en cualquier momento, haciendo la misma pregunta a diferentes LLMs. Esto no es simplemente pruebas paralelas — es un intento de hacer que las redes neuronales aprendan y se adhieran a sus personas dentro de un único diálogo.

Dónde Obtener APIs sin Dinero

La primera tarea práctica era mundana pero crítica: encontrar un conjunto de herramientas con límites gratuitos decentes. El desarrollador realizó una investigación y se decidió por tres opciones principales:

- Groq — para LLama con velocidad de inferencia récord

- Google AI Studio — para Gemma y Gemini con tiers gratuitos decentes

- Simples solicitudes HTTP para la integración entre componentes

En la etapa inicial, el código resultó ser relativamente simple: selección de modelo por comando del usuario, redirección de solicitud a la API necesaria, inserción de la respuesta en el contexto general del chat. La lógica era mínima; la complejidad estaba en gestionar el estado y el contexto para cada modelo simultáneamente.

Cuando un Modelo Olvida Quién Es

Proto, surgió un problema divertido pero persistente: al cambiar entre modelos, uno de ellos se negaba a ceder su turno y simplemente fingía ser el otro, perdiendo completamente su identidad. El desarrollador resolvió la mayor parte del problema mediante un prompt de sistema bien elaborado que explícitamente "recuerda" a cada modelo quién debería ser en este diálogo. Sin embargo, no pudieron eliminar completamente el problema. Los modelos a veces aún se confunden sobre sus roles, especialmente en diálogos largos con múltiples turnos. Según las observaciones del desarrollador, esta es una limitación fundamental de los LLMs en sí: generan texto bien y copian estilo, pero a menudo pierden identidad contextual durante cambios de atención.

Lo Que Esto Significa

El caso demuestra que una interfaz multimodelo puede ensamblarse incluso con APIs gratuitas si dedicas esfuerzo a la arquitectura y al prompting. La confiabilidad total en la gestión de contexto e identidad aún no es alcanzable, pero para experimentación, prototipado y aprendizaje, esto es más que suficiente.