Vários LLMs em um chat no Telegram: como combinar Groq e Google AI

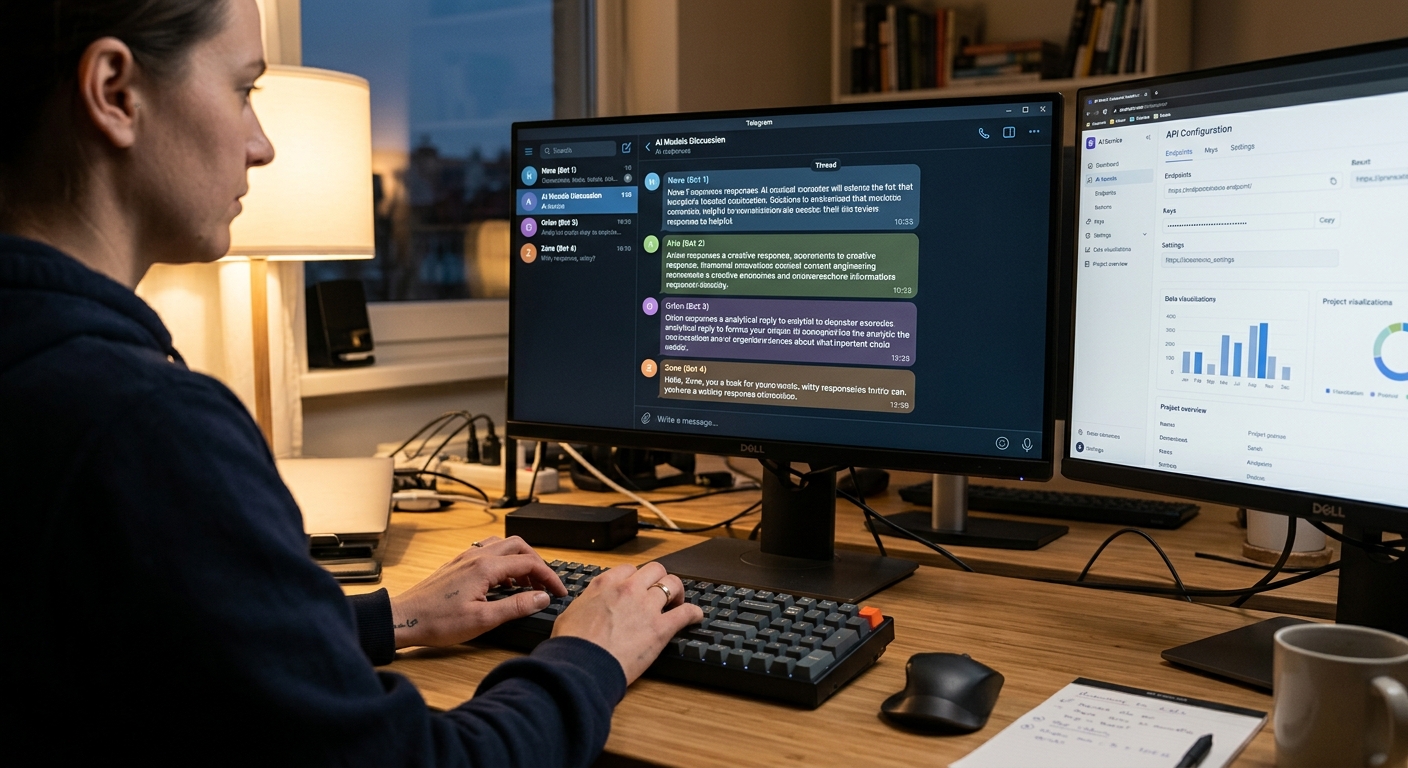

Um desenvolvedor criou um bot do Telegram em que vários modelos LLM trabalham simultaneamente em um único chat, se passando por funcionários de uma corporação.

Um desenvolvedor do Habr criou um bot divertido do Telegram em que vários modelos de LLM trabalham simultaneamente em um único chat, e cada um finge ser um funcionário de uma corporação. A ideia surgiu como uma piada em um encontro com amigos, mas rapidamente se transformou em um caso técnico interessante sobre integração de múltiplos modelos usando apenas APIs gratuitas.

Como Colocar Diferentes Modelos em Um Único Chat

O conceito original era simples e descontraído: criar um chat onde várias redes neurais "trabalhem" simultaneamente, pensando que são funcionários corporativos reais. Cada modelo recebe seu próprio papel e história de fundo, e o usuário pode mudar entre eles a qualquer momento, fazendo a mesma pergunta a diferentes LLMs. Isso não é apenas teste paralelo — é uma tentativa de fazer redes neurais aprender e aderir às suas personas dentro de um único diálogo.

Onde Conseguir APIs Sem Gastar Dinheiro

A primeira tarefa prática era mundana mas crítica: encontrar um kit de ferramentas com limites gratuitos decentes. O desenvolvedor realizou uma pesquisa e se decidiu por três opções principais:

- Groq — para LLama com velocidade de inferência recorde

- Google AI Studio — para Gemma e Gemini com tiers gratuitos decentes

- Simples requisições HTTP para integração entre componentes

No estágio inicial, o código ficou relativamente simples: seleção de modelo por comando do usuário, redirecionamento de requisição para a API necessária, inserção da resposta no contexto geral do chat. A lógica era mínima; a complexidade estava em gerenciar o estado e o contexto para cada modelo simultaneamente.

Quando um Modelo Esquece Quem É

Logo, um problema engraçado mas persistente surgiu: ao alternar entre modelos, um deles se recusava a ceder sua vez e simplesmente fingia ser o outro, perdendo completamente sua identidade. O desenvolvedor resolveu a maior parte do problema através de um prompt de sistema bem elaborado que explicitamente "lembra" cada modelo de quem deveria ser neste diálogo. No entanto, não conseguiram eliminar completamente o problema. Os modelos às vezes ainda se confundem sobre seus papéis, especialmente em diálogos longos com múltiplos turnos. De acordo com as observações do desenvolvedor, isso é uma limitação fundamental dos LLMs em si: eles geram texto bem e copiam estilo, mas frequentemente perdem a identidade contextual durante mudanças de atenção.

O Que Isso Significa

O caso demonstra que uma interface multi-modelo pode ser montada até com APIs gratuitas se você dedicar esforço à arquitetura e ao prompting. A confiabilidade total no gerenciamento de contexto e identidade ainda não é alcançável, mas para experimentação, prototipagem e aprendizado, isso é mais do que suficiente.