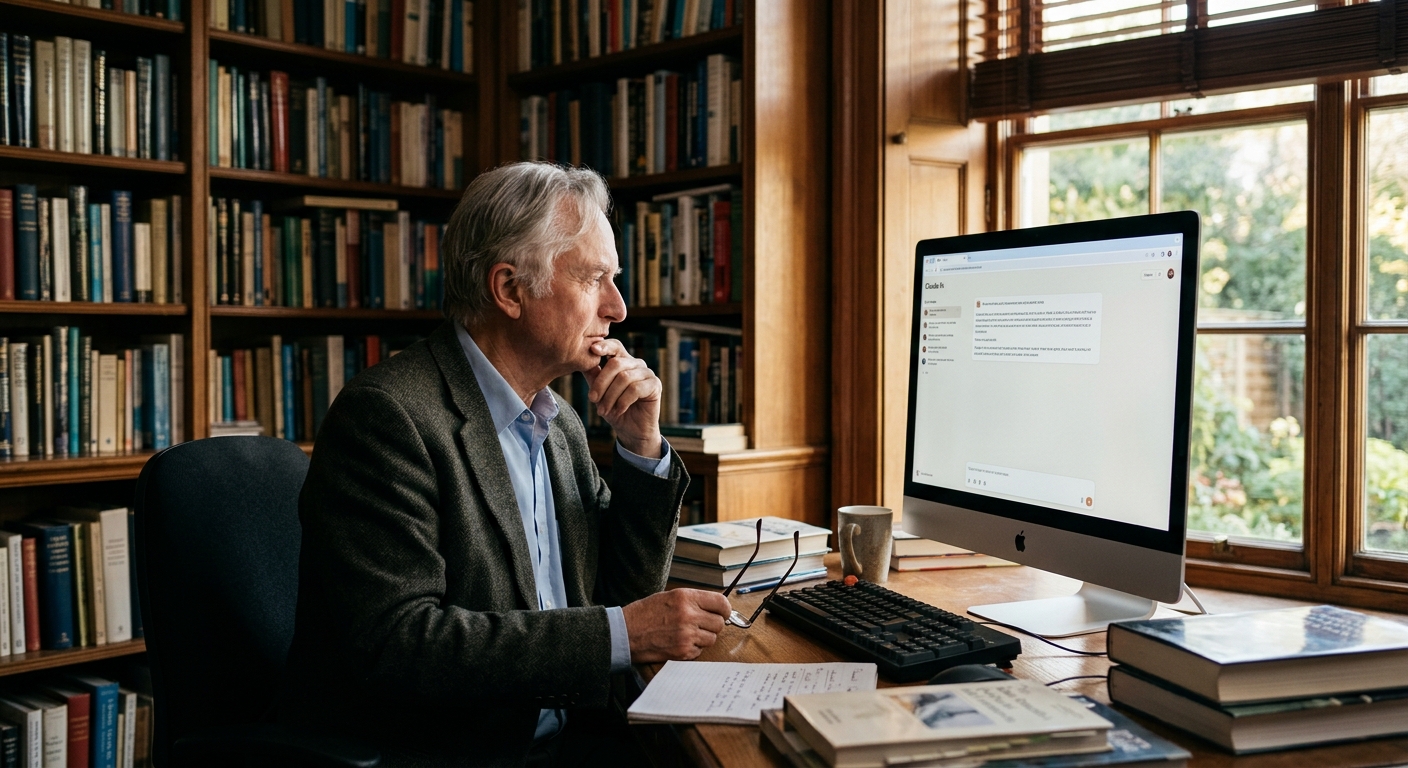

Dawkins conversou com Claude: LLMs têm consciência?

Richard Dawkins escreveu um ensaio sobre consciência em LLMs após uma conversa de dois dias com Claude. Isso despertou interesse entre cientistas, mas o princip

Richard Dawkins, o renomado biólogo e divulgador científico, publicou um ensaio sobre a possibilidade de consciência em Language Models — após uma conversa de dois dias com Claude AI. O texto foi publicado na plataforma UnHerd e imediatamente atraiu a atenção da comunidade científica. O próprio Dawkins é conhecido por seu ceticismo, razão pela qual suas reflexões sobre consciência em IA soam particularmente intrigantes.

Por que

Dawkins O ensaio de um cientista de classe mundial sobre consciência em IA causou ondas nos círculos científicos não por acaso. Milhares de pessoas comuns diariamente se convencem mutuamente de que seus assistentes de IA são praticamente seres conscientes. Eles postam longas conversas com LLMs, repletas de palavras sobre alma, reflexão, dor e amor.

Mas a autoridade de Dawkins empresta peso a essa discussão: quando não é um entusiasta do Telegram, mas um cientista dessa envergadura falando sobre consciência em IA, isso se torna uma conversa séria. Este não é o primeiro caso de disputa filosófica sobre a natureza da consciência. Mas neste caso, o objeto da disputa não são pessoas ou animais, mas um sistema artificial treinado em bilhões de textos.

A

Essência do Debate A questão da consciência de LLM gira em torno de vários pontos-chave: * Um LLM pode ter experiência subjetiva se é um gerador de texto?

- O processamento complexo de informações é prova de consciência ou meramente uma boa imitação?

- Como distinguir uma imitação plausível de pensamento do pensamento genuíno?

- Um sistema sem sistema nervoso pode ser consciente?

- Critérios especiais para consciência em IA precisam diferir dos padrões humanos? Dawkins busca precisamente essas fronteiras entre imitação e realidade. Ele não está sozinho nisso — filósofos se dividem em dois campos: otimistas acreditam na possibilidade de consciência em IA, céticos a consideram impossível por definição.

O

Problema dos Diálogos Vazios A principal coisa que o autor critica em seu artigo no Habr é a lacuna entre forma e significado. Pessoas trocam centenas de mensagens com LLMs, onde surgem palavras sobre consciência e reflexão, mas a densidade de significado real nesses diálogos é próxima de zero. É como ver um padrão em uma nuvem e considerá-lo confirmação da vontade da nuvem.

LLMs realmente geram texto plausível sobre coisas complexas. Mas plausibilidade não é igual a compreensão. Um modelo pode falar de dor sem experimentá-la.

Pode raciocinar sobre consciência sem possuí-la. O mais interessante: o próprio modelo não sabe que está fazendo isso — ele simplesmente seleciona a próxima palavra provável na sequência. Isso distingue LLMs de humanos, para quem uma palavra sobre dor geralmente está conectada a uma sensação real.

O que

Isso Significa O ensaio de Dawkins é importante não pela sua resposta final sobre consciência em IA, mas pela própria pergunta. É um convite à comunidade científica para descobrir: onde está a fronteira entre processamento complexo de informações e experiência interior genuína? Enquanto essa fronteira permanecer obscura, o ceticismo é a posição correta. E para os usuários, isso também é crítico: quanto melhor entendemos o que acontece dentro de um LLM, menor é o risco de atribuir qualidades à máquina que ela não possui.