NeuralSet e deep learning: decodificação de características linguísticas a partir de sinais cerebrais de MEG

A NeuralSet detalhou um pipeline end-to-end em que sinais de MEG são transformados em previsões de características linguísticas. No exemplo, o modelo estima o c

В новом техническом разборе показан neuroAI-пайплайн, который извлекает языковые признаки прямо из MEG-сигналов. В качестве демонстрации система на базе NeuralSet и deep learning пытается предсказывать длину слова по реакции мозга на языковой стимул.

Как работает пайплайн

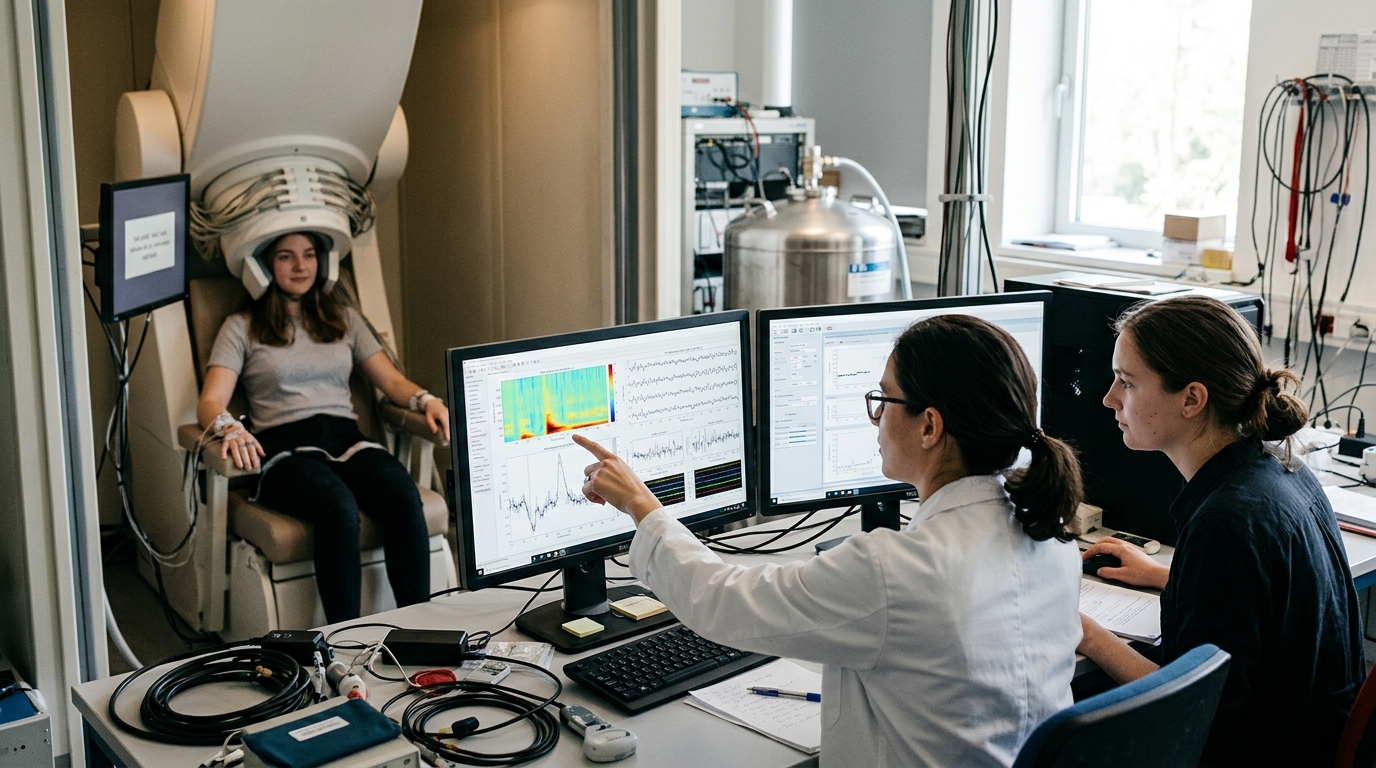

Материал интересен тем, что показывает не отдельный фрагмент исследования, а почти полную инженерную цепочку: от подготовки окружения до обучения модели на нейросигналах. В центре — MEG, метод регистрации магнитных полей, возникающих при активности нейронов. Дальше данные проходят стандартный для neuroAI маршрут: загрузка, очистка, синхронизация со стимулами, формирование обучающих примеров и подача в сеть, которая должна связать паттерны мозговой активности с конкретным языковым свойством.

Целевая задача выбрана достаточно приземлённая, но показательная: система оценивает длину слова, которое человек воспринимал, опираясь только на мозговой отклик. Это важная оговорка. Речь не о свободном «чтении мыслей», а о предсказании строго определённого признака в контролируемом эксперименте.

Такой формат делает пайплайн полезным для разработчиков и исследователей: можно проверить, насколько end-to-end подход вообще извлекает смысл из сырых или минимально обработанных биосигналов, не разрывая процесс на десятки ручных шагов.

Почему важен MEG Для языковых задач MEG особенно удобен из-за высокой временной точности.

Если fMRI хорошо показывает, где активность возникает, то MEG лучше подходит для ответа на вопрос, когда именно мозг реагирует на слово, звук или отдельный признак стимула. В задачах, связанных с длиной слова, порядком символов или ранней семантической обработкой, эта миллисекундная динамика часто важнее, чем грубая пространственная карта. Поэтому интерес к таким пайплайнам растёт не только у нейробиологов, но и у команд, работающих на стыке ИИ и интерфейсов мозг-компьютер.

Отдельно важно, что в разборе NeuralSet используется как основа для организации данных и модели. Для практики это полезнее сухого описания архитектуры на бумаге: читатель видит, как собирать воспроизводимый процесс, а не только итоговую идею. В таких темах именно воспроизводимость обычно и тормозит прогресс.

Даже хорошая модель мало что даёт, если команда не может быстро поднять окружение, подать MEG-записи в единый формат и повторить эксперимент на своей выборке без ручной сборки каждого шага.

Что есть в реализации

Судя по описанию, туториал закрывает ключевые шаги, которые нужны для первого рабочего прототипа. Это не абстрактный обзор про «нейросети для мозга», а кодовая реализация, где видно, как нейронные данные превращаются в supervised-задачу. Для инженеров ценность как раз в этой приземлённости: можно взять основу, заменить целевой признак, подключить другой датасет и быстро проверить, работает ли тот же подход на новой постановке.

настройка Python-окружения и зависимостей для neuroAI-пайплайна загрузка MEG-данных и базовая предобработка сигналов связывание мозговых откликов с языковыми стимулами обучение deep learning-модели для предсказания длины слова * оценка результатов и проверка, насколько сигнал несёт полезный лингвистический признак Такой формат особенно полезен сейчас, когда рынок AI-инструментов быстро уходит от чисто текстовых моделей к мультимодальным и биосигнальным интерфейсам. Даже если конкретная задача с длиной слова выглядит узкой, она решает более общий вопрос: можно ли стабильно извлекать структурированные признаки из сложного мозгового сигнала без тяжёлой ручной инженерии. Если ответ хотя бы частично положительный, дальше тот же подход можно расширять на фонетику, категорию слова, семантические классы и другие уровни языкового анализа.

Что это значит

Практическая ценность этой публикации не в громких обещаниях, а в том, что она снижает порог входа в neuroAI. Когда у разработчиков появляется воспроизводимый код для работы с MEG и языковыми признаками, область быстрее движется от красивых исследовательских слайдов к проверяемым системам. Для индустрии это ещё не готовый продукт, но уже понятный маршрут к будущим интерфейсам «мозг-компьютер» и новым инструментам изучения речи.