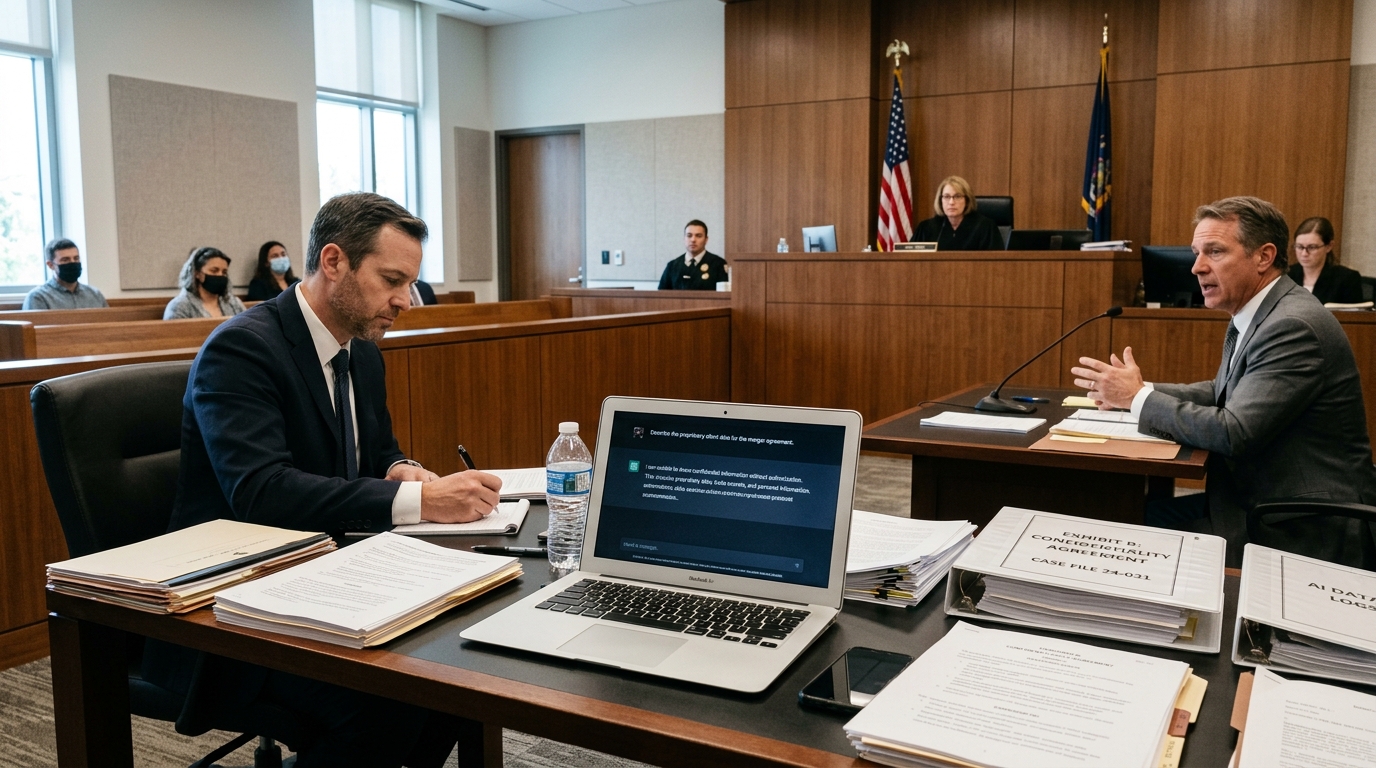

Tribunal dos EUA decidiu que correspondência do réu com Claude da Anthropic não está protegida pelo sigilo profissional

Um juiz americano afirmou pela primeira vez diretamente que correspondência com Claude sobre riscos legais não é protegida pelo sigilo profissional ou doutrina

Суд в США фактически провел жесткую границу между консультацией с юристом и разговором с чат-ботом: если человек обсуждает с Claude свои правовые риски, такая переписка сама по себе не получает защиту адвокатской тайны. Для пользователей генеративного ИИ это один из самых важных юридических сигналов за последнее время: удобство сервиса не делает его конфиденциальным советником. Речь идет о решении, вынесенном в феврале 2026 года судьей Джедом Ракоффом по делу Брэдли Хеппнера, обвиняемого в мошенничестве.

Суд пришел к выводу, что его диалоги с Claude от Anthropic о возможной юридической ответственности не подпадают ни под attorney-client privilege, ни под защиту work product. По сути, суд рассмотрел эти чаты не как профессиональное взаимодействие с защитником, а как общение с внешним цифровым инструментом, который не наделен статусом адвоката. Первая часть позиции суда выглядит прямолинейно: адвокатская тайна возникает там, где есть общение клиента с лицензированным юристом ради получения правовой помощи.

Claude, как и любой другой публичный ИИ-сервис, таким юристом не является. Вторая часть не менее важна: суд отказался считать такие материалы рабочими документами защиты. Обычно work-product protection охраняет подготовку к судебному спору, стратегии и аналитические материалы, созданные для дела.

Но, по мнению суда, передача таких рассуждений в публичную ИИ-систему разрушает ожидание защищенности. Важно и то, что суд фактически оценивал не качество ответов модели, а сам статус канала общения. Даже если бот помогает сформулировать аргументы, собрать вопросы к юристу или описать возможные последствия, это не превращает сервис в участника защищенного юридического взаимодействия.

Иначе говоря, проблема не в том, что ИИ ошибается или дает слишком общие советы, а в том, что пользователь раскрывает чувствительную информацию третьей стороне, которая не связана профессиональной обязанностью хранить тайну клиента. Ключевой аргумент в решении — отсутствие у общедоступной AI-платформы обязанности хранить конфиденциальность так, как это делает адвокат или юридическая фирма. Именно этот момент делает историю шире одного конкретного процесса.

Многие пользователи уже привыкли обсуждать с моделями чувствительные темы: споры с работодателем, налоговые вопросы, условия контрактов, риски для бизнеса. Суд фактически напомнил: если данные уходят в сервис, который не связан профессиональной тайной, рассчитывать на тот же уровень защиты нельзя. Практический эффект может быть заметным далеко за пределами уголовных дел.

Компаниям это решение показывает, что внутренние юридические стратегии, загруженные во внешний чат-бот без специальных договорных и технических гарантий, потенциально становятся уязвимым местом в споре. Частным пользователям оно тоже задает новую дисциплину: ИИ можно использовать для структурирования вопросов, перевода юридического языка на человеческий или подготовки списка тем для встречи с адвокатом, но не как безопасную замену самому адвокату. Особенно рискованно отправлять в такие сервисы признания, фактуру спора, черновики позиции и детали, которые могут иметь процессуальное значение.

Для самих AI-компаний это тоже неприятный, но полезный прецедент. Он усиливает спрос на корпоративные режимы работы, частные инсталляции, более жесткие договорные условия и понятные границы использования данных. Чем активнее модели заходят в юридические, финансовые и кадровые процессы, тем чаще бизнес будет спрашивать не только о качестве ответов, но и о том, какие именно права сохраняются после загрузки чувствительной информации в систему.

То, что это решение называют первым подобным в США, делает его ориентиром для будущих разбирательств, даже если окончательные правила обращения с AI-чатами еще будут уточняться в других судах. По мере того как генеративные модели все глубже заходят в рабочие процессы, юридическая система начинает отвечать на вопрос, который долго оставался в серой зоне: считается ли разговор с ИИ частным размышлением пользователя или это уже передача информации третьей стороне. В этом случае суд выбрал второй вариант.

Главный вывод простой: чат-бот может помочь подумать, но не может предоставить ту же правовую оболочку, что и живой адвокат. Для рынка AI это не запрет, а жесткое напоминание о границах продукта. Для пользователей — правило гигиены: все, что касается судебных рисков, признаний и стратегии защиты, лучше обсуждать с юристом, а не с публичной моделью.