Anthropic contra o Pentágono: disputa judicial com o Departamento de Defesa continua

O conflito da Anthropic com o Departamento de Defesa dos EUA está longe de terminar — esse é o principal tema do novo episódio do podcast Wired Uncanny Valley.

Противостояние Anthropic и Министерства обороны США выходит на новый виток — редакция подкаста Wired Uncanny Valley посвятила этой теме отдельный выпуск, подчёркивая, что история ещё далека от завершения. Антропик давно позиционирует себя как компанию, ориентированную на безопасный ИИ. Её политика допустимого использования прямо ограничивает применение моделей Claude в военных целях, разработке оружия и операциях, связанных с причинением вреда людям.

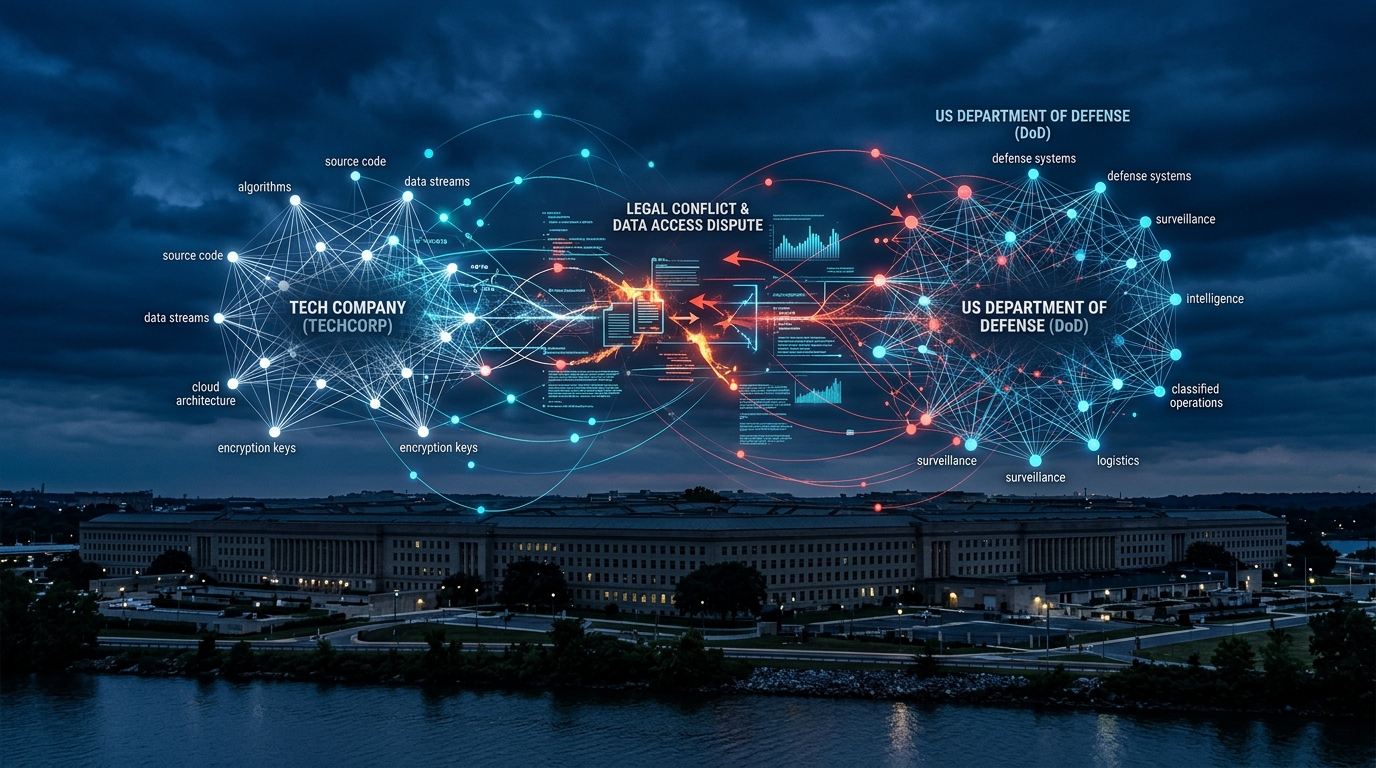

Именно это ограничение стало камнем преткновения в отношениях с Пентагоном, который активно ищет способы интегрировать передовые языковые модели в оборонные программы. Суть конфликта — в глубинном противоречии между коммерческим давлением и этическими обязательствами компании. С одной стороны, Министерство обороны является одним из крупнейших потенциальных заказчиков ИИ-технологий в мире.

С другой — Anthropic последовательно настаивает на том, что определённые сценарии использования остаются вне допустимых границ вне зависимости от масштаба контракта. Это делает их позицию редкостью на рынке, где большинство игроков готовы гибко трактовать собственные политики. Вторая тема выпуска — так называемые «военные мемы».

Редакция исследует, как генеративный ИИ меняет информационные войны: автоматически производимый контент, имитирующий органическую культуру сети, всё активнее используется для формирования общественного мнения в зонах военных конфликтов. Технологии, которые позволяли делать смешные картинки, теперь работают на пропаганду в промышленных масштабах. Третий сюжет касается венчурного капитала.

Аналитики и участники рынка всё громче говорят о том, что ИИ-инструменты способны автоматизировать значительную часть работы венчурных аналитиков: скрининг стартапов, анализ рынков, due diligence, составление инвестиционных меморандумов. Если это произойдёт, традиционная модель VC-фондов с десятками аналитиков на низких уровнях иерархии окажется под угрозой — точно так же, как ИИ уже начал вытеснять джуниоров в юридических фирмах и консалтинге. Все три темы объединяет одна логика: ИИ перестал быть инструментом продуктивности и превратился в субъект политики, войны и экономических отношений.

Компании, которые создают эти системы, всё меньше контролируют контекст, в котором их применяют — и всё больше вынуждены занимать публичные позиции там, где раньше предпочитали молчать. Дело Anthropic против Пентагона — один из первых случаев, когда частная ИИ-компания открыто противостоит государственному заказчику ради соблюдения собственных этических принципов. Чем закончится этот прецедент, во многом определит, насколько серьёзно рынок будет воспринимать подобные декларации в будущем.