Broadcom нацелилась на $100 млрд от продаж AI-чипов к 2027 году

Генеральный директор Broadcom Хок Тан объявил, что компания ожидает выручку от продаж AI-чипов свыше $100 млрд в 2027 году. Это амбициозный прогноз, который сиг

Когда глава одной из крупнейших полупроводниковых компаний мира публично называет цифру в $100 миллиардов, рынок замирает. Именно это произошло после заявления генерального директора Broadcom Хока Тана: компания рассчитывает, что её выручка от продаж чипов для искусственного интеллекта превысит эту психологически важную отметку уже в 2027 году. Для индустрии, в которой Nvidia казалась непоколебимым монополистом, это звучит как объявление войны.

Чтобы понять масштаб амбиций Broadcom, нужно вспомнить, откуда эта компания пришла. Исторически Broadcom была известна прежде всего как производитель сетевых контроллеров, коммутаторов и инфраструктурных чипов — надёжный, но не самый заметный игрок в тени Intel и Qualcomm. Всё изменилось, когда Хок Тан, известный своей агрессивной стратегией поглощений, превратил компанию в полупроводникового гиганта с капитализацией в сотни миллиардов долларов. Приобретение VMware в 2023 году за $69 млрд стало лишь самой громкой из его сделок. Но настоящий стратегический разворот Broadcom совершила в сторону кастомных AI-чипов — и именно здесь кроется ключ к пониманию сегодняшнего заявления.

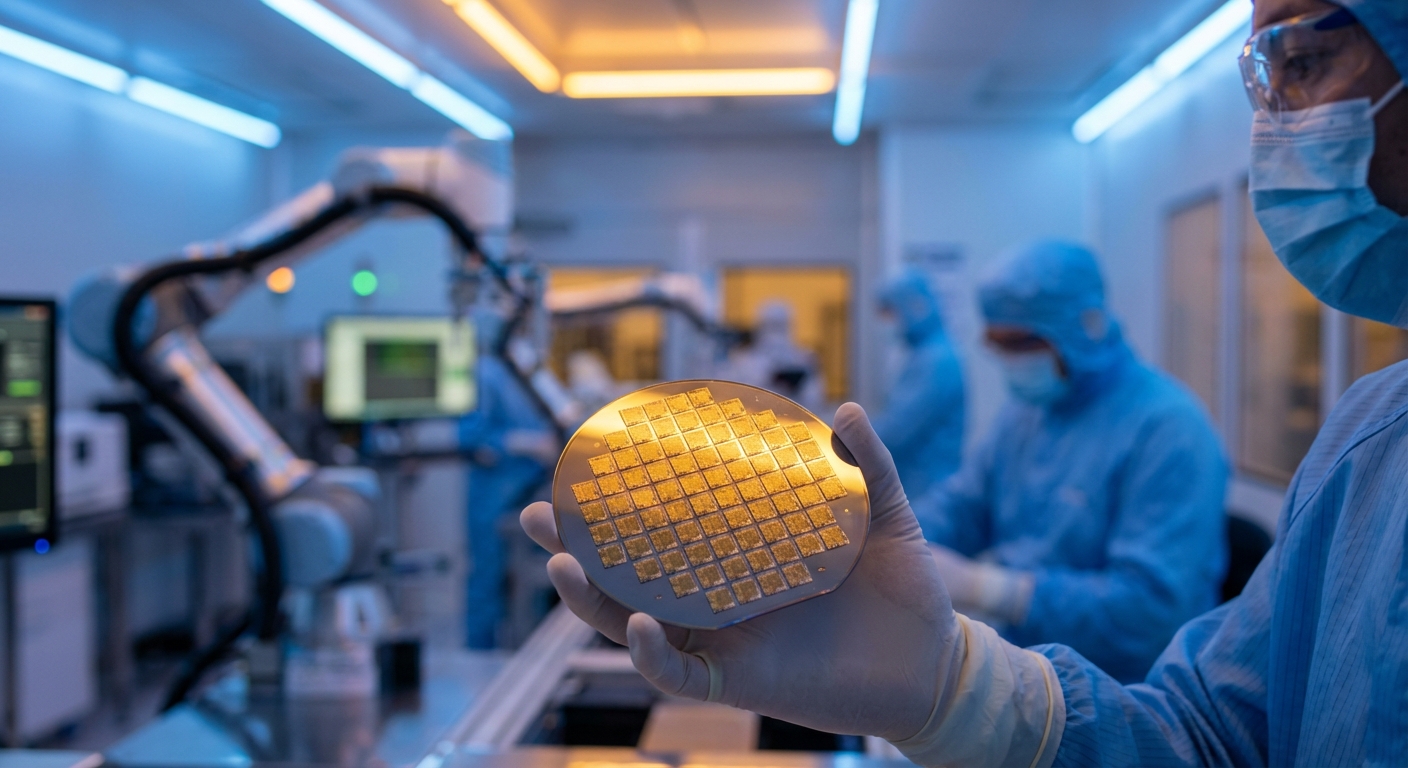

В отличие от Nvidia, которая продаёт универсальные GPU-ускорители вроде H100 и B200, пригодные для широкого спектра задач, Broadcom делает ставку на ASIC — специализированные интегральные схемы, проектируемые под конкретного заказчика и конкретную рабочую нагрузку. Среди её клиентов — технологические гиганты первого эшелона: Google с её TPU (Tensor Processing Unit), Meta и, по данным аналитиков, ряд других крупных облачных провайдеров. Логика проста: когда вы тренируете модели масштаба GPT или Gemini и тратите на это миллиарды долларов ежегодно, даже десятипроцентный выигрыш в энергоэффективности или производительности на ватт окупается многократно. Кастомный чип, заточенный именно под вашу архитектуру, может дать этот выигрыш — и избавить от зависимости от единственного поставщика.

Именно страх перед зависимостью от Nvidia стал, пожалуй, главным двигателем роста Broadcom в AI-сегменте. На протяжении последних трёх лет крупнейшие технологические компании мира оказались в положении, которое им категорически не нравится: они стоят в очереди за GPU, соглашаются на условия Nvidia и выстраивают свою инфраструктуру вокруг одной экосистемы CUDA. Для корпораций, привыкших контролировать каждый уровень своего технологического стека, это неприемлемая ситуация. Broadcom предлагает выход — не замену Nvidia как таковую, а альтернативный путь, при котором заказчик получает чип, спроектированный под его нужды, с его спецификациями, интегрированный в его инфраструктуру.

Прогноз в $100 млрд, безусловно, амбициозен, и к нему стоит отнестись с долей здорового скептицизма. По оценкам аналитиков, в 2025 финансовом году AI-выручка Broadcom составила порядка $12–15 млрд. Рост до $100 млрд за два года означает увеличение примерно в семь раз — темп, который требует не просто органического роста, а фундаментального расширения клиентской базы и объёмов производства. Впрочем, есть основания полагать, что Тан не блефует. Общий объём инвестиций в AI-инфраструктуру стремительно растёт: Microsoft, Google, Amazon и Meta суммарно планируют потратить более $300 млрд на капитальные затраты в 2026–2027 годах, и значительная часть этих денег пойдёт именно на чипы. Если Broadcom сумеет захватить хотя бы треть этого потока, цифра в $100 млрд перестаёт казаться фантастической.

Для Nvidia это заявление — не катастрофа, но серьёзный сигнал. Компания Дженсена Хуанга по-прежнему контролирует подавляющую долю рынка AI-ускорителей и обладает мощнейшей программной экосистемой, которую невозможно воспроизвести за год или два. Однако сам факт того, что конкурент публично заявляет о стомиллиардных перспективах, говорит о том, что рынок AI-чипов перестаёт быть монополией. Он становится полем битвы, где кастомные решения от Broadcom, собственные разработки Google и Amazon, а также усилия AMD и новых стартапов вроде Cerebras и Groq постепенно размывают доминирование одного игрока.

Что всё это значит для индустрии в целом? Прежде всего — здоровую конкуренцию, которая неизбежно приведёт к снижению стоимости вычислений для AI. Когда у заказчиков появляется реальный выбор между универсальными GPU и кастомными ASIC, цены начинают двигаться вниз, а инновации — вверх. Для компаний, строящих AI-продукты, это означает более доступную инфраструктуру. Для конечных пользователей — более быстрое внедрение искусственного интеллекта в повседневные сервисы. Заявление Хока Тана — это не просто корпоративный прогноз. Это маркер нового этапа в развитии AI-индустрии, на котором монополия на вычислительную мощность уступает место многополярному рынку. И этот рынок только начинает формироваться.