Математика RNN: почему «детские» вопросы ставят инженеров в тупик

Рекуррентные нейросети (RNN) считаются базой, но их математическая начинка часто вызывает головную боль даже у опытных разработчиков. Традиционные учебники част

Мы привыкли воспринимать нейросети как черный ящик, который просто работает, если скормить ему достаточно данных и вычислительных мощностей. Но стоит копнуть чуть глубже уровня библиотек PyTorch или TensorFlow, как выясняется, что фундамент, на котором стоит современный ИИ, держится на вещах, которые мы часто принимаем на веру. Рекуррентные нейросети (RNN) сегодня кажутся пережитком прошлого на фоне доминирования трансформеров, но именно в их структуре заложены те самые математические принципы, без понимания которых невозможно осознать эволюцию глубокого обучения. Когда-то именно RNN научили машины работать с последовательностями, и понимание их «подкапотки» — это не просто академическое упражнение, а способ понять, почему современные модели стали именно такими.

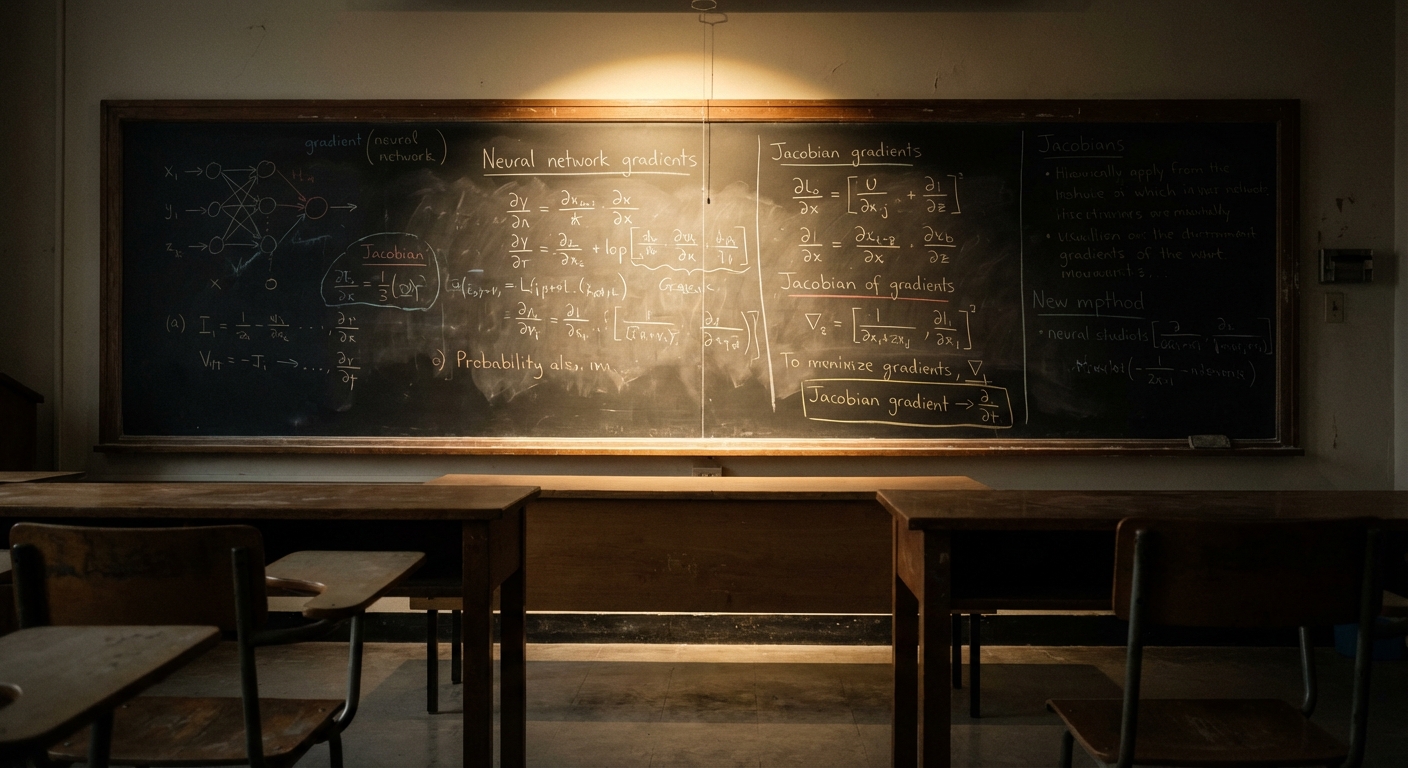

В основе любой RNN лежит идея передачи состояния из прошлого в будущее. Математически это выглядит элегантно, пока вы не начинаете считать производные. Большинство учебников услужливо предлагают нам готовые формулы, но редко объясняют, как именно происходит дифференцирование вектора по матрице. Для многих инженеров это становится моментом истины: оказывается, что привычные правила из школьного курса матанализа здесь работают иначе, превращаясь в громоздкие операции с якобианами. Мы часто боимся задавать «детские» вопросы, например, почему при обратном распространении ошибки градиенты именно складываются, а не перемножаются в определенных узлах графа. Ответы на эти вопросы кроются в самой природе цепного правила и того, как информация течет через слои нейронов.

Контекст возникновения RNN тесно связан с попытками имитировать человеческую память. Однако на практике исследователи быстро столкнулись с проблемой затухающих и взрывающихся градиентов. Это не просто технический баг, а прямое следствие математической структуры рекурсии. Когда вы умножаете матрицу саму на себя десятки или сотни раз в процессе обратного распространения ошибки во времени (BPTT), любое отклонение собственных значений от единицы приводит либо к обнулению сигнала, либо к его бесконечному росту. Именно этот математический тупик заставил индустрию искать альтернативы, что сначала привело к созданию LSTM и GRU с их сложной системой «гейтов», а затем и к механизмам внимания, которые легли в основу архитектуры GPT.

Разбор простейшей RNN, подобной той, что когда-то популяризировал Андрей Карпатый, обнажает иронию индустрии: мы строим колоссальные системы на принципах, которые до сих пор вызывают споры в деталях реализации. Например, вопрос о том, как именно инициализировать веса, чтобы избежать коллапса обучения в первые же секунды, до сих пор остается скорее искусством, чем строгой наукой. Мы используем эвристики, которые работают, но не всегда можем объяснить «почему» на уровне первого принципа. Это напоминает детское любопытство, когда ребенок разбирает игрушку, чтобы понять, что внутри, и обнаруживает там детали, назначение которых не понимают даже взрослые.

Анализ этих основ заставляет нас иначе взглянуть на текущий бум нейросетей. Понимая, как сложно было заставить RNN помнить хотя бы десяток слов в предложении, начинаешь по-настоящему ценить инженерный гений, стоящий за современными контекстными окнами в миллионы токенов. Однако старые проблемы никуда не делись — они просто мимикрировали. Вопросы эффективности вычислений и стабильности градиентов остаются актуальными и для гигантских кластеров H100. Возвращение к истокам и разбор «детских» вопросов о дифференцировании и распространении ошибки позволяет сбросить спесь сеньор-разработчика и увидеть в коде не просто вызов функции .backward(), а сложный и хрупкий танец чисел.

Главное: фундаментальное понимание математики RNN доказывает, что в ИИ нет магии — есть только длинные цепочки производных, которые иногда ведут себя непредсказуемо из-за нашей любви к упрощениям.