LLM-in-Sandbox: Damos à rede neural seu próprio computador para parar de alucinar código

Новый концепт LLM-in-Sandbox предлагает радикальное решение проблемы «умного, но беспомощного» ИИ. Вместо того чтобы заставлять модель просто генерировать текст

Давайте честно: копировать код из ChatGPT, вставлять его в IDE, ловить ошибку, копировать ошибку обратно в чат и повторять этот цикл десять раз — это не будущее. Это пытка. Именно поэтому концепция, вынесенная в заголовок — LLM-in-Sandbox — выглядит как то самое лекарство, которое доктор прописал индустрии прямо сейчас.

Суть происходящего проста, но фундаментальна. Исследователи и инженеры наконец-то признали: языковой модели мало просто «знать» Python или Bash. Ей нужно «тело» — или, в данном случае, компьютер.

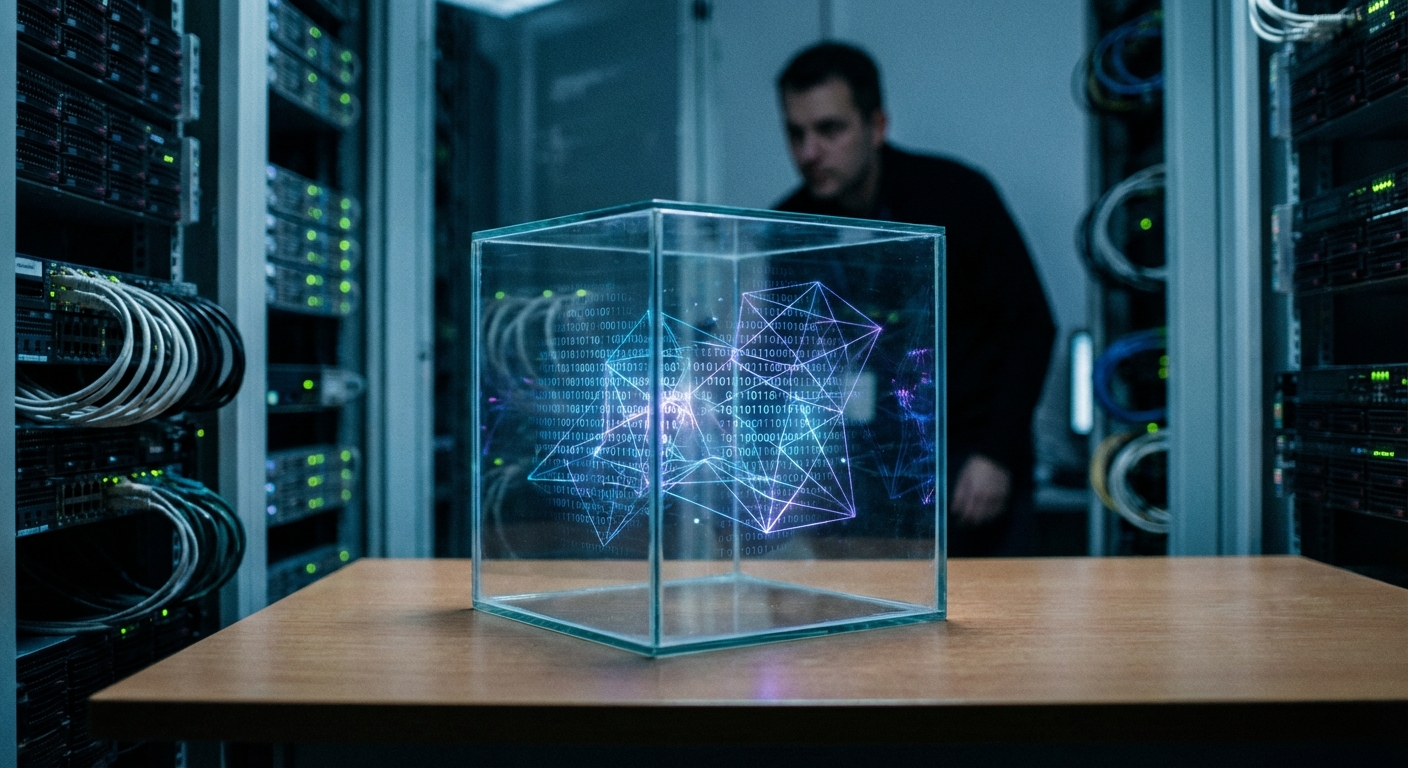

Концепция LLM-in-Sandbox предполагает помещение большой языковой модели в изолированную среду исполнения, где она может вести себя как полноценный пользователь: создавать файлы, запускать скрипты, устанавливать библиотеки и, что самое важное, видеть результаты своих действий в реальном времени. Почему это меняет правила игры? Раньше LLM работали в вакууме.

Они галлюцинировали вызовы несуществующих библиотек просто потому, что у них не было способа проверить, установлен ли пакет `pandas` в конкретной среде. В подходе «песочницы» модель превращается в то, что китайские исследователи называют «универсальным агентом». Она пишет код, запускает его, видит `Error: module not found`, сама запускает `pip install` и пробует снова.

Без вашего участия. Это переводит взаимодействие с ИИ из плоскости «вопрос-ответ» в плоскость «задача-решение». Вы не просите «напиши скрипт», вы говорите «проанализируй эти данные и построй график».

И модель не выдает текст, а возвращает готовый `.png` файл, потому что у нее был доступ к терминалу и файловой системе. Конечно, здесь встает вопрос безопасности, и именно поэтому слово «Sandbox» (песочница) здесь ключевое.

Давать ИИ доступ к вашему рабочему ноутбуку без ограничений — идея на уровне «доверить обезьяне гранату». Изолированные контейнеры позволяют модели ломать, крушить и экспериментировать, не угрожая основной системе. Это тот самый полигон, где цифровой интеллект учится взаимодействовать с миром софта не теоретически, а практически.

Мы наблюдаем переход от эры чат-ботов к эре агентов. Если 2023 год был годом «Вау, оно умеет писать стихи», то 2024-2025 — это время «Вау, оно само настроило сервер». LLM-in-Sandbox — это не просто новый инструмент, это признание того, что интеллекту нужны руки, пусть и виртуальные.

Главное: Хватит ли у нас смелости (и вычислительных мощностей) позволить ИИ самому исправлять свои баги, или мы так и останемся «прокладкой» между нейросетью и компилятором?