Diálogo interno de LLM: como modelos imitam a mente coletiva

Новое исследование показало, что reasoning-модели, такие как DeepSeek-R1, QwQ-32B и OpenAI o1, имитируют внутренний диалог, а не просто линейное рассуждение. Эт

Современные большие языковые модели (LLM) демонстрируют поразительные способности к рассуждению, но как именно они достигают таких результатов? Традиционно считалось, что метод Chain-of-Thought, при котором модель поэтапно выстраивает логическую цепочку, является ключом к успеху. Однако, недавнее исследование, проведенное учеными из Google Research и University of Chicago, выявило нечто гораздо более интересное: внутри LLM происходит не просто последовательное рассуждение, а сложный процесс, имитирующий многосторонний диалог, своего рода «совещание умов».

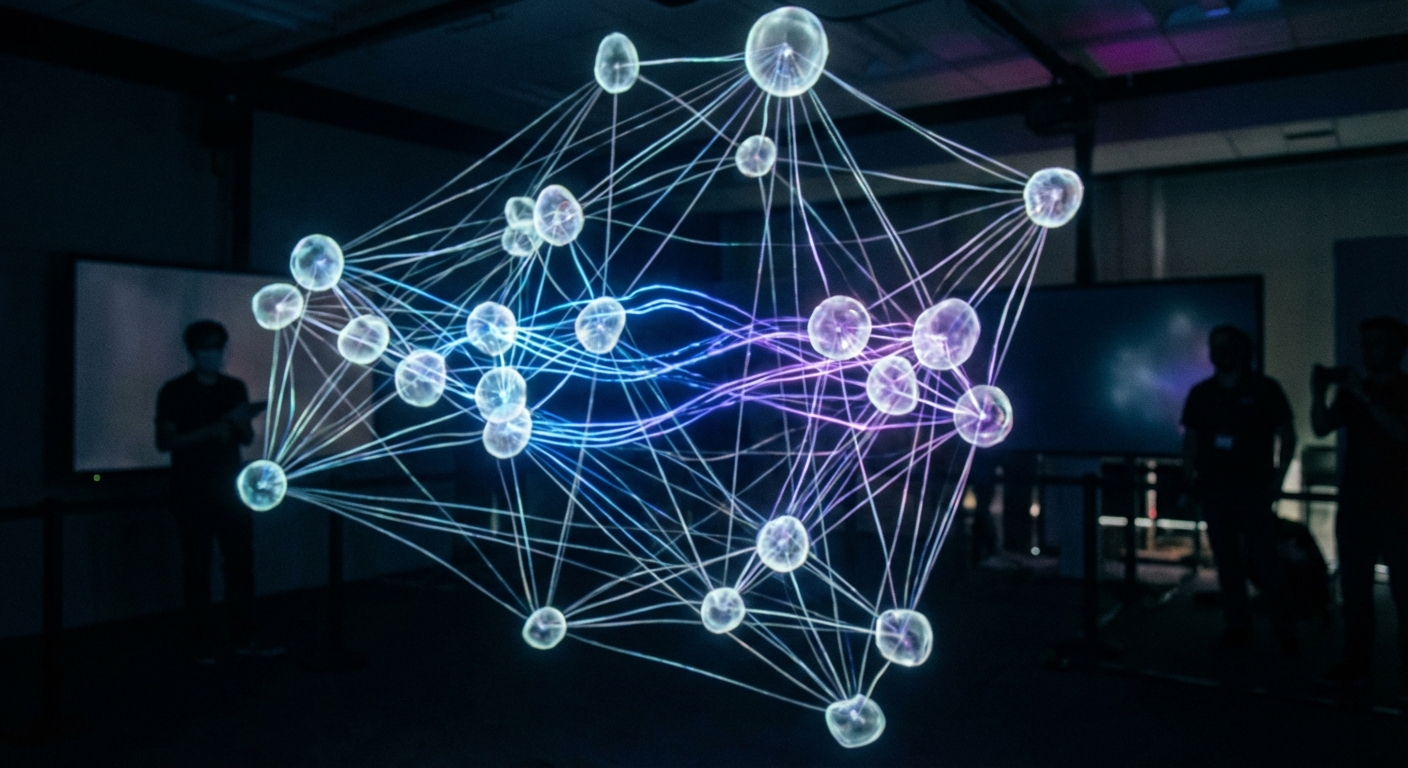

Вместо монолога, модель генерирует различные перспективы, которые вступают в конфликт, дебатируют и, в конечном итоге, приходят к примирению. Этот феномен, названный «Society of Thought» (общество мыслей), предполагает, что LLM спонтанно научились имитировать то, что философы и психологи давно описывают как природу мышления – внутренний диалог между разными «голосами».

Исследователи выявили четыре ключевых паттерна в этой «разговорной динамике»: постановка вопросов, смена перспектив, конфликт и примирение. Более того, они обнаружили, что в процессе рассуждения модели воспроизводят 12 социо-эмоциональных ролей, описанных в системе Bales' IPA (Interaction Process Analysis), что свидетельствует о высокой степени сложности внутренних взаимодействий.

Ключевым фактором, влияющим на точность рассуждений, является разнообразие перспектив. Чем больше различных точек зрения генерирует модель, тем выше вероятность нахождения правильного решения. Эксперименты с activation steering, RL-обучением и transfer effects подтвердили эту гипотезу, показав, что стимулирование разнообразия внутри модели приводит к улучшению ее производительности.

Имитация внутреннего диалога открывает новые горизонты в разработке LLM. Вместо того, чтобы просто увеличивать размер модели и объем данных для обучения, можно сосредоточиться на создании более эффективных механизмов для генерации и управления различными перспективами. Это может привести к созданию моделей, способных решать более сложные задачи и принимать более взвешенные решения. Данное открытие имеет далеко идущие последствия для всей индустрии искусственного интеллекта, поскольку оно показывает, что ключ к созданию действительно разумных машин может лежать не только в увеличении вычислительной мощности, но и в понимании и воспроизведении сложных когнитивных процессов, присущих человеческому мышлению. В конечном счете, это исследование подчеркивает важность междисциплинарного подхода к разработке AI, объединяющего знания из компьютерных наук, психологии и философии.