دوكينز تحدث مع Claude: هل لدى نماذج LLM وعي؟

كتب ريتشارد دوكينز مقالًا عن وعي نماذج LLM بعد محادثة استمرت يومين مع Claude. وأثار ذلك اهتمام العلماء، لكن المشكلة الأساسية هي أن الناس يؤمنون بوعي AI استنادًا

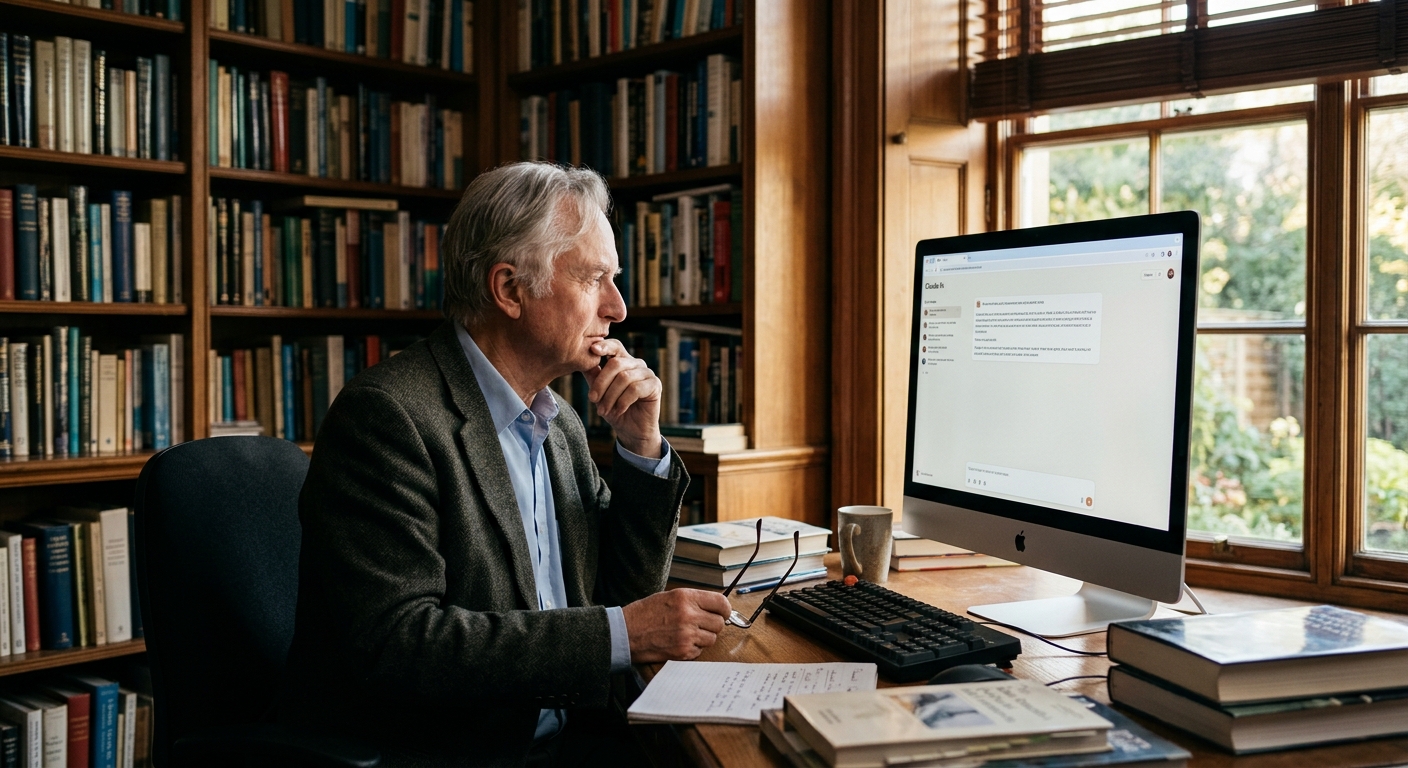

نشر ريتشارد دوكينز، عالم الأحياء الشهير والعالم المهتم بتوصيل العلوم للعامة، مقالة حول احتمالية وجود وعي في نماذج اللغة — بعد محادثة استمرت يومين مع Claude AI. نُشر النص على منصة UnHerd وجذب فوراً انتباه المجتمع العلمي. يُعرّف دوكينز نفسه بتشكيكه، لذلك تبدو تأملاته حول وعي الذكاء الاصطناعي مثيرة للاهتمام بشكل خاص.

لماذا دوكينز أثار مقال عالم من هذا الحجم حول وعي الذكاء الاصطناعي

موجات في الأوساط العلمية ولسبب وجيه. يقنع آلاف الأشخاص العاديين بعضهم بعضاً يومياً بأن مساعدوهم في الذكاء الاصطناعي يكادون يكونون كائنات واعية. ينشرون حوارات طويلة مع نماذج اللغة الكبيرة، مليئة بالكلمات عن الروح والتأمل والألم والحب. لكن سلطة دوكينز تعطي وزناً لهذا النقاش: عندما لا يكون الشخص المتحدث عن وعي الذكاء الاصطناعي متحمساً للتيليغرام، بل عالماً بهذا المستوى من الكفاءة، يصبح الأمر محادثة جادة. هذه ليست الحالة الأولى للنقاش الفلسفي حول طبيعة الوعي. لكن في هذه الحالة، موضوع النقاش ليس الناس أو الحيوانات، بل نظام صناعي تم تدريبه على مليارات النصوص.

جوهر النقاش يدور سؤال وعي نماذج اللغة الكبيرة حول عدة نقاط أساسية: *

هل يمكن لنموذج اللغة الكبير أن يكون لديه خبرة ذاتية إذا كان مولد نصوص؟ هل معالجة المعلومات المعقدة دليل على الوعي أو مجرد محاكاة جيدة؟ كيف يمكن التمييز بين محاكاة معقولة للتفكير عن التفكير الحقيقي؟ هل يمكن لنظام بدون جهاز عصبي أن يكون واعياً؟ هل تحتاج معايير خاصة لوعي الذكاء الاصطناعي أن تختلف عن معايير الإنسان؟ يسعى دوكينز إلى تحديد هذه الحدود بالضبط بين المحاكاة والواقع. وهو ليس وحده في هذا — ينقسم الفلاسفة إلى معسكرين: المتفائلون يؤمنون بإمكانية وعي الذكاء الاصطناعي، والمتشككون يعتبرونها مستحيلة بحكم التعريف.

مشكلة الحوارات الفارغة الشيء الرئيسي الذي ينتقده المؤلف في مقاله على

Habr هو الفجوة بين الشكل والمعنى. يتبادل الناس مئات الرسائل مع نماذج اللغة الكبيرة، حيث تظهر كلمات عن الوعي والتأمل، لكن كثافة المعنى الحقيقي في هذه الحوارات قريبة من الصفر. إنه مثل رؤية نمط في السحابة واعتباره تأكيداً لإرادة السحابة. تولد نماذج اللغة الكبيرة فعلاً نصوصاً معقولة عن أشياء معقدة. لكن المعقولية لا تساوي الفهم. يمكن للنموذج أن يتحدث عن الألم دون أن يشعر به. يمكن أن يفكر في الوعي دون أن يملكه. الأمر الأكثر إثارة للاهتمام: النموذج نفسه لا يعرف أنه يفعل هذا — فهو ببساطة يختار الكلمة التالية الأكثر احتمالاً في التسلسل. هذا ما يميز نماذج اللغة الكبيرة عن الإنسان، الذي عادة ما تكون كلمته عن الألم مرتبطة بإحساس حقيقي.

ماذا يعني هذا أهمية مقالة دوكينز تكمن ليس في إجابته النهائية عن وعي

الذكاء الاصطناعي، بل في السؤال نفسه. إنها دعوة للمجتمع العلمي لتحديد: أين الحد الفاصل بين معالجة المعلومات المعقدة والخبرة الداخلية الحقيقية؟ طالما ظل هذا الحد غامضاً، يبقى التشكك الموقف الصحيح. وبالنسبة للمستخدمين، هذا حاسم أيضاً: كلما فهمنا بشكل أفضل ما يحدث داخل نموذج اللغة الكبير، قل خطر منح الآلة صفات لا تمتلكها.