قدمت Moonshot AI Attention Residuals — بديلاً عن residual connections في transformers

عرضت Moonshot AI Attention Residuals كطريقة جديدة لجمع الإشارات بين طبقات transformer ليس عبر جمع ثابت، بل عبر attention على امتداد العمق. وفي الاختبارات، وصل B

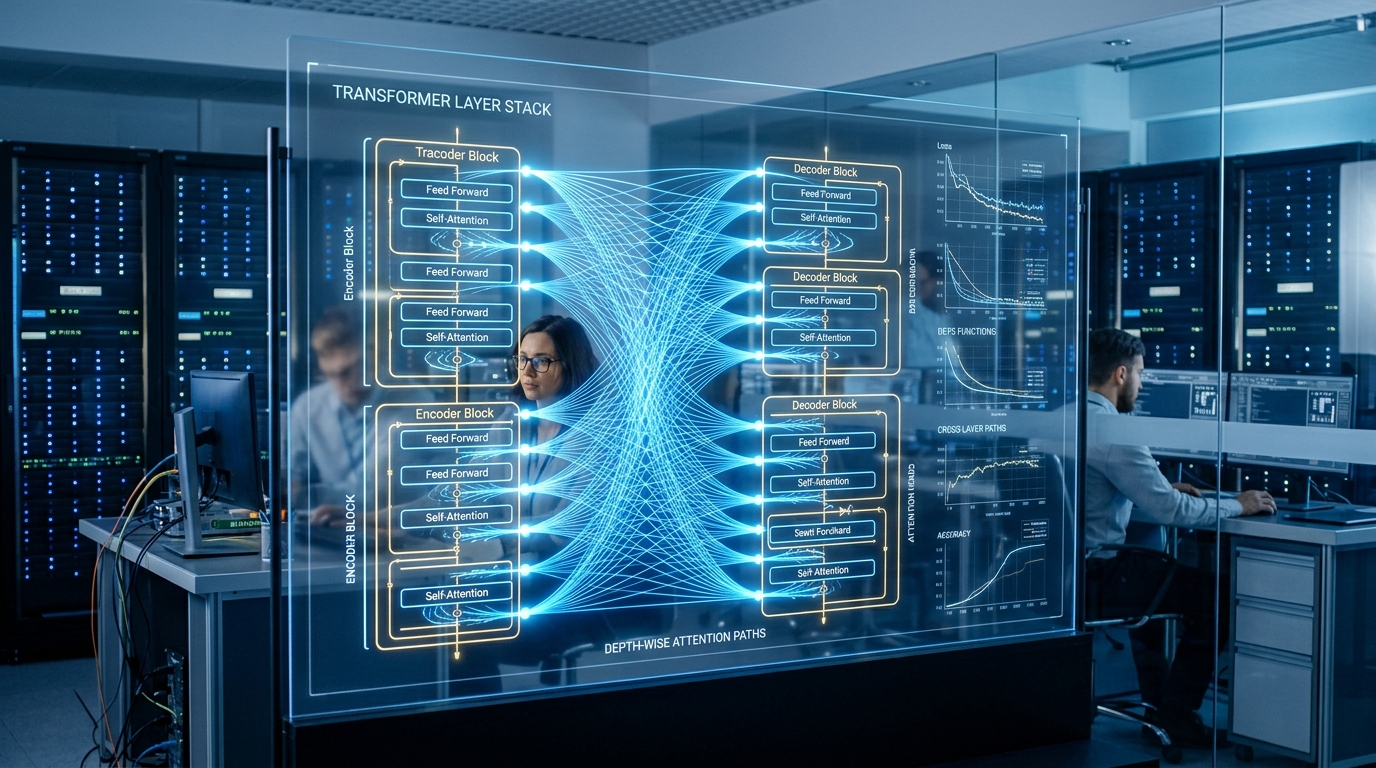

Moonshot AI выпустила Attention Residuals — архитектурное обновление для трансформеров, которое меняет один из самых базовых элементов модели: остаточные связи. Вместо фиксированного суммирования выходов всех прошлых слоёв команда предлагает depth-wise attention, чтобы модель сама решала, какие представления из глубины сети ей реально нужны.

Где узкое место В большинстве современных LLM каждый новый слой не

просто обрабатывает вход, а добавляет свой результат к общему скрытому состоянию. Такая схема, унаследованная от residual-подхода и особенно популярная в PreNorm-архитектурах, помогает обучать глубокие сети без развала градиентов. Но у неё есть цена: все предыдущие представления смешиваются с одинаковым весом, а их вклад со временем размывается.

По мере роста глубины скрытые состояния увеличиваются примерно линейно, и ранние сигналы всё труднее извлечь в полезном виде. Moonshot AI называет это проблемой depth-wise aggregation: модель хорошо научилась выбирать важные токены по последовательности и маршрутизировать экспертов в MoE, но по глубине сети всё ещё живёт на фиксированном суммировании. Исследователи проводят прямую аналогию с эпохой RNN: когда-то последовательность тоже сжималась в одно состояние, пока attention не дал каждому токену доступ ко всем предыдущим шагам.

Здесь предлагается сделать почти то же самое, только не по времени, а по слоям.

Как устроен

AttnRes В Attention Residuals каждый слой получает не общую сумму всех прошлых выходов, а взвешенную комбинацию предыдущих представлений через softmax-attention. Вес зависит от самого слоя и входных данных, поэтому сеть может усиливать полезные сигналы и ослаблять шум, а не наследовать одинаково всё подряд. В практическом варианте для этого используется очень лёгкий механизм: один обучаемый вектор-псевдозапрос на слой.

За счёт этого идея выглядит не как радикальная перестройка трансформера, а как относительно компактная замена привычной residual-схемы. Полная версия AttnRes требует хранить все предыдущие состояния, поэтому для больших моделей Moonshot AI предлагает Block AttnRes. Слои разбиваются на блоки, внутри блока остаётся обычное накопление, а attention применяется уже между сводными представлениями блоков.

По данным команды, конфигурация примерно с восемью блоками сохраняет большую часть выигрыша полной версии, снижает требования к памяти и коммуникациям с O(Ld) до O(Nd) и держит дополнительную задержку на инференсе ниже 2%.

Что показали тесты

Moonshot AI проверила подход не только на scaling-law экспериментах, но и на крупной предобученной модели Kimi Linear с 48 млрд параметров, из которых 3 млрд активируются, после обучения на 1,4 трлн токенов. Ключевой тезис такой: Block AttnRes достигает той же функции потерь, что и базовая модель, обученная с вычислительным бюджетом в 1,25 раза больше. То есть речь не про косметический тюнинг, а про потенциально более выгодное масштабирование.

- GPQA-Diamond: 36.9 → 44.4 HumanEval: 59.1 → 62.2 MMLU: 73.5 → 74.6 C-Eval: 79.6 → 82.5 Задержка на инференсе: менее 2% Отдельно важна динамика обучения. В отчёте команда пишет, что AttnRes смягчает эффект PreNorm dilution: амплитуда скрытых состояний не расползается с глубиной, а нормы градиентов распределяются по слоям ровнее. На практике это означает более управляемое обучение и меньшую вероятность того, что часть глубины модели работает как дорогой, но слабо полезный балласт. Самые заметные приросты пришлись на многошаговое рассуждение и кодогенерацию, что делает работу особенно интересной для будущих LLM и агентных систем.

Что это значит

Это не новый чат-бот и не пользовательская фича, а попытка переписать один из базовых строительных блоков трансформеров. Если результаты Moonshot AI подтвердятся на других архитектурах и в индустриальных стеках, гонка за качество LLM всё сильнее будет идти не только через больше данных и GPU, но и через более умную внутреннюю механику самих моделей.