أقر إيلون ماسك بأن xAI استخدمت نماذج OpenAI لتدريب Grok وتحسينه

أكد إيلون ماسك أمام المحكمة أن xAI استخدمت «جزئياً» نماذج OpenAI لتحسين Grok. والمقصود هنا هو التقطير، وهو نهج يساعد فيه نموذج أقوى على تدريب نموذج أصغر أو أقل

Илон Маск во время слушаний по своему иску к OpenAI подтвердил, что xAI использовала модели OpenAI для улучшения Grok. В суде он назвал это лишь «частичной» практикой, но этого хватило, чтобы вынести на публику один из самых спорных методов обучения современных AI-систем.

Что признал

Маск На заседании федерального суда в Калифорнии Маска спросили, знает ли он, что такое model distillation, и применяла ли xAI этот подход к технологиям OpenAI. Сначала он ответил уклончиво и заметил, что так или иначе подобное делают «в целом все AI-компании». Когда юристы уточнили, означает ли это «да», Маск ответил коротко: «частично». Это важное признание не только из-за самой xAI. Оно прозвучало в рамках процесса, где Маск пытается доказать, что OpenAI отошла от своей исходной миссии и действует вразрез с тем, ради чего он помогал запускать компанию. На таком фоне признание использования моделей конкурента выглядит политически и юридически чувствительным. Фактически речь идет о признании практики, которую сами участники рынка всё чаще выносят в публичные претензии друг к другу.

Как работает дистилляция

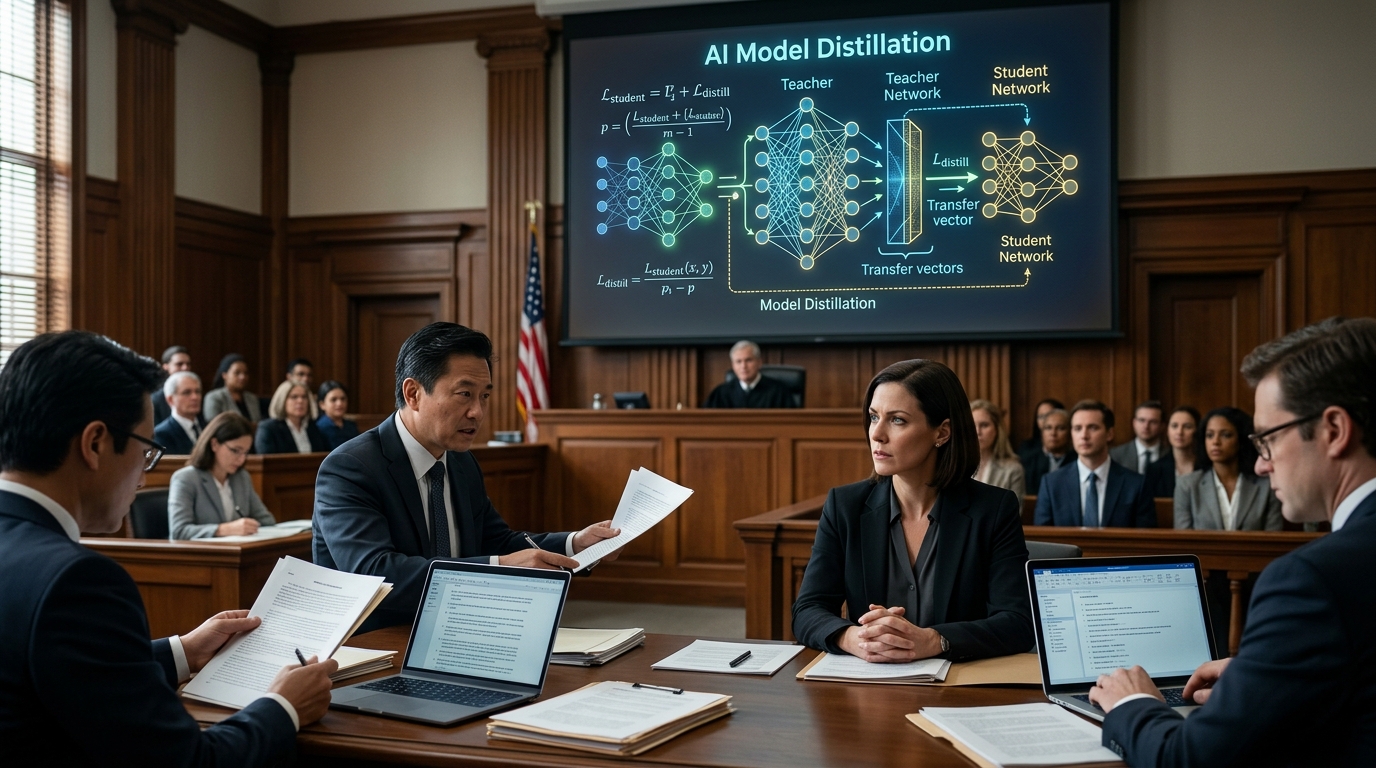

Дистилляция моделей — это схема, в которой более крупная и сильная система выступает «учителем», а более компактная модель — «учеником». Вместо того чтобы обучать новую модель только на сырых данных, разработчики используют ответы, оценки или поведенческие паттерны более мощной модели и передают их студенту. Это помогает быстрее подтянуть качество и сэкономить вычислительные ресурсы.

«Использовать другие AI для проверки собственного AI — стандартная практика».

Внутри одной компании такой подход давно считается нормальным: лаборатории регулярно уменьшают собственные флагманские модели, чтобы выпускать более дешёвые и быстрые версии. Проблема начинается там, где в роли «учителя» выступает модель конкурента. Тогда вопрос уже не только технический, но и правовой: это честная оптимизация или попытка дёшево скопировать чужие возможности? Именно здесь и проходит главная линия напряжения между скоростью разработки и защитой интеллектуального преимущества.

Почему спор растет Именно поэтому дистилляция стала одной из самых болезненных тем на AI-рынке.

Формально метод сам по себе не запрещён, но границы допустимого часто упираются в пользовательские соглашения, внутренние политики и то, как именно собирались данные для обучения. Из-за этой серой зоны компании всё чаще обвиняют друг друга не в прямом копировании кода, а в переносе поведения моделей. Судебных прецедентов пока немного, поэтому правила игры в этой зоне по сути формируются в реальном времени.

- Дистилляция сокращает стоимость обучения и ускоряет выпуск новых моделей.

- Она позволяет более маленьким лабораториям быстрее догонять лидеров рынка.

- Использование внешней модели может противоречить условиям сервиса её владельца.

- Доказать, где заканчивается «валидация» и начинается копирование возможностей, очень сложно. Ранее OpenAI уже публично выражала обеспокоенность тем, что её модели могут использоваться для подобных задач, а Anthropic отдельно называла DeepSeek, Moonshot и MiniMax среди компаний, вызывающих у неё вопросы. Google тоже пытается защищаться от того, что называет «атаками дистилляции» и нарушением своих условий использования. Теперь выяснилось, что даже участники самых громких судебных конфликтов в индустрии сами не стоят в стороне от этой практики.

Что это значит

История с xAI показывает, что дистилляция окончательно стала нормой рынка — даже если публично компании критикуют её у конкурентов. Для индустрии это сигнал: споры вокруг AI всё больше будут идти не только о данных и авторских правах, но и о том, можно ли «научиться» у чужой модели, не нарушая правил. И именно такие процессы могут определить, где в ближайшие годы пройдет граница между конкурентной разведкой, инженерной оптимизацией и нарушением правил платформы.