غوتنبرغ أوكلت توزيع أماكن المدارس إلى خوارزمية — فحصلت على فوضى بدون مسؤولين

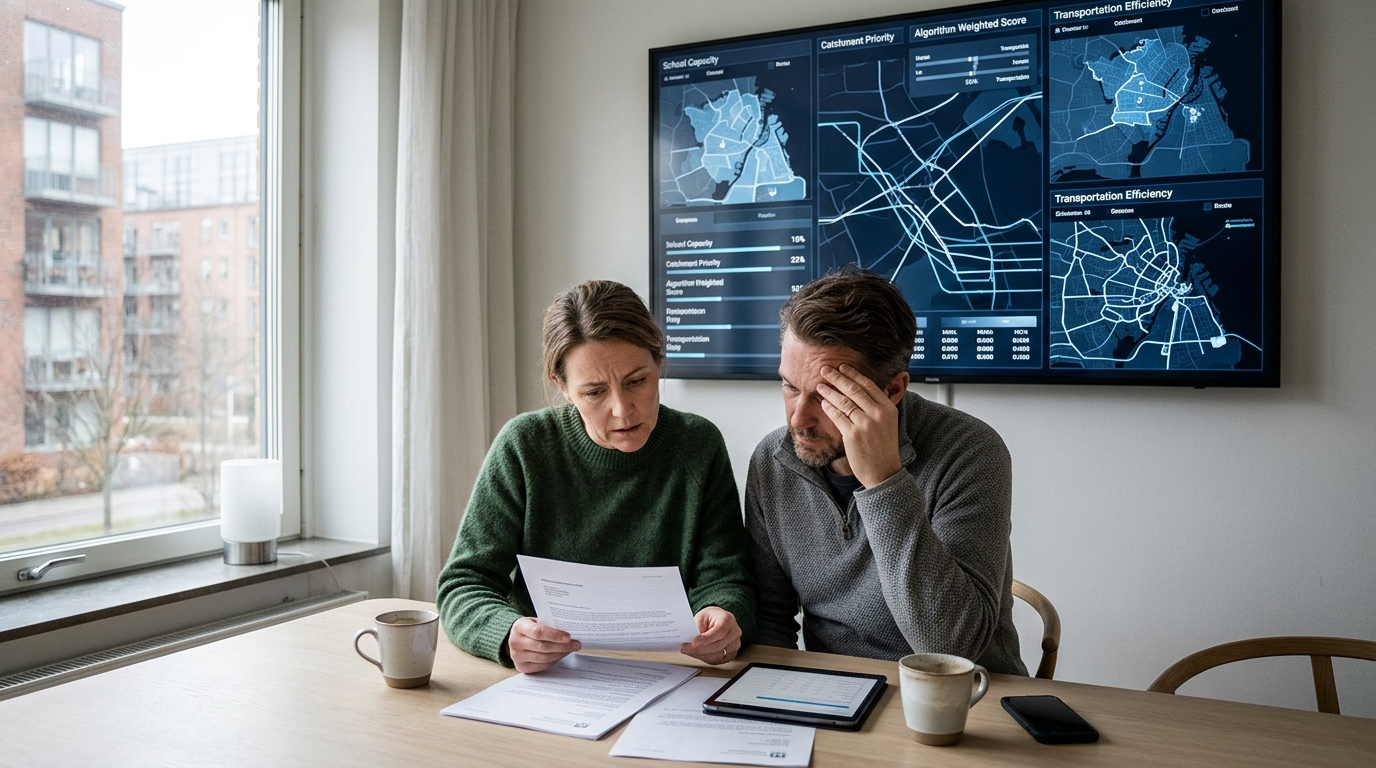

أوكلت غوتنبرغ إلى خوارزمية توزيع الأماكن في المدارس، وعدت بالحياد والسهولة. في الواقع، حولت النظام عملية التسجيل إلى عملية غير شفافة: لم يفهم الآباء منطق القرار

В шведском Гётеборге алгоритм впервые распределил места в школах и должен был сделать систему справедливее и эффективнее. Вместо этого он превратил поступление в непрозрачный процесс, где семьи столкнулись с хаосом, а город — с вопросом, кто отвечает за решение, принятое кодом.

Как появился алгоритм В 2020 году городские власти решили

автоматизировать одну из самых болезненных муниципальных задач — распределение детей по школам. Логика выглядела убедительно: машине проще, чем чиновникам, одновременно учитывать расстояние до школы, пожелания семей, зоны приёма и доступные места. Такой подход продавался как техническое улучшение, а не как политическое решение.

Алгоритм подавали почти как нейтральный инструмент, который просто быстрее и точнее считает варианты. Именно в этом и был главный соблазн. Когда решение упаковано в язык оптимизации, оно кажется лишённым человеческой предвзятости.

Но школьный приём — это не только математика. За каждой строкой в таблице стоят семьи, маршруты, повседневная логистика, чувство безопасности и доверие к системе. Если такой механизм даёт сбой, проблема уже не выглядит как обычная административная ошибка: она становится ударом по людям, которые не могут ни проверить ход расчёта, ни понять, почему их ребёнок оказался не там, где ожидалось.

Где начались проблемы Обещанная объективность быстро столкнулась с реальностью.

Вместо понятной процедуры родители получили решения, логику которых им никто не мог нормально объяснить. Для одних семей это означало более длинную дорогу до школы, для других — разрушение заранее выстроенных планов. Когда люди пытались разобраться, почему система сработала именно так, перед ними возникала привычная для цифровой бюрократии стена: решение есть, а ответственного лица как будто нет.

Последствия такой автоматизации проявились сразу в нескольких точках: родители не понимали критерии распределения; чиновники ссылались на систему, а не на собственное решение; техническая сложность мешала оспорить результат по существу; ошибка, если она возникала, масштабировалась сразу на множество семей; * нейтральность алгоритма оказалась скорее обещанием, чем доказанным фактом. Самый болезненный момент в этой истории — не сам сбой, а невозможность добиться ясности. Когда автор текста попыталась оспорить решение через суд, выяснилось, насколько плохо право и госуправление приспособлены к спорам с автоматизированными системами.

Формально решение вроде бы принято, процедура вроде бы существует, но на практике человек спорит не с конкретным чиновником, а с логикой, скрытой внутри кода и административного процесса. В таком споре гражданин почти всегда стартует из слабой позиции.

Почему алгоритм победил

Случай в Гётеборге показывает более широкую проблему: цифровые системы в госсекторе часто внедряют под лозунгом эффективности, не выстраивая сопоставимую систему ответственности. Если решение принимает человек, его можно спросить о мотивах, ошибке, исключении из правил. Если решение делает алгоритм, цепочка ответственности распадается на части: разработчики говорят, что они лишь реализовали требования; чиновники — что доверились модели; юристы — что формально регламент соблюдён.

В итоге пострадавший остаётся один на один с системой, у которой нет лица. Из-за этого алгоритм в общественном восприятии и «побеждает». Не потому, что он обязательно прав, а потому, что его трудно вскрыть, проверить и поставить под сомнение на понятном языке.

Техническая непрозрачность начинает работать как форма власти. Код, созданный для упрощения процесса, превращается в барьер между гражданином и государством. И чем сильнее власти называют такую систему объективной, тем сложнее признать, что внутри неё могут быть спорные допущения, кривые настройки или просто плохие управленческие решения.

Что это значит

История со школьным распределением в Гётеборге — это предупреждение для всех, кто автоматизирует социально чувствительные решения. Алгоритм может ускорить процесс, но не может заменить объяснимость, право на апелляцию и живую ответственность. Если эти элементы не встроены заранее, любая «эффективность» легко оборачивается цифровой несправедливостью.