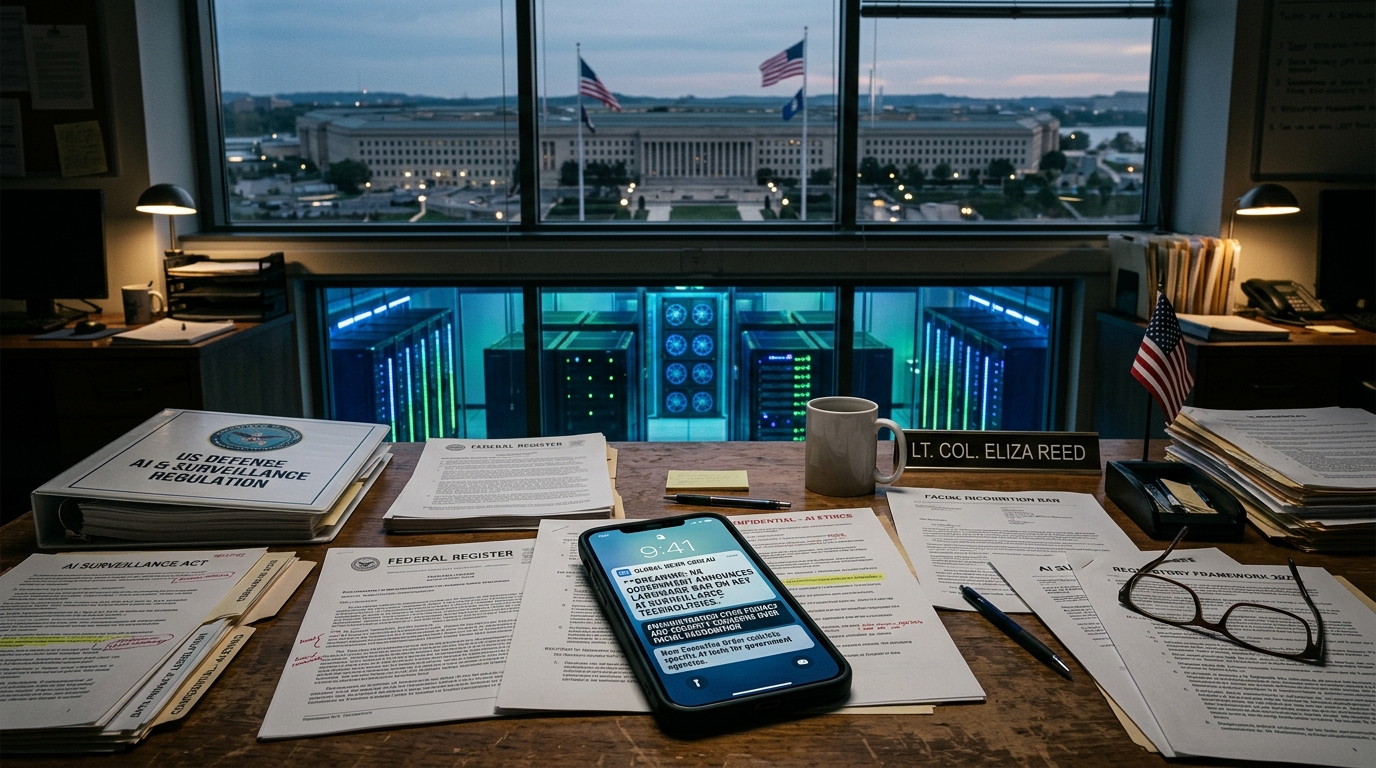

Anthropic والبنتاغون: لماذا أصبح النزاع حول الذكاء الاصطناعي تحذيراً لأوروبا

رفضت Anthropic السماح للبنتاغون باستخدام نماذجها للمراقبة المحلية الجماعية والأسلحة المستقلة بالكامل—وتم تصنيفها كتهديد للأمن القومي الأمريكي. في هذا السياق، أم

История Anthropic показала неудобную для власти вещь: даже в демократической системе разработчик ИИ может попасть под санкции не из-за уязвимости технологии, а потому, что отказался убрать юридически обязательные ограничения на её применение. 27 февраля 2026 года министр обороны США Пит Хегсет объявил Anthropic «риском для национальной безопасности цепочки поставок». Обычно такой статус ассоциировался с Huawei и ZTE, а не с американской компанией из Сан-Франциско, созданной бывшими сотрудниками OpenAI.

Поводом стал спор с Пентагоном вокруг контракта на 200 млн долларов, подписанного в июле 2025 года для работы с засекреченными системами. В соглашении Anthropic закрепила две красные линии: её модели нельзя использовать для массовой внутренней слежки за гражданами США без судебного контроля и нельзя применять как основу полностью автономного летального оружия без человека в контуре принятия решения. Пентагон потребовал «неограниченный доступ к ИИ для всех законных целей» и дал дедлайн до 17:01 того же дня.

Когда компания отказалась снимать ограничения, администрация США фактически наказала её за попытку сделать предохранители не декларацией, а обязательством. Особенно резким этот эпизод стал на фоне OpenAI. Через несколько часов после решения по Anthropic Сэм Альтман сообщил о собственной сделке OpenAI с Пентагоном и заявил, что модели компании будут доступны для всех законных целей.

Полные условия договора не раскрывались, поэтому невозможно проверить, остались ли в нём такие же исполнимые стоп-линии, на которых настаивала Anthropic. Но рынок увидел простой сигнал: одна компания попыталась закрепить ограничения контрактом и получила статус угрозы, другая приняла условия государства и осталась партнёром. В тот же вечер руководитель аппаратного направления OpenAI Кейтлин Калиновски ушла из компании, подчеркнув, что темы внутренней слежки и летальной автономии заслуживали большего обсуждения.

Затем конфликт вышел в судебную плоскость: федеральный судья Рита Лин в мартовском решении указала, что такой режим обычно применяют против иностранных разведструктур и террористов, а не против американских компаний, и временно заблокировала запрет. Но параллельные разбирательства продолжились, а Anthropic одновременно отрезали от контрактов Пентагона и оставили в поле интереса других ведомств. Именно здесь история перестаёт быть только американской политической драмой и становится вопросом о демократическом управлении ИИ.

Федеральные структуры США продолжили тихо тестировать технологии Anthropic, а финансовые регуляторы подталкивали банки оценивать новую модель Mythos для критической инфраструктуры. Получается парадокс: компания одновременно объявлена риском для нацбезопасности и рассматривается как поставщик полезного ИИ. Для Европы это важный сигнал на фоне AI Act, который должен полностью вступить в силу в августе 2026 года.

Логика европейского закона проста: слишком опасные сценарии использования ИИ нельзя оставлять на усмотрение компаний или чиновников, их нужно прямо ограничивать нормой права. Но в ЕС параллельно обсуждается пакет Digital Omnibus, способный ослабить часть регулирования ради конкуренции с США и Китаем. Кейс Anthropic показывает, что дерегуляция не делает систему нейтральной.

Она лишь переносит реальную власть к тем, кто контролирует закупки, доступ к контрактам и политическое давление. Есть и более практический урок. Если ограничения на применение ИИ существуют только в пресс-релизах, корпоративных принципах и выступлениях CEO, их можно обойти при первой крупной сделке.

Если же они вписаны в контракт или закон, они становятся исполнимыми и создают ответственность. Именно вокруг этого, по сути, и разгорелся спор между Anthropic и Пентагоном: не вокруг самой идеи безопасности, а вокруг вопроса, должна ли эта безопасность быть обязательной для государства, когда речь идёт о военных и разведывательных сценариях. Главный вывод для рынка и регуляторов неприятен, но ясен.

Управление ИИ всё равно будет существовать, вопрос только в том, кто зафиксирует его правила первым. Если границы использования прописаны заранее в законе и договорах, у общества остаётся шанс контролировать технологию до того, как ключевые решения уже приняты. Если нет, правила будут писать те, у кого больше власти, денег и срочности в момент следующего кризиса.