وضع WebSocket من OpenAI يغيّر قواعد اللعبة للـ AI الصوتي

أطلقت OpenAI وضع WebSocket لـ Realtime API الخاص بها، ما يخفض زمن التأخير بشكل جذري في تطبيقات AI الصوتية. في السابق، كان إنشاء وكيل صوتي يتطلب سلسلة من ثلاث مر

Задержка — главный враг любого голосового интерфейса. Пауза длиной в секунду между вашей фразой и ответом AI-ассистента мгновенно разрушает ощущение живого разговора и превращает взаимодействие в утомительное ожидание. OpenAI, судя по всему, решила атаковать эту проблему в лоб, представив WebSocket-режим для своего Realtime API — технологическое решение, которое может фундаментально изменить архитектуру голосовых AI-приложений.

Чтобы понять масштаб изменений, стоит разобраться, как голосовые AI-агенты работали до сих пор. Классическая архитектура напоминала конвейер из трёх отдельных станций. Сначала аудио пользователя отправлялось в модель распознавания речи (Speech-to-Text), которая превращала звук в текст. Затем этот текст передавался большой языковой модели вроде GPT для генерации ответа. Наконец, текстовый ответ уходил в систему синтеза речи (Text-to-Speech), которая озвучивала его. Каждый из этих переходов — это отдельный API-запрос, отдельное сетевое соединение, отдельная очередь на сервере. Инженеры в индустрии метко сравнивали такую систему с машиной Руба Голдберга — чрезмерно сложным механизмом для выполнения, казалось бы, простой задачи. Суммарная задержка легко достигала полутора-двух секунд, а в пиковые моменты нагрузки могла быть ещё больше.

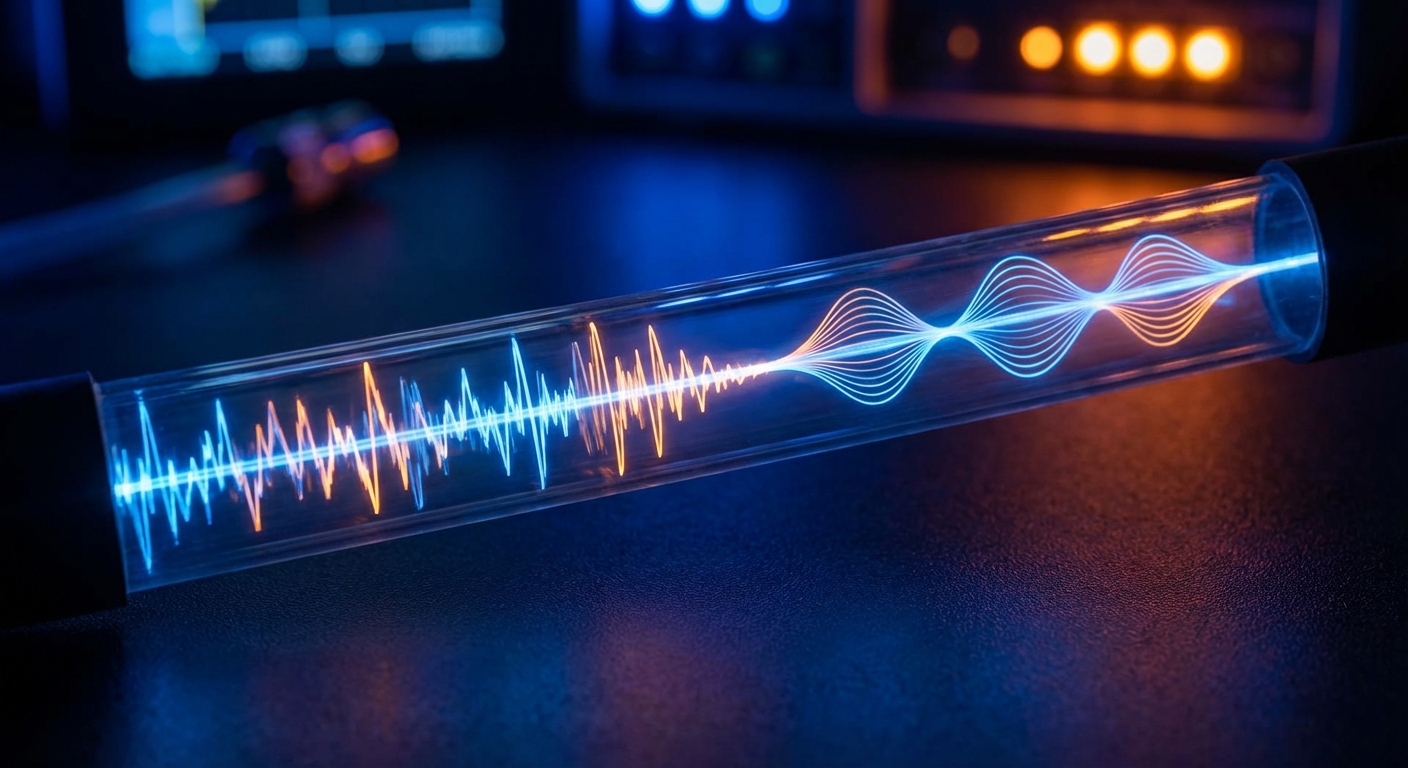

WebSocket-режим OpenAI предлагает принципиально иной подход. Вместо трёх последовательных HTTP-запросов клиент устанавливает одно постоянное WebSocket-соединение с сервером. Через это соединение аудио передаётся в обоих направлениях непрерывным потоком. Пользователь начинает говорить — и аудиоданные уже летят на сервер. Модель начинает генерировать ответ — и синтезированная речь уже течёт обратно к клиенту, даже если генерация ещё не завершена. Это не просто оптимизация существующего конвейера, а его полная замена на единую мультимодальную модель, которая принимает аудио на вход и отдаёт аудио на выход, минуя промежуточные текстовые представления.

Технически это стало возможным благодаря нескольким факторам. Во-первых, сами модели OpenAI стали нативно мультимодальными — GPT-4o и её последователи умеют работать с аудио напрямую, без промежуточной транскрипции. Во-вторых, протокол WebSocket, в отличие от классического HTTP, поддерживает полнодуплексную связь: данные могут одновременно передаваться в обе стороны, что идеально подходит для имитации естественного диалога. В-третьих, потоковая генерация позволяет начинать воспроизведение ответа ещё до того, как модель закончила его формировать — точно так же, как человек начинает слышать собеседника с первого слога, а не ждёт, пока тот договорит всё предложение.

Последствия для индустрии трудно переоценить. Голосовые интерфейсы до сих пор оставались нишевым продуктом во многом именно из-за проблемы задержки. Siri, Alexa и Google Assistant — все они страдают от ощутимых пауз, которые делают разговор неестественным. Снижение задержки до уровня, близкого к реальному времени, открывает дорогу совершенно новым сценариям. Телемедицина с AI-ассистентом, который мгновенно реагирует на слова пациента. Образовательные приложения, где AI-репетитор ведёт живой диалог без раздражающих пауз. Игровые NPC, которые отвечают так же быстро, как живой актёр. Корпоративные колл-центры, где AI-оператор неотличим от человека по скорости реакции.

Впрочем, есть и оборотная сторона. Постоянное WebSocket-соединение потребляет больше серверных ресурсов, чем разовые API-вызовы, а значит, стоимость для разработчиков может оказаться выше. Кроме того, зависимость от единого провайдера — OpenAI — усиливается: если раньше можно было комбинировать лучшие STT, LLM и TTS от разных компаний, то теперь весь стек замыкается на одну экосистему. Это классический компромисс между удобством и гибкостью, и не все команды сделают выбор в пользу первого.

Стоит также отметить контекст конкурентной борьбы. Google с проектом Gemini активно развивает собственные мультимодальные возможности в реальном времени. ElevenLabs и другие стартапы в области синтеза речи тоже работают над снижением задержки. Но у OpenAI есть стратегическое преимущество: компания контролирует и языковую модель, и инфраструктуру доставки, что позволяет оптимизировать весь путь данных от микрофона пользователя до динамика.

WebSocket-режим OpenAI — это не просто техническое обновление API. Это сигнал о том, что эра текстовых чатботов постепенно уступает место эре голосовых AI-агентов. И главный барьер на этом пути — задержка — начинает рушиться. Вопрос теперь не в том, появятся ли по-настоящему естественные голосовые AI-интерфейсы, а в том, как быстро они станут нормой повседневной жизни.