الذكاء الاصطناعي وأزمة الحقيقة: لماذا خفنا الشيء الخاطئ تماماً

Долгое время нас пугали «апокалипсисом правды», где ИИ-дипфейки заставят верить в ложь. Но реальность оказалась ироничнее. Проблема не в том, что мы верим фейка

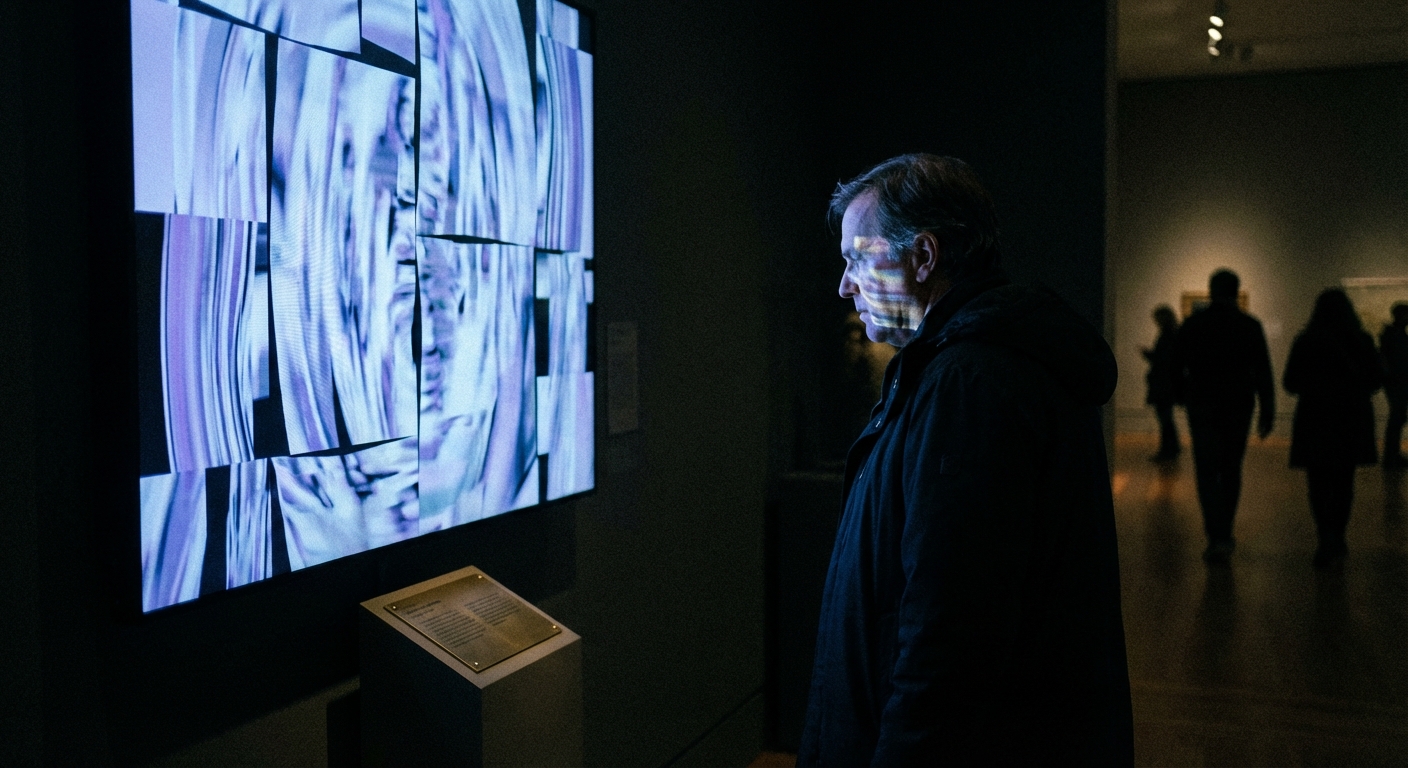

Помните те времена, когда главной страшилкой про ИИ были дипфейки? Нам обещали апокалипсис, в котором мы не сможем отличить видео с президентом от работы нейросети. Мы готовились к войне за истину, вооружившись детекторами и фактчекингом. Но, кажется, мы просмотрели самое важное: ИИ ломает не картинку на экране, а наш способ воспринимать реальность в принципе. Оказалось, что даже если мы ловим нейросеть на лжи, ущерб уже нанесен.

Концепция «распада правды» обсуждается годами, но сейчас она вошла в фазу, которую мало кто предвидел. Традиционно мы считали, что решение проблемы лежит в области технологий: создадим водяные знаки, обучим классификаторы, и всё будет в порядке. Однако психологические исследования показывают пугающую вещь. Даже когда человек знает, что контент создан ИИ, ложная информация все равно оседает в его памяти и влияет на будущие суждения. Это своего рода ментальный вирус, против которого у нас нет иммунитета.

Что действительно изменилось, так это стоимость создания сомнения. Раньше, чтобы подорвать доверие к событию, требовались ресурсы целых медиахолдингов или спецслужб. Теперь достаточно пары запросов к языковой модели. Но ирония в том, что главной жертвой становится не ложь, а сама правда. В мире, где всё может быть подделкой, самым простым выходом для психики становится отказ верить чему-либо вообще. Это состояние называют «дивидендом лжеца»: теперь любому политику или корпорации достаточно заявить, что компрометирующая их реальная запись — это всего лишь «генерация нейросети».

Мы слишком долго фокусировались на вопросе «как отличить фейк?», игнорируя вопрос «как сохранить доверие?». Пока инженеры пытаются встроить невидимые метки в пиксели, общество теряет общую почву под ногами. Если раньше мы спорили об интерпретации фактов, то теперь мы спорим о самом существовании этих фактов. И здесь кроется главная ловушка: чем больше мы тренируем в себе подозрительность к ИИ, тем более уязвимыми мы становимся для манипуляций в реальном мире.

Ситуация усугубляется тем, что алгоритмы соцсетей по-прежнему поощряют вовлеченность, а не точность. ИИ-контент, вызывающий ярость или восторг, распространяется быстрее, чем любое опровержение. В итоге мы получаем среду, где правда просто невыгодна с точки зрения охватов. Мы строим цифровую инфраструктуру на фундаменте из зыбучих песков, и пока не видно ни одного серьезного архитектурного решения, которое могло бы это исправить.

Вместо того чтобы искать техническую «серебряную пулю», нам придется признать: кризис правды — это не технический баг, а социальная патология. Мы привыкли доверять своим глазам и ушам, но эта эпоха закончилась. Теперь доверие должно строиться на репутации институтов и прозрачности процессов, а не на качестве картинки. Но готовы ли мы к такой радикальной перестройке мышления?

Главное: проблема не в том, что ИИ слишком хорошо врет, а в том, что мы слишком легко перестаем верить в правду. Сможем ли мы восстановить доверие до того, как оно окончательно превратится в артефакт прошлого?