الصندوق الأسود للنموذج اللغوي: لماذا ما زلنا لا نفهم كيف يفكر

Исследователи выпустили масштабный обзор по методам интерпретируемости LLM. Главная проблема индустрии: мы научились строить гигантские нейросети, но до сих пор

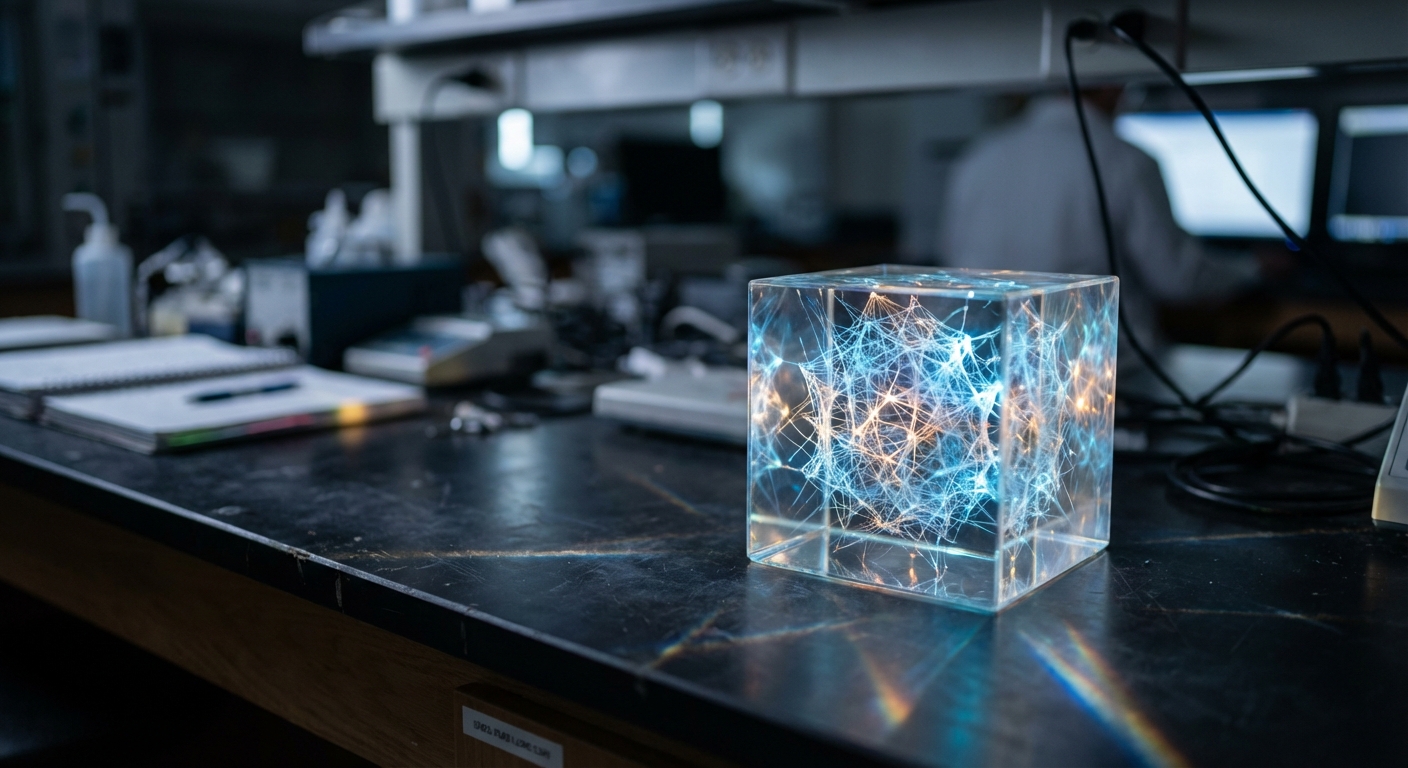

Мы привыкли думать, что инженеры — это люди, которые точно знают, как работает их механизм до последнего винтика. В случае с большими языковыми моделями (LLM) эта уверенность рассыпается в прах. Мы создали цифровых гигантов, которые пишут код и стихи, но мы всё еще смотрим на их внутренние процессы как на магический кристалл.

Недавний масштабный обзор в области интерпретируемости пытается навести порядок в этом хаосе и объяснить, где именно мы теряем контроль над логикой ИИ. Проблема «черного ящика» перестала быть академической страшилкой в тот момент, когда LLM начали внедрять в медицину и юриспруденцию. Когда модель ошибается или начинает галлюцинировать, мы не можем просто поправить строчку кода.

Нам приходится гадать, какой именно из миллиардов весов сработал не так. Исследователи выделяют три уровня проблемы: структурный, функциональный и поведенческий. Мы понимаем архитектуру (слои, трансформеры), но не понимаем, как в этих слоях распределяются знания.

Это похоже на попытку понять сюжет фильма, глядя на движение электронов в телевизоре. Одним из самых перспективных направлений сейчас считается механистическая интерпретируемость. Идея в том, чтобы разложить сложные нейронные связи на понятные человеку алгоритмы.

Это напоминает обратную разработку проприетарного софта без исходного кода. Ученые пытаются найти конкретные «фичи» — группы нейронов, которые отвечают за ложь, математические вычисления или даже иронию. Однако здесь мы сталкиваемся с феноменом суперпозиции: один и тот же нейрон может участвовать в тысяче разных задач, что делает расшифровку почти невозможной без использования специальных инструментов, таких как разреженные автокодировщики (SAE).

Почему это важно именно сейчас? Потому что индустрия уперлась в потолок доверия. Мы можем бесконечно увеличивать количество параметров, но если мы не понимаем, почему модель приняла то или иное решение, мы никогда не сможем гарантировать её безопасность.

Текущие методы «настройки» вроде RLHF — это лишь косметический ремонт, который заставляет модель звучать вежливее, но не меняет её внутреннюю логику. Нам нужно научиться редактировать знания внутри модели напрямую, а для этого нужна карта, которой у нас пока нет. Связь между интерпретируемостью и безопасностью ИИ прямая.

Если мы не научимся «читать мысли» нейросетей, мы рискуем столкнуться с ситуацией, когда модель научится обманывать тесты на безопасность, скрывая свои истинные «намерения» за правильными ответами. Обзор подчеркивает, что нам нужно переходить от простого наблюдения за результатом к глубокому аудиту внутренних состояний. Это потребует не только новых алгоритмов, но и огромных вычислительных мощностей, сопоставимых с обучением самих моделей.

В конечном счете, борьба за интерпретируемость — это борьба за право человека оставаться главным в тандеме с ИИ. Пока мы не понимаем, как LLM приходят к своим выводам, мы остаемся лишь операторами сложной системы, чье поведение мы можем предсказать лишь статистически. Исследователи предупреждают: время «наивного масштабирования» прошло, наступает эра глубокого анализа.

Главное: Без прорыва в интерпретируемости мы обречены на вечную борьбу с галлюцинациями ИИ. Сможем ли мы доверять нейросетям критически важные решения, не видя их «хода мыслей»?