Три закона Азимова из фантастики становятся реальностью гуманоидных роботов

Три закона робототехники Азимова из фантастики становятся инженерной реальностью. Гуманоидные роботы учатся ходить, падать и вставать, но вопрос безопасности те

Три закона робототехники Азимова из фантастики становятся реальностью. Более 80 лет назад писатель сформулировал простые правила для машин, которые казались чисто умозрительными. Но сегодня, когда гуманоидные роботы учатся ходить, бегать и брать предметы, эта задача превратилась в конкретную инженерную проблему.

Азимовские законы: напоминание

Первый закон: робот не может причинить вред человеку или своим бездействием допустить его. Второй: робот должен подчиняться приказам человека, кроме случаев, противоречащих первому закону. Третий: робот должен защищать своё существование, если это не противоречит первым двум.

«Машина может быть умнее, но она останется рабом; человек может быть не столько умнее, но он будет хозяином», —

Азимов уловил в этих трёх строчках суть взаимоотношений.

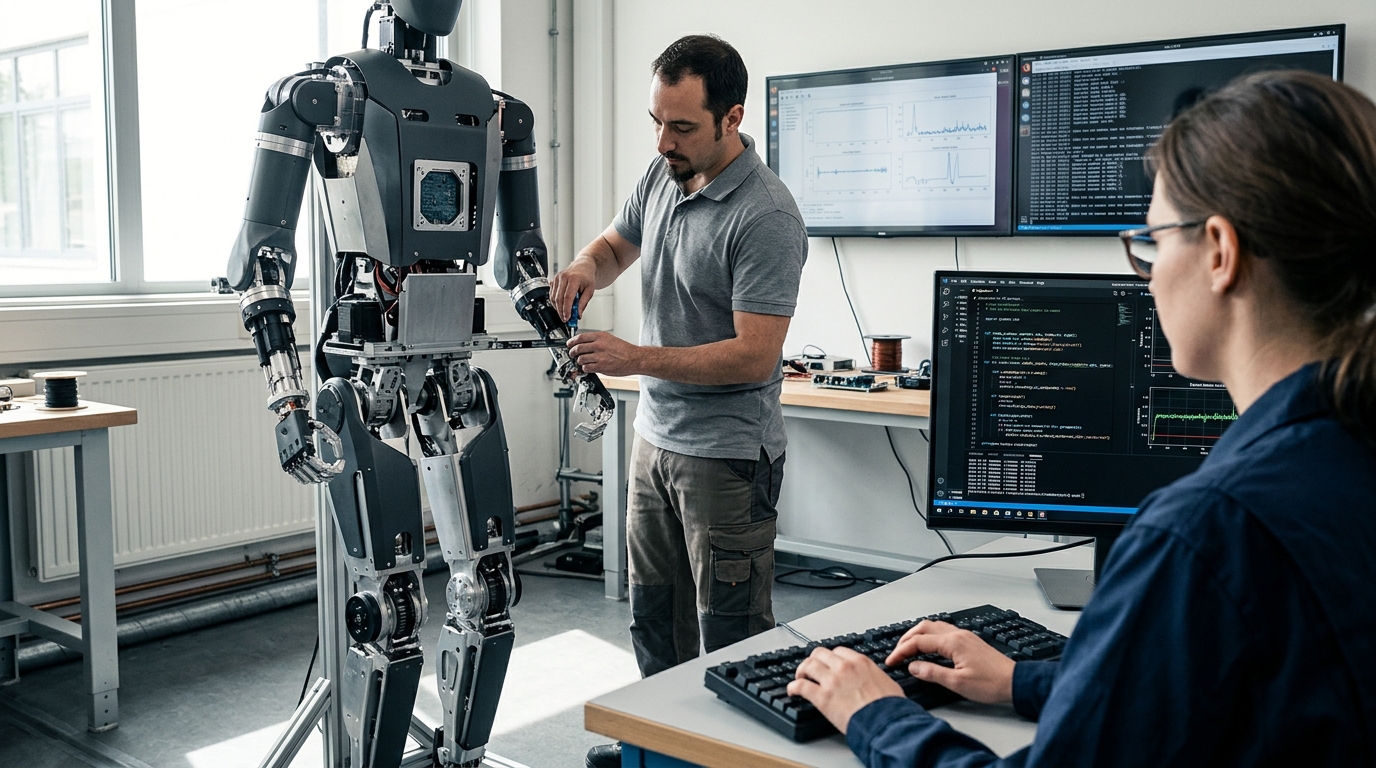

Почему теория стала инженерной задачей Технология гуманоидных роботов развивается стремительно.

Boston Dynamics, Tesla Optimus, Figure AI выпускают машины, которые подвижнее любых промышленных манипуляторов. Они перемещаются в человеческих пространствах — в офисах, на складах, в домах. И здесь возникает проблема, которую Азимов предвидел: Робот должен различать намерение человека и фактическую опасность Во время сбоя код не должен позволить машине атаковать Система безопасности должна работать без сетевого соединения Отказы в питании, сенсорах и памяти не должны запустить небезопасное поведение * Машина должна уметь сказать «я не знаю» вместо опасного предположения Кажется просто, но в реальной инженерии — адская сложность. Робот не видит сквозь стены. Система распознавания может ошибиться. Человек может дать противоречивую команду. И где-то среди этого шума должны работать три закона Азимова.

Как это реализуют сейчас Подход разработчиков pragmatic, а не Азимовский.

Boston Dynamics использует физические ограничители скорости и силы. Tesla добавляет в обучение резервные копии и мониторинг отказов. Figure AI работает над моделями поведения, которые компромиссны между производительностью и безопасностью. Никто не пишет простой код вроде IF robot_sees_human THEN stop(). Реальность — это миллионы условных операторов, обучение на данных и вероятностные модели, которые должны работать в разных окружениях.

Что это значит Азимов был прав и не прав одновременно.

Прав в том, что безопасность машин — центральная инженерная задача. Не прав в том, что её можно решить тремя простыми законами. Реальные законы для роботов — это тысячи страниц спецификаций, тесты на отказ оборудования, этические гайдлайны и судебные прецеденты, которые ещё будут созданы. Первый вопрос инженера к гуманоиду теперь звучит ровно как первый закон Азимова.