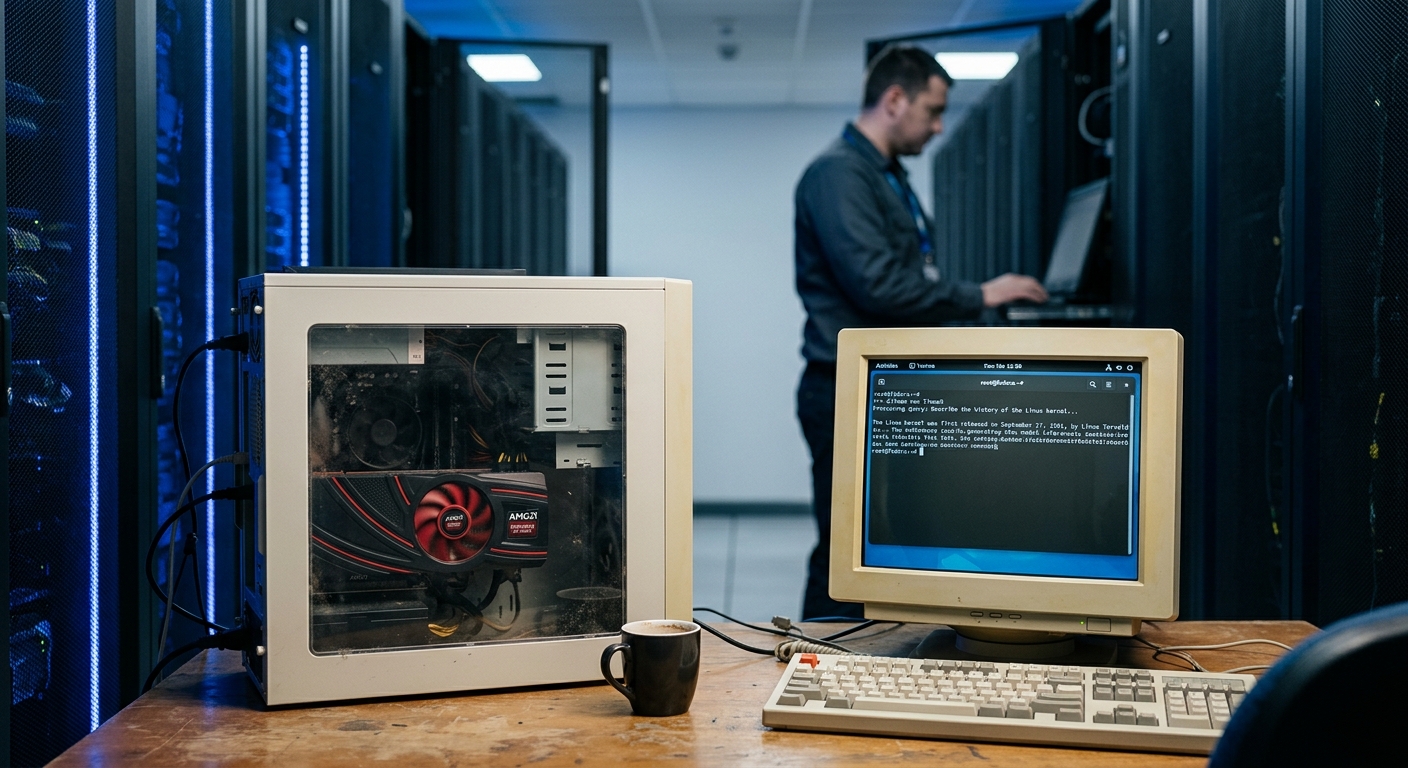

Локальный LLM на видеокарте 2017 года: AMD RX 580 + Vulkan + Ollama

Видеокарта AMD RX 580 2017 года способна запускать современные языковые модели благодаря Vulkan. Забудьте о сложностях ROCm — используйте простой Vulkan и получ

Локальный AI стал реальностью даже для старого железа. AMD RX 580, видеокарта 2017 года, способна запускать современные языковые модели на локальном компьютере со скоростью 15–35 токенов в секунду. Не облако, не API, не подписки — чистый локальный AI на машине, которая была забыта в столе.

Vulkan вместо ROCm ROCm — официальная поддержка AMD для GPU-ускорения — часто создаёт проблемы на

Fedora: сложная установка, несовместимости версий, пропуски в документации. Vulkan предлагает альтернативу: это стандартная графическая API, доступная везде, работающая без боли. Ollama поддерживает Vulkan, и это меняет игру — больше нет необходимости разбираться с ROCm. Скорость 15–35 токенов в секунду вполне реальна для видеокарты 2017 года. Это не конкурирует с современными GPU класса RTX 4090, но вполне достаточно для локального использования: запуск Llama 3.1, DeepSeek, Qwen 3.5, экспериментирование с моделями, интеграция в свои приложения без облачного API.

Как завести локальный AI-стек

Процесс удивительно простой: Установите Ollama — минималистичный запускатель моделей для любой ОС Запустите Open WebUI — веб-интерфейс для взаимодействия с моделями Подключите n8n — платформу для автоматизации и сложных workflow Загрузите любую открытую модель — Llama 3.1, DeepSeek V2, Qwen 3.5 Vulkan автоматически используется Ollama, если видеокарта совместима. В Fedora всё работает из коробки — никаких дополнительных конфигураций.

Реальная производительность

На AMD RX 580 вы получите: Llama 3.1 70B с квантизацией: ~20 токенов в секунду DeepSeek V2: ~18 токенов в секунду * Qwen 3.5 32B: ~32 токена в секунду Это достаточно для интерактивного использования — вы не получите мгновенный ответ, как в ChatGPT, но полностью готовый результат придёт за 5–15 секунд. Для batch-обработки сотен текстов скорость вообще не имеет значения. Плюс: полная приватность. Все данные остаются на вашей машине, никаких запросов к облакам OpenAI, Anthropic или других сервисов.

Что это значит Локальный AI больше не привилегия владельцев премиум-железа.

Старая видеокарта, которая лежит без дела, внезапно становится полезным инструментом для разработки и экспериментов. Это открывает дорогу к приватному AI, независимым от облачных сервисов экспериментам и интеграции моделей прямо в свои проекты.