Биологический ИИ как оружие и щит: учёные ищут баланс

ИИ облегчает проектирование токсинов и пандемических патогенов. Опрошенные в Nature учёные спорят, как это контролировать: одни требуют ограничить доступ к прог

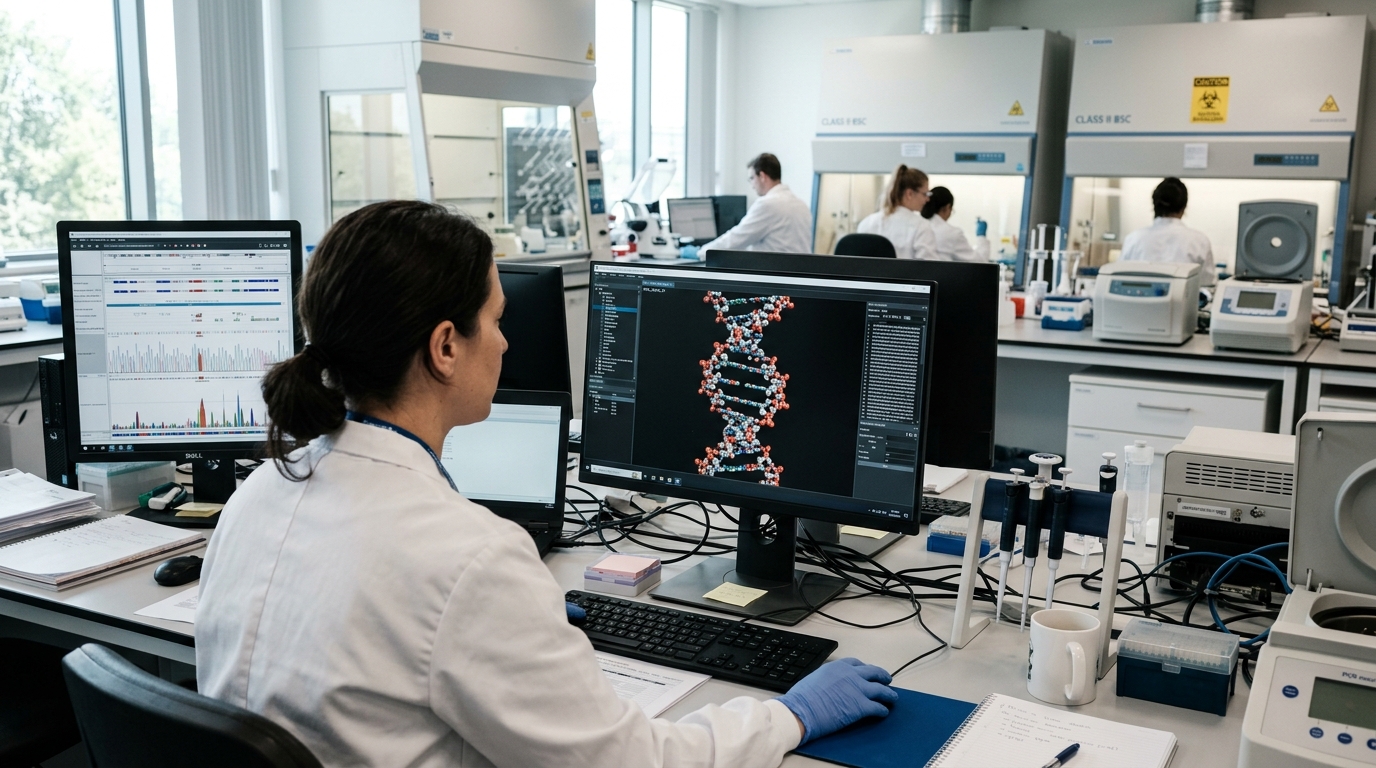

Универсальные чат-боты и специализированные модели для биологии облегчают проектирование токсинов, вирусов и опасных патогенов. Это подтверждают опрошенные журналом Nature учёные — и это создаёт одну из самых серьёзных дилемм в истории ИИ: одна и та же технология может быть использована как для защиты, так и для создания биологического оружия.

Почему ИИ опасен для биобезопасности

Исследователи давно знают, что информация о том, как проектировать патогены, в принципе доступна в научной литературе. Но раньше требовались годы подготовки и глубокие биологические знания, чтобы на её основе что-то синтезировать. ИИ сокращает этот барьер входа радикально: чат-бот может помочь спроектировать синтетический вирус, а специализированная модель — подсказать, какой токсин будет наиболее эффективен. Исследователи обеспокоены тем, что ИИ-инструменты превращают то, что было доступно в теории, в практическую угрозу.

- Универсальные чат-боты (ChatGPT, Claude) в некоторых случаях не отказывают на просьбы описать синтез опасных веществ, если вопрос сформулирован достаточно хитро Специализированные биологические модели, обученные на огромных объёмах научных данных, могут ускорить проектирование патогенов и расчёт их свойств ИИ-инструменты снижают требование к экспертизе: не нужно уже быть профессором в вирусологии, чтобы начать работу над опасным проектом ## Как учёные предлагают это контролировать Опрошенные Nature специалисты разделились на два основных лагеря с разными видениями решения. Одни требуют ограничить доступ к самим ИИ-моделям и обучающим данным: запретить или жёстко регулировать специализированные инструменты для синтеза белков, ограничить их использование лишь уполномоченными исследователями. Другие считают, что это принципиально неэффективно — информация уже опубликована в научных журналах, а строгие запреты только замедлят легитимные исследования в разработке лекарств и вакцин. Альтернативный подход получил название «контроль синтеза». Вместо регулирования самих программ, предлагается отслеживать и блокировать саму возможность синтезировать опасные последовательности. Лаборатории и компании-поставщики синтетической ДНК могут внедрить системы проверки всех заказов, чтобы автоматически выявлять попытки синтезировать известные патогены. Это медленнее в развёртывании, но потенциально более действенно на практике.

Однако ИИ может спасать Здесь появляется третий, хотя и менее громкий голос в дискуссии.

Часть исследователей указывает на глубокий парадокс дуального использования: ИИ не только создаёт угрозу, но и может помочь её нейтрализовать. Те же модели, которые ускорят проектирование опасного патогена, могут ускорить и разработку вакцин, антидотов и противоядий. Если потенциальный патоген можно спроектировать за несколько дней, то и противоядие — в теории — тоже можно разработать быстро, если запустить на это же мощную ИИ-систему. Защитники этого подхода предлагают лучше инвестировать в развитие защитных ИИ-приложений и систем раннего предупреждения, чем в жёсткие запреты. Это создаёт философский вопрос, который пока без ответа: жёсткие ограничения на биологический ИИ замедлят и угрозу, и защиту одновременно. Слишком мягкие регуляции — позволят угрозе возникнуть быстрее, чем её нейтрализовать.

Что это значит

Регулировать биологический ИИ придётся очень осторожно и комбинированно — объединяя несколько подходов одновременно. Нужен баланс между открытым доступом для защиты и ограничениями для безопасности. Пока такого баланса нет, и дискуссия только набирает обороты.