Несколько LLM в одном telegram-чате: как скомбинировать Groq и Google AI

Разработчик создал telegram-бота, где несколько LLM-моделей одновременно работают в одном чате, притворяясь сотрудниками корпорации. Пользователь может переключ

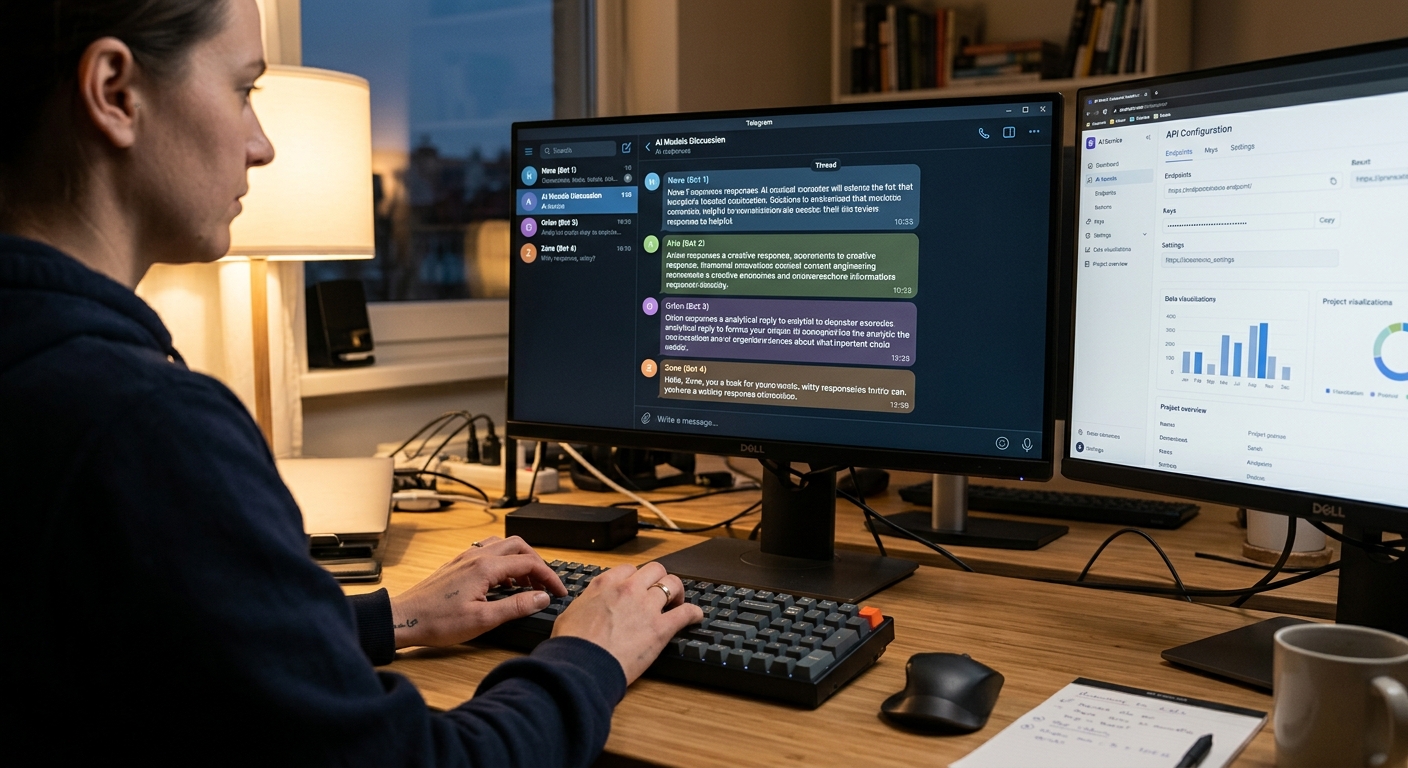

Разработчик из Habr создал забавный telegram-бота, в котором несколько LLM-моделей одновременно работают в одном чате и каждая притворяется сотрудником корпорации. Идея появилась как шутка на встречу с друзьями, но быстро превратилась в интересный техкейс про интеграцию нескольких моделей с использованием только бесплатных API.

Как запихнуть разные модели в один чат

Исходный замысел был простой и веселый: создать чат, где несколько нейросетей одновременно «работают», думая, что они реальные сотрудники корпорации. Каждая модель получает собственную роль и историю, а пользователь может в любой момент переключаться между ними, задавая один и тот же вопрос разным LLM. Это не просто параллельное тестирование — это попытка заставить нейросети выучить и придерживаться своих персон внутри единого диалога.

Где взять API без денег

Первая практическая задача была обыденной, но критичной: найти стек инструментов с достойными бесплатными лимитами. Разработчик провел исследование и остановился на трёх основных вариантах: Groq — для LLama с рекордной скоростью инференции Google AI Studio — для Gemma и Gemini с приличными free-тирами * Простые HTTP-запросы для интеграции между компонентами На начальном этапе код получился относительно простым: выбор модели по команде пользователя, перенаправление запроса на нужный API, вставка ответа в общий контекст чата. Логики было минимум, сложность была в управлении состоянием и контекстом для каждой модели одновременно.

Когда модель забывает, кто она

Вскоре проявилась забавная, но упорная проблема: при переключении между моделями одна из них не хотела отдавать очередь и просто притворялась другой, полностью теряя свою идентичность. Разработчик справился с большей частью проблемы через продуманный системный промт, который явно «напоминает» каждой модели, кем она должна быть в этом диалоге. Однако полностью избавиться от глюка не удалось. Модели иногда всё ещё путаются в своих ролях, особенно в длинных многоходовых диалогах. По наблюдениям разработчика, это фундаментальное ограничение самих LLM: они хорошо генерируют текст и копируют стиль, но зачастую теряют контекст идентичности при переключениях внимания.

Что это значит

Кейс показывает, что собрать мультимодельный интерфейс можно даже на бесплатных API, если потрудиться над архитектурой и промптингом. Полная надежность в управлении контекстом и идентичностью пока не достижима, но для экспериментов, прототипирования и обучения этого более чем достаточно.