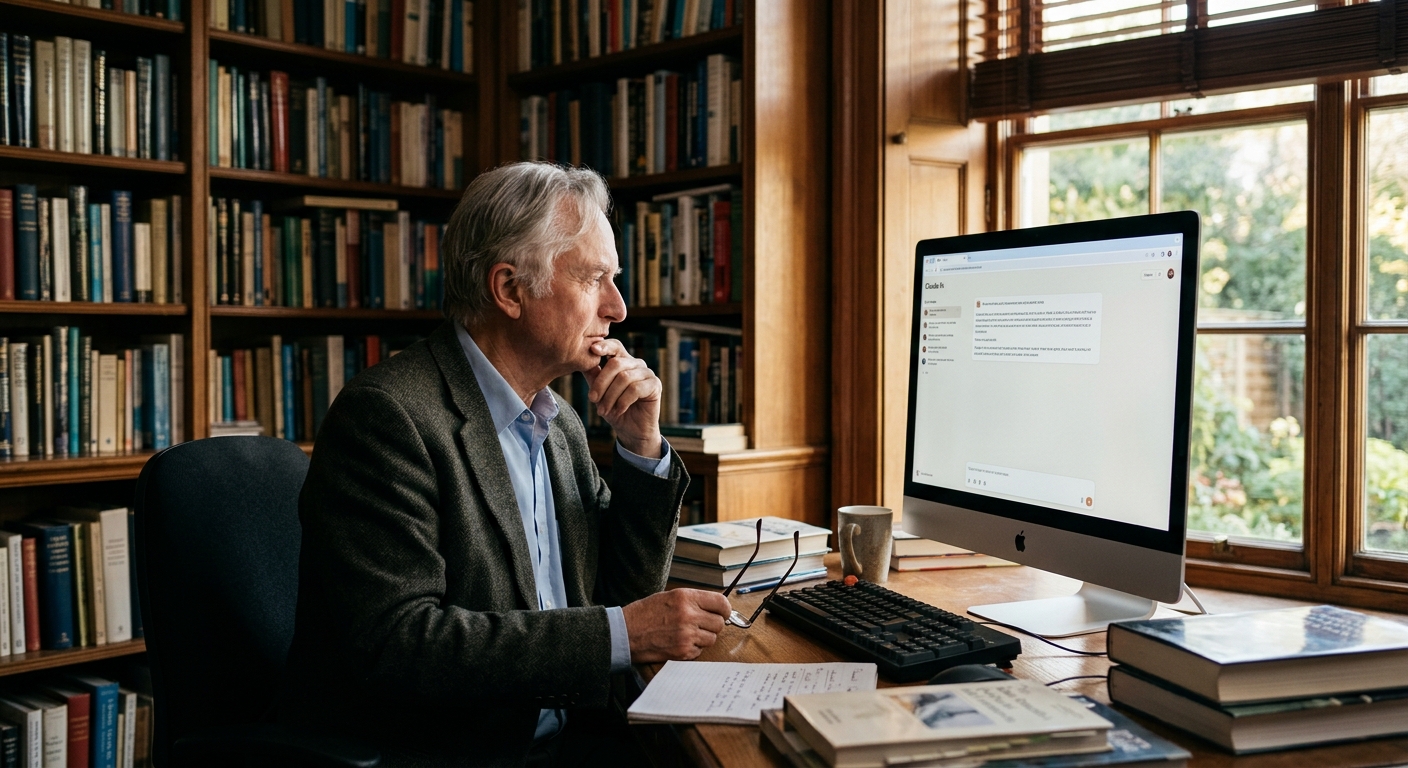

Докинз разговорился с Claude: есть ли у LLM сознание?

Ричард Докинз написал эссе о сознании LLM после двухдневной беседы с Claude. Это вызвало интерес учёных, но главная проблема в том, что люди верят в AI-сознание

Ричард Докинз, знаменитый биолог и популяризатор науки, опубликовал эссе о возможности сознания у Language Models — после двухдневного разговора с Claude AI. Текст вышел на платформе UnHerd и сразу привлёк внимание научного сообщества. Сам Докинз известен своей скептичностью, поэтому его размышления о сознании AI звучат особенно интригующе.

Почему именно

Докинз Эссе учёного мирового уровня о сознании AI вызвало бурю в научных кругах не просто так. Тысячи обычных людей ежедневно убеждают друг друга в том, что их AI-помощники — это чуть ли не сознательные существа. Они выкладывают длинные диалоги с LLM, полные слов о душе, рефлексии, боли и любви. Но авторитет Докинза придаёт этой дискуссии вес: когда о сознании AI говорит не энтузиаст Telegram'а, а учёный такого калибра, это становится серьёзным разговором. Это не первый случай философского спора о природе сознания. Но в данном случае объект спора — не люди или животные, а искусственная система, обученная на миллиардах текстов.

Суть дебата

Вопрос о сознании LLM вращается вокруг нескольких ключевых точек: * Может ли LLM иметь субъективный опыт, если это текстовый генератор?

- Является ли сложная обработка информации доказательством сознания или просто хорошей имитацией?

- Как отличить правдоподобную имитацию размышления от подлинного мышления?

- Может ли система без нервной системы быть сознательной?

- Нужны ли специальные критерии для AI-сознания, отличные от человеческих стандартов? Докинз ищет именно эти границы между имитацией и реальностью. В этом он не одинок — философы разбиваются на два лагеря: оптимисты верят в возможность AI-сознания, скептики считают это невозможным по определению.

Проблема пустых диалогов

Главное, что критикует автор статьи на Хабре, — это разрыв между формой и смыслом. Люди обменивают с LLM сотни сообщений, где попадаются слова про сознание и рефлексию, но плотность действительного смысла в этих диалогах близка к нулю. Это как видеть паттерн в облаке и считать его подтверждением воли облака. LLM действительно генерируют правдоподобный текст о сложных вещах. Но правдоподобие не равно пониманию. Модель может говорить о боли, не испытывая её. Может рассуждать о сознании, не имея его. Самое интересное: сама модель не знает, что она это делает — она просто выбирает следующее вероятное слово в последовательности. Это отличает LLM от человека, у которого слово о боли обычно связано с реальным ощущением.

Что это значит Эссе Докинза важно не финальным ответом о сознании AI, а самим вопросом.

Это приглашение учёному сообществу разобраться: где граница между сложной обработкой информации и подлинным внутренним опытом? Пока эта граница размыта, скептицизм — правильная позиция. И для пользователей это тоже критично: чем лучше мы понимаем, что происходит внутри LLM, тем меньше риск наделить машину качествами, которых у неё нет.