Thinking Machines создаёт AI, который говорит и слушает одновременно

Thinking Machines работают над AI, который слушает и отвечает одновременно, как в телефонном разговоре. Обычные модели работают последовательно: сначала обрабат

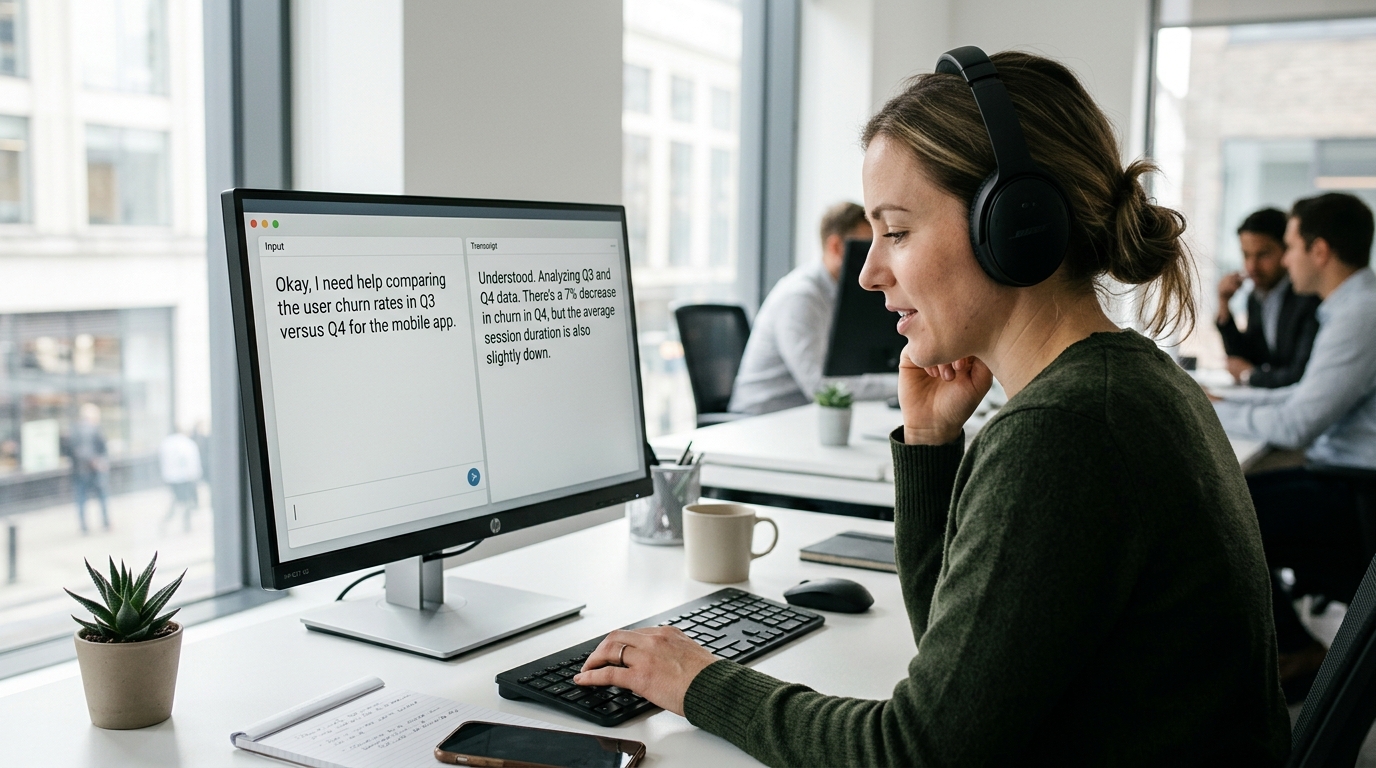

Сейчас каждая AI-модель работает по одному принципу: вы пишете, модель слушает. Вы ждёте, модель отвечает. Thinking Machines пытается это изменить, создав архитектуру, которая обрабатывает ваше сообщение и генерирует ответ одновременно — как обычный телефонный разговор.

Проблема текущего подхода

Все современные языковые модели — от ChatGPT до Claude — работают по принципу запрос-ответ. Вы отправляете полное сообщение, модель полностью обрабатывает его, затем выдаёт полный ответ. Это создаёт ощущение, что вы разговариваете с роботом, а не с человеком. В реальном разговоре всё иначе. Люди слушают во время генерации ответа. Вы можете прервать собеседника, уточнить деталь, добавить контекст — и он будет реагировать на лету, не начиная всё заново. Никто не ждёт, пока собеседник закончит полную речь, чтобы потом полностью переосмыслить ответ. Это создаёт естественный, органичный поток диалога. Текущий подход AI задаёт жёсткую границу: вход завершён → обработка → выход завершён. Нет гибкости, нет адаптации в процессе, нет ощущения двусторонней коммуникации.

Что делает

Thinking Machines Стартап разрабатывает модель, которая обрабатывает входной поток в реальном времени и одновременно генерирует выходной поток. Вместо ожидания полного входа система начинает отвечать уже во время получения информации от пользователя. Это открывает несколько принципиально новых возможностей: Слушание во время ответа — реагирование на новые данные без перезагрузки контекста Естественные прерывания — перебивание, как в живом диалоге между людьми Интонационная адаптация — изменение интонации по голосовым сигналам в реальном времени Невербальные сигналы — учёт жестов и выражения лица в видео-разговорах * Минимальная задержка — отсутствие мёртвых пауз между репликами Для голосовых ассистентов это критически важно.

Когда вы звоните в колл-центр или заказываете такси через голос, вы не хотите ждать 3–5 секунд обработки. Говорите — ассистент слышит и сразу отвечает, как человек.

Архитектурная сложность проблемы

Одновременная обработка входа и генерация выхода — это глубокая архитектурная переделка. Трансформеры, на которых построены почти все современные LLM, спроектированы для последовательной работы: прочитай весь контекст, порождай токены один за другим. Менять этот основной принцип — значит переписывать механику внимания, кеширования, предсказания. Нужно сохранять растущий контекст из входного потока, одновременно порождая выход, не теряя когерентность и логики ответа. Практические вызовы не менее серьёзны: качество ответов (не становятся ли они поспешными и неполными?), задержки (нужна минимальная латенсия для естественности), управление памятью под растущие потоки. Как удерживать нить разговора, если ответ идёт параллельно входу? Как не потерять деталь из конца сообщения, если уже начал отвечать на начало?

Что это значит

Если этот подход удастся реализовать, диалог с AI перестанет ощущаться как взаимодействие с системой. Это будет диалог — настоящий разговор, без ощущения жёсткости и задержки, приближенный к человеческому общению. Для голосовых ассистентов, чат-ботов и особенно call-центров это критическое улучшение. Клиент позвонил — ассистент сразу слышит и реагирует, может перебить для уточнения, адаптировать ответ на основе новой информации. Это повысит удовлетворённость и скорость решения проблем в разы.