Centaur знал ответы, но не понимал вопросов: исследование опровергает AI-«мышление»

Модель Centaur произвела фурор: она претендовала на имитацию человеческого мышления сразу в 160 когнитивных задачах — от памяти до принятия решений. Новое иссле

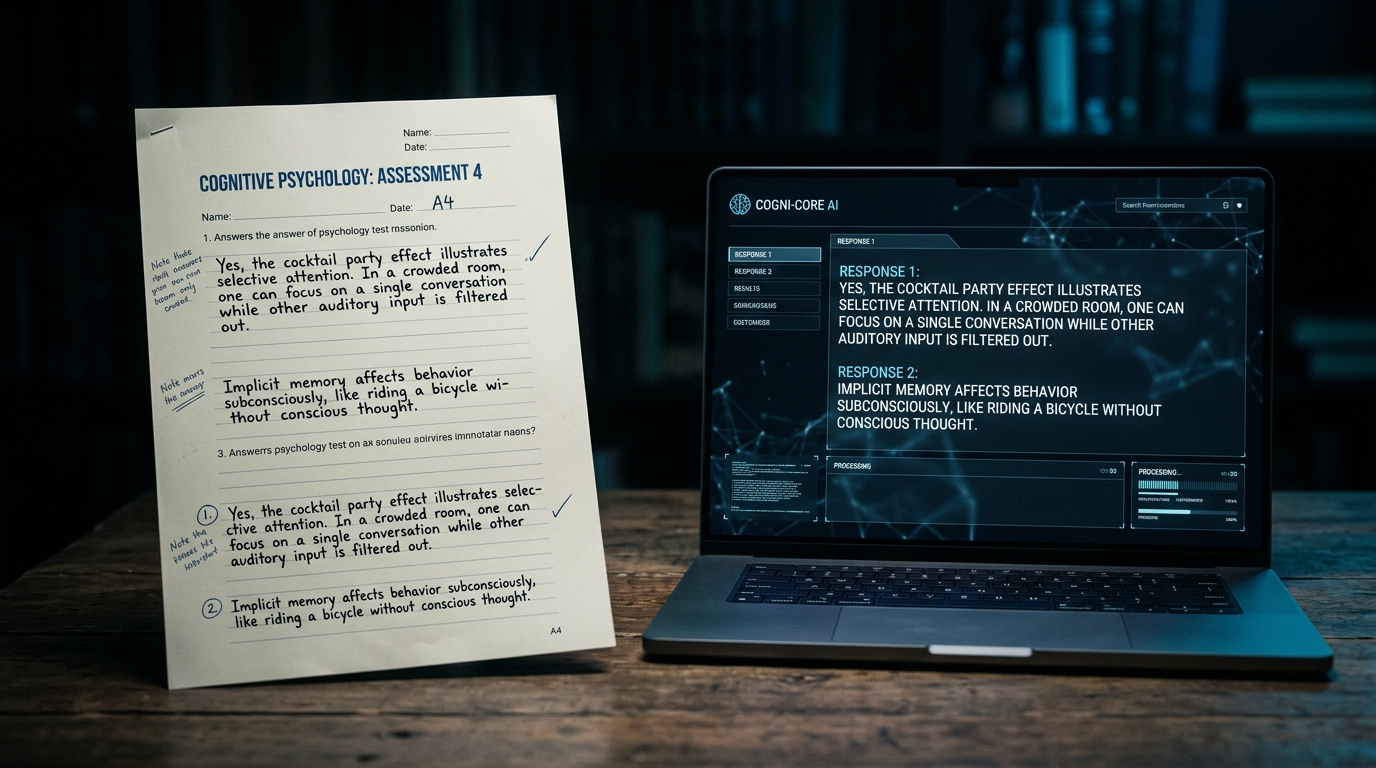

Модель Centaur заявила о прорыве: ИИ якобы научился имитировать человеческое мышление сразу в 160 когнитивных задачах — от памяти до принятия решений. Новое исследование опровергает эту претензию: модель не думала, а запоминала паттерны.

Старый спор, новый игрок Вопрос о природе человеческого разума — один из самых долгих в психологии.

Является ли мышление единой системой с общим «двигателем» или набором специализированных модулей, каждый из которых отвечает за своё: память, внимание, язык, пространственную навигацию, принятие решений? Это не академическая игра слов. От ответа зависит, как строить тесты на когнитивные способности, как лечить расстройства вроде деменции или дислексии, и как проектировать ИИ-системы, претендующие на «понимание».

За десятилетия споров единого консенсуса так и не возникло. Centaur появился как возможный ответ с неожиданной стороны. Идея: обучить ИИ на данных о поведении человека в когнитивных тестах, а затем посмотреть — если модель воспроизводит то же поведение, значит она «уловила» структуру мышления.

Авторы заявляли, что Centaur справляется с 160 различными когнитивными задачами с точностью, сопоставимой с человеческой. Масштаб претензии был редким: ни одна модель до этого не претендовала на такое когнитивное покрытие.

Где ломается аргумент

Исследователи, независимо проверившие работу Centaur, обнаружили принципиальную проблему: высокие результаты объясняются не «пониманием», а запоминанием. Конкретные уязвимости методологии: Пересечение данных: обучающая выборка пересекается с тестовой — модель фактически «видела» правильные ответы до проверки Нет переноса: на незнакомых задачах с той же структурой модель не показывала стабильных результатов Паттерн без механизма: высокое соответствие человеческим ответам не означает воспроизведение когнитивных процессов — только их внешней формы Слабая верификация: авторы не проводили тесты на специально изменённых задачах, где запомненные ответы бы не работали По словам критиков, это классический случай: модель знала, что ответить, не понимая вопроса.

Почему это имеет значение Претензия Centaur была не просто научной — она была инструментальной.

Если ИИ действительно моделирует когнитивные процессы, это открывает новый метод исследования разума: вместо дорогих нейропсихологических экспериментов теории можно проверять прямо на ИИ-модели. Это радикально ускорило бы когнитивную науку. Но граница между «запоминанием» и «мышлением» при оценке ИИ остаётся не проведённой. Языковые модели регулярно показывают высокие результаты на бенчмарках — и при детальном разборе оказывается, что за этим стоит воспроизведение паттернов из обучающих данных, а не обобщение.

«Модель знала, что ответить — но не знала, почему именно так», — примерно так критики формулируют суть претензии к Centaur.

История здесь не новая. Каждый раз, когда ИИ получает высокий балл за «понимание», следует детальная проверка — и выясняется, что тест измерял не то. Centaur вписывается в эту закономерность.

Что это значит Убедительный бенчмарк и реальное понимание — разные вещи.

Пока не появятся стандарты, принципиально разделяющие запоминание паттернов и когнитивное обобщение, заявления об «ИИ, который мыслит как человек» будут оставаться под вопросом. Для когнитивной науки следующий шаг очевиден: разрабатывать тесты, которые по определению нельзя пройти за счёт зазубривания.