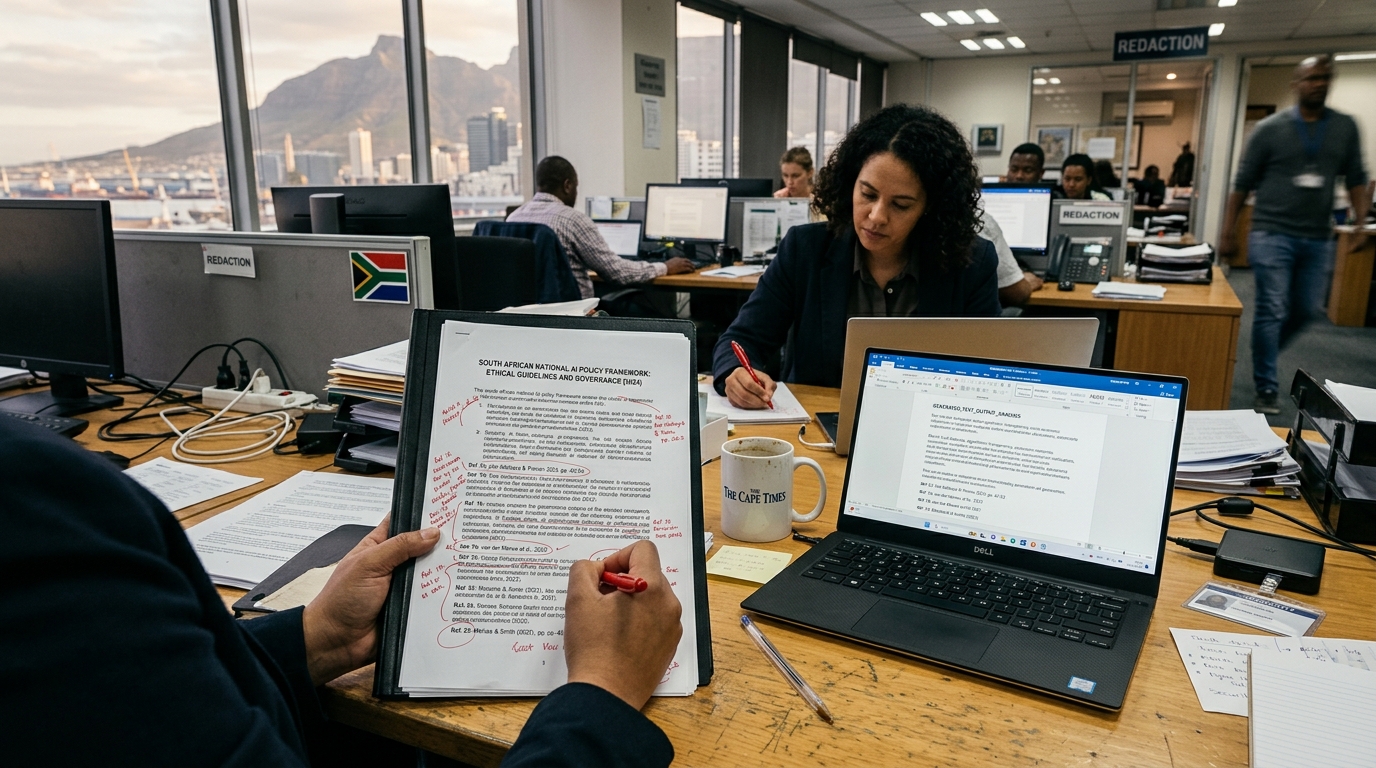

ЮАР отозвала проект политики по ИИ: в документе нашли вымышленные научные ссылки

ЮАР отозвала проект национальной политики по ИИ после того, как в 86-страничном документе нашли как минимум шесть вымышленных научных ссылок из 67. Проект уже о

Южная Африка отозвала проект национальной политики по ИИ после того, как в документе нашли вымышленные научные ссылки. Ирония в том, что документ о регулировании ИИ, вероятно, сам частично готовили с помощью генеративного ИИ — и не проверили результат перед публикацией.

Что произошло

Министр коммуникаций и цифровых технологий ЮАР Солли Малатси 27 апреля отозвал проект политики после внутренней проверки. Поводом стало расследование News24: журналисты заметили, что как минимум шесть из 67 академических ссылок в 86-страничном документе ведут на работы, которых не существует. При этом названия журналов были реальными, а вот сами статьи — нет. Проект до этого уже прошёл кабинет министров 25 марта и 10 апреля был опубликован в правительственном вестнике для общественного обсуждения. Комментарии к нему принимались до 10 июня. По словам Малатси, наиболее вероятное объяснение — в текст попали сгенерированные ИИ ссылки без должной проверки. Министр пообещал меры в отношении тех, кто отвечал за подготовку и контроль качества, потому что ошибка затронула уже не черновик, а официальный государственный документ.

Что было в проекте Сам документ задумывался как рамка для государственной стратегии по ИИ.

Он опирался на риск-ориентированный подход, частично вдохновлённый европейским AI Act, и предлагал разворачивать регулирование по этапам: от базовых правил и рекомендаций до отраслевых стратегий и отдельных институтов. В тексте также говорилось о грантах, субсидиях и налоговых стимулах для частного сектора. В проекте фигурировали сразу несколько новых структур и механизмов: Национальная комиссия по ИИ совет по этике ИИ и отдельный регулятор омбудсмен по ИИ национальный институт безопасности ИИ * страховой суперфонд для спорных случаев ответственности Кроме этого, в официальном проекте были прописаны шесть стратегических направлений: развитие кадров, ИИ для инклюзивного роста и занятости, ответственное управление, этичный и инклюзивный ИИ, культурное сохранение и международная интеграция, а также внедрение ИИ с приоритетом интересов человека.

Для африканского контекста это была амбициозная рамка: государство явно хотело одновременно стимулировать рынок и создать собственную модель надзора, а не просто скопировать европейские правила.

Где сломался процесс

Проблема оказалась не только в самих фейковых ссылках, но и в том, что документ прошёл через несколько уровней согласования. Редакторы South African Journal of Philosophy, AI & Society и Journal of Ethics and Social Philosophy подтвердили, что указанные статьи у них никогда не публиковались. То есть речь шла не об одной небрежной ошибке, а о правдоподобных, но вымышленных источниках, которые выглядели достаточно убедительно, чтобы пройти кабинетную проверку.

«Это неприемлемый сбой, который показывает, почему при использовании ИИ нужен строгий человеческий контроль».

Эта история хорошо показывает типичную слабость генеративных моделей. Они умеют собирать связный, уверенный текст и оформлять ссылки так, будто перед тобой нормальная академическая библиография. Но модель не обязана проверять, существует ли статья на самом деле. Если команда использует ИИ как черновик, а затем не валидирует каждую ссылку вручную, ошибка легко доходит до финального документа. В случае с государственным документом цена такого пропуска выше обычного: под удар попадает не только текст, но и доверие к институту, который собирается регулировать саму технологию.

Что это значит

Скандал отбросил повестку ЮАР по ИИ назад: проект придётся переписывать, заново выносить на консультации и заново доказывать его легитимность. Для остальных государств и компаний вывод простой: использовать ИИ при подготовке документов можно, но ссылки, цитаты и фактуру нужно проверять вручную до публикации, а не после скандала. История ЮАР показывает, что самый болезненный риск генеративного ИИ — не громкий сбой, а уверенно оформленная ошибка, замеченная слишком поздно.