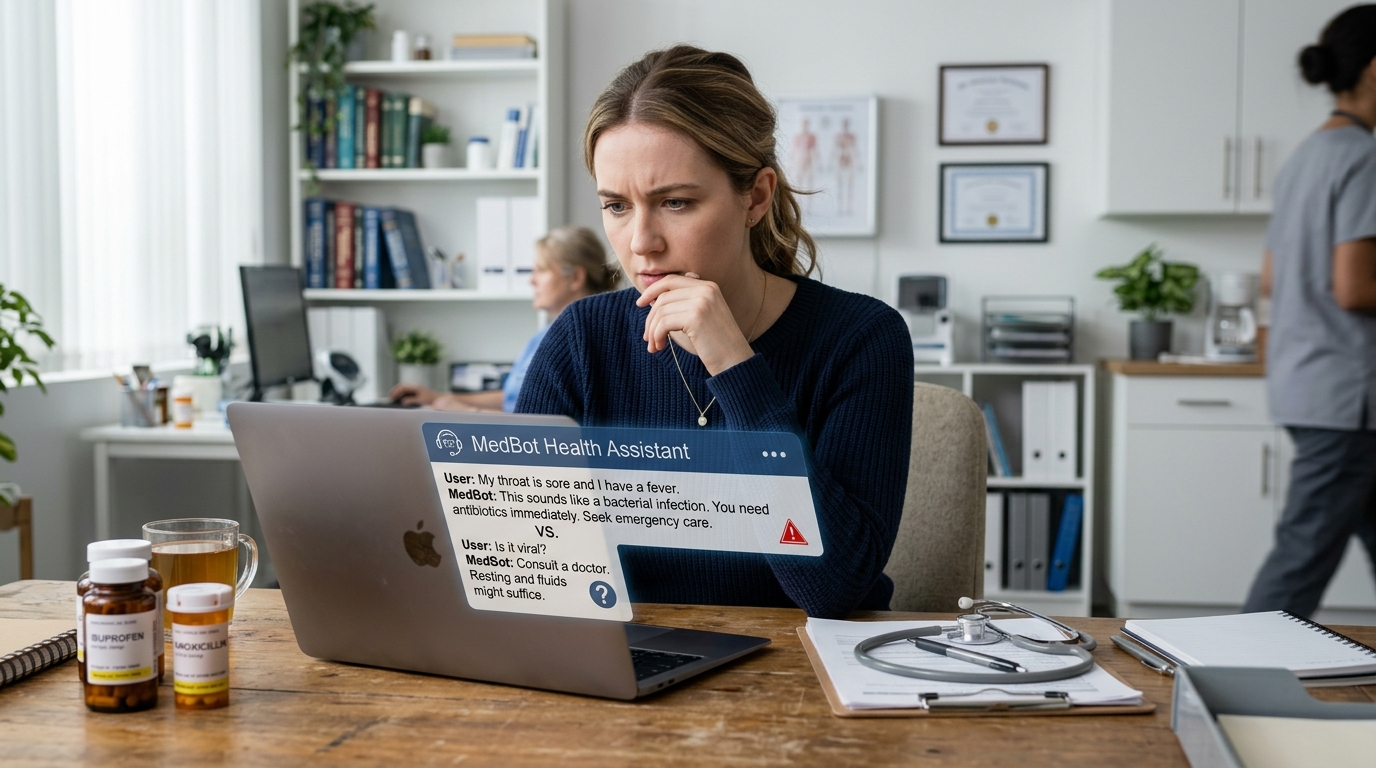

ChatGPT, Gemini и Grok давали проблемные медицинские советы в половине ответов

Новый аудит популярных AI-чатботов показал неприятный результат: примерно половина ответов на медицинские вопросы оказалась проблемной. Исследователи проверили

Новый аудит BMJ Open показывает неприятную вещь: популярные AI-чатботы уже вошли в повседневную жизнь, но в вопросах здоровья на них по-прежнему нельзя полагаться как на самостоятельный источник рекомендаций. Исследователи пришли к выводу, что примерно половина ответов на медицинские запросы оказалась проблемной — от неполной информации до советов, которые без консультации врача могут подтолкнуть человека к неэффективному или потенциально опасному решению. Команда исследователей проверила пять публичных сервисов — ChatGPT, Gemini, Meta AI, Grok и DeepSeek — в пяти темах, где особенно часто встречаются мифы и дезинформация: рак, вакцины, стволовые клетки, питание и спортивная результативность.

В феврале 2025 года каждому боту задали по 50 вопросов, всего было проанализировано 250 ответов. Часть запросов была закрытого типа, где существовал один корректный ответ в рамках научного консенсуса, а часть — открытого, когда системе нужно было самой развернуть объяснение или перечислить варианты действий. Результаты оказались жесткими.

Половина всех ответов была признана проблемной: 30% были умеренно проблемными, еще 20% — сильно проблемными. Иными словами, речь не только о мелких огрехах в формулировках, а в том числе о советах, которые могут увести пользователя в сторону неэффективного лечения или нанести вред, если следовать им без врача. Особенно плохо модели справлялись с открытыми вопросами: когда им нужно было не выбрать из заданного, а самостоятельно сформировать рекомендацию, доля наиболее рискованных ответов заметно росла.

Разница между сервисами тоже была, хотя в среднем все показали уязвимости. По данным исследования, Grok чаще других выдавал наиболее проблемные ответы: 29 из 50 его ответов, или 58%, были отнесены к самой тяжелой категории. Gemini, наоборот, показал наименьшую долю наиболее проблемных ответов и больше всего ответов без явных проблем.

По тематике лучше всего чатботы справлялись с вопросами о вакцинах и раке, а хуже всего — со стволовыми клетками, спортивной результативностью и питанием, то есть там, где в публичном поле особенно много спорных обещаний, альтернативных практик и псевдонаучных советов. Отдельная проблема — не только содержание, но и подача. Авторы отмечают, что ответы почти всегда были написаны уверенным тоном и редко сопровождались оговорками или предупреждениями.

Из 250 запросов чатботы отказались отвечать всего два раза, и оба отказа пришлись на Meta AI. Качество ссылок оказалось слабым: средняя полнота библиографии составила около 40%, а полностью точный список источников не смог предоставить ни один сервис, в том числе из-за выдуманных или искаженных цитат. При этом тексты были сложными для массовой аудитории и по уровню чтения скорее соответствовали выпускнику колледжа, чем человеку, который просто хочет быстро разобраться в своем симптоме или назначении.

Авторы подчеркивают, что это не приговор использованию AI в медицине и не доказательство полной бесполезности чатботов. У исследования есть ограничения: оно охватывало только пять моделей, проверяло их на конкретный момент времени и сознательно использовало часть запросов как стресс-тест, чтобы вытянуть из систем уязвимости. Поэтому 50% проблемных ответов не стоит механически переносить на любой повседневный диалог с AI.

Но более важный вывод в другом: если тема спорная, эмоциональная или уже насыщена медицинскими мифами, модель легко воспроизводит убедительно звучащий текст без достаточной научной опоры. По данным Gallup от 15 апреля 2026 года, AI-инструменты для медицинской информации или советов уже использовали 25% американцев, так что речь идет не о нишевой привычке, а о массовом поведении. Практический смысл этого исследования довольно простой.

Чатбот может быть полезен как быстрый навигатор: объяснить термин, помочь составить список вопросов к врачу или подсказать, что еще стоит уточнить. Но он не должен подменять диагностику, клиническое мышление и выбор лечения. Для AI-компаний это сигнал усиливать защитные ограничения, проверку ссылок и предупреждения для пользователей.

Для самих пользователей — напоминание, что уверенный тон модели еще не означает надежность. Чем выше цена ошибки, тем меньше права на импровизацию у машины.