Google и OpenAI упираются в предел: что будет, если в сети закончится человеческий текст

Генеративный ИИ попал в странную зависимость: модели нуждаются в человеческих текстах, но сами же уменьшают стимул их создавать. AI-сводки в поиске режут перехо

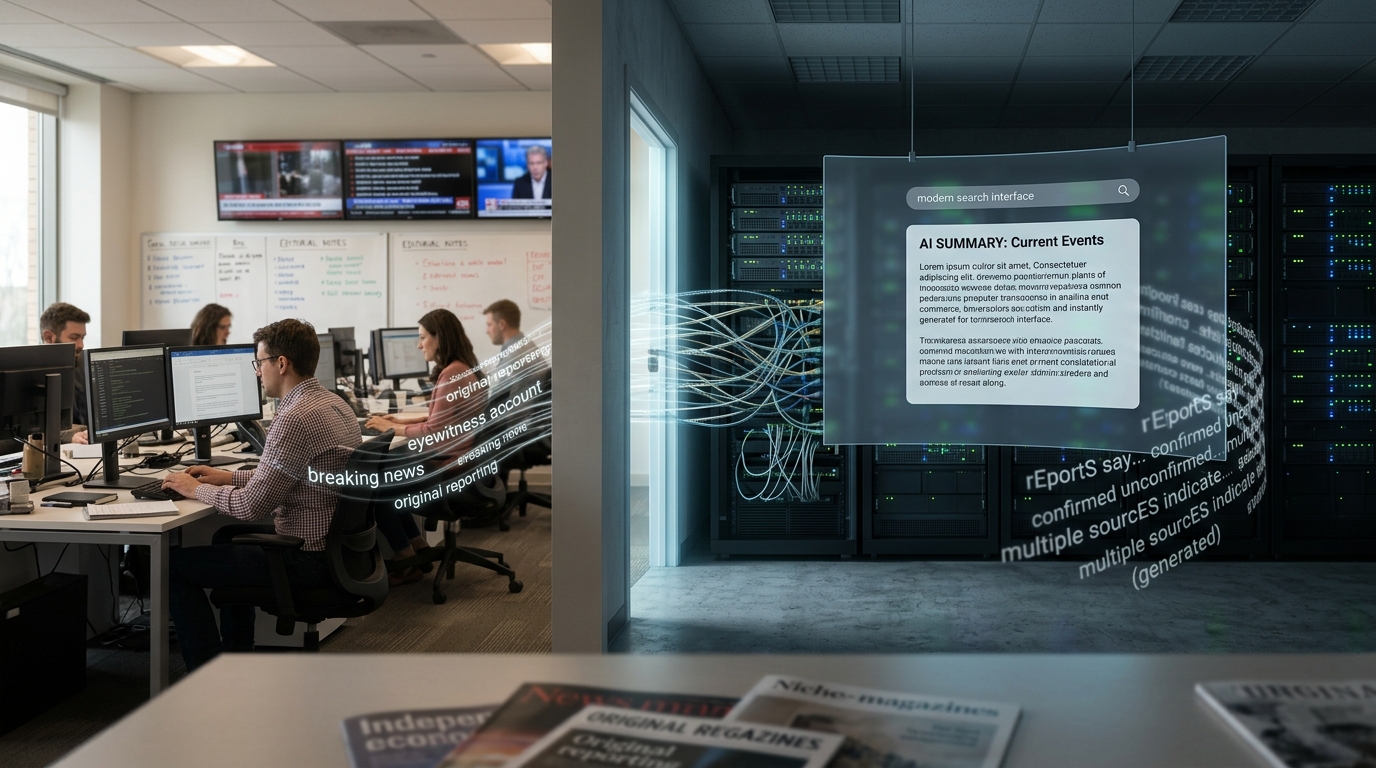

Главная уязвимость генеративного ИИ в том, что он живёт за счёт человеческого текста и одновременно разрушает условия, в которых этот текст появляется. Пока поисковики, чат-боты и AI-сводки обещают пользователю быстрый ответ без перехода на сайт, они снижают доходы тех, кто производит исходный материал. В краткосрочной перспективе модели выигрывают за счёт удобства, но в долгосрочной рискуют остаться без качественной базы для обучения и начать учиться на собственных отражениях.

Первая проблема — экономика публикаций. После запуска Google AI Overviews в мае 2024 года поиск стал всё чаще отвечать прямо в выдаче, не отправляя читателя к первоисточнику. По данным Chartbeat, которые 17 марта 2026 года опубликовал Axios, небольшие сайты с трафиком от 1 до 10 тысяч просмотров в день потеряли около 60% поисковых переходов за два года.

Средние площадки просели на 47%, крупные — на 22%. Исследование Pew Research Center от 22 июля 2025 года показало похожий эффект на уровне поведения пользователей: когда в результатах есть AI-сводка, люди переходят по обычным ссылкам заметно реже. Для медиа, форумов, нишевых блогов и независимых авторов это не абстрактная метрика, а прямой удар по рекламе, подпискам и мотивации продолжать писать.

Вторая проблема — сами данные. Большие языковые модели изначально росли на гигантских массивах интернет-текста. У ранних систем вроде GPT-3 основная часть обучающего корпуса была собрана из веба и связанных с ним источников.

Но объём качественного человеческого контента не бесконечен. В июне 2024 года исследователи Epoch AI оценили, что при прежних темпах масштабирования индустрия может упереться в предел публично доступного текста, пригодного для обучения, в окне между 2026 и 2032 годами. Именно поэтому крупнейшие игроки начали подписывать сделки с Reddit, издателями и другими владельцами больших архивов: вопрос доступа к данным превратился из технической детали в стратегический актив.

На этом фоне соблазн перейти на синтетические данные выглядит почти неизбежным. Если живого текста не хватает, логично попросить одну модель сгенерировать материал для следующей. Проблема в том, что такая схема постепенно ухудшает качество.

Работа, опубликованная в Nature 25 июля 2024 года, описывает эффект model collapse: при рекурсивном обучении на машинно сгенерированных данных модели начинают терять редкие факты, сглаживать сложные паттерны и усиливать уже имеющиеся ошибки и смещения. Это похоже на многократное копирование одной и той же страницы: общий смысл ещё виден, но детали выцветают с каждой итерацией. Даже OpenAI публично признавал, что синтетические данные могут помогать точечно, но не выглядят полноценной заменой разнообразному человеческому корпусу.

Есть и ещё одна ловушка: отделить человеческий текст от машинного на практике намного сложнее, чем кажется. Детекторы AI-контента до сих пор ошибаются, особенно на коротких, отредактированных или стилистически нейтральных текстах. Отдельные исследования показывали высокий процент ложных срабатываний на текстах людей, для которых английский не родной язык.

Это значит, что индустрии будет трудно просто «почистить интернет» и отобрать только надёжные человеческие данные. Более того, свежие академические оценки уже фиксируют, что доля AI-помощи в новых публикациях быстро растёт, а сам онлайн-контент становится более однообразным по смыслу и более стерильным по тону. Иными словами, проблема не только в количестве текста, но и в его разнообразии.

Если этот цикл не разорвать, интернет начнёт хуже работать сразу для всех участников. Авторы будут реже публиковать глубокие материалы, потому что их всё труднее монетизировать. Платформы продолжат заполнять выдачу краткими AI-сводками, экономя клик пользователя, но обедняя экосистему источников.

А разработчики моделей получат всё больше вторичного контента, который звучит уверенно, но несёт меньше нового знания. Выход, похоже, лежит не в ещё большем объёме генерации, а в сохранении стимулов для человеческого письма: оплате лицензий, прозрачной атрибуции, более аккуратном использовании AI-сводок и приоритете качества данных над голым масштабом. Иначе ИИ действительно окажется в ловушке, которую построил себе сам.