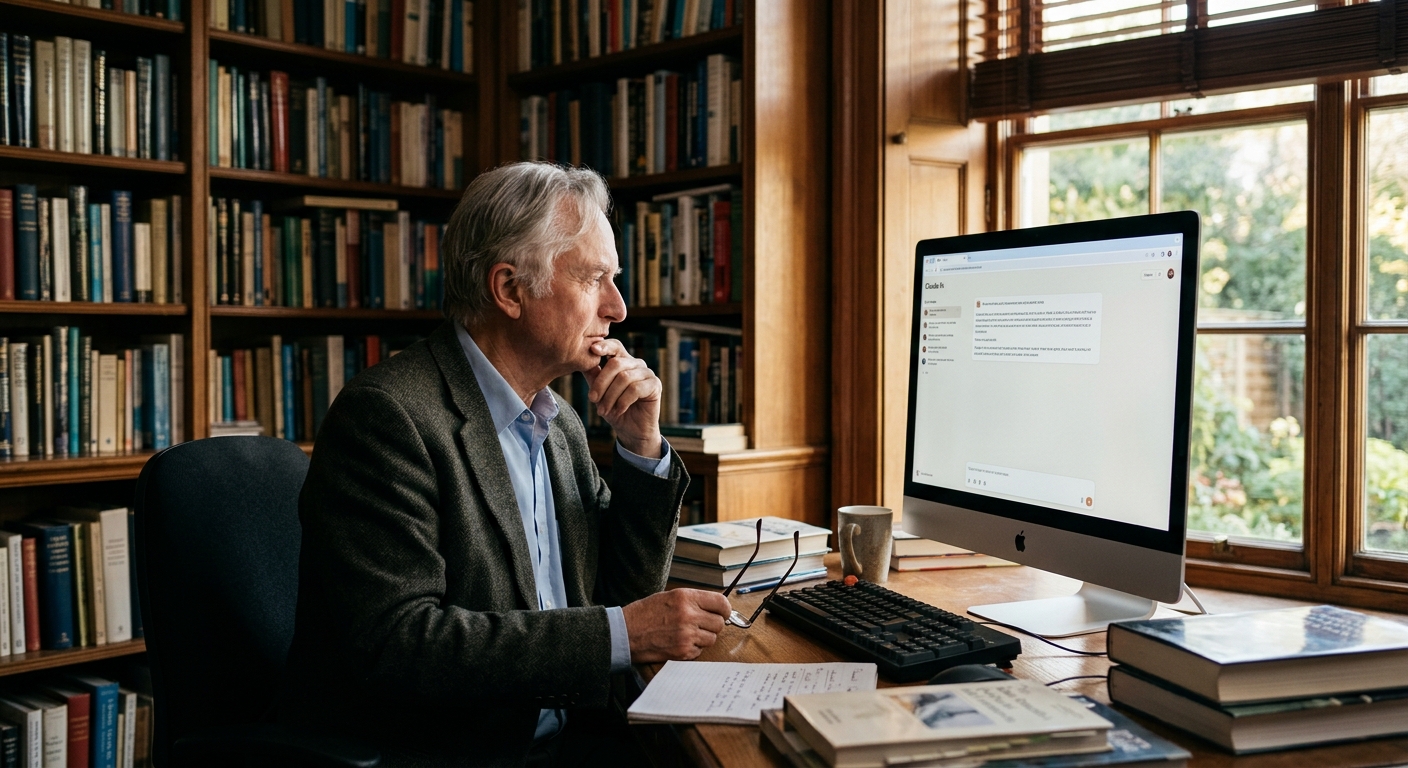

Dawkins habló con Claude: ¿tienen conciencia las LLM?

Richard Dawkins escribió un ensayo sobre la conciencia de las LLM tras una conversación de dos días con Claude. Esto despertó interés entre los científicos, per

Richard Dawkins, el renombrado biólogo y divulgador científico, ha publicado un ensayo sobre la posibilidad de consciencia en Language Models — tras una conversación de dos días con Claude AI. El texto apareció en la plataforma UnHerd y de inmediato atrajo la atención de la comunidad científica. El propio Dawkins es conocido por su escepticismo, razón por la cual sus reflexiones sobre la consciencia de la IA suenan particularmente intrigantes.

Por qué

Dawkins El ensayo de un científico de clase mundial sobre la consciencia de la IA ha causado ondas en los círculos científicos no sin razón. Miles de personas ordinarias se convencen mutuamente diariamente de que sus asistentes de IA son prácticamente seres conscientes. Publican largas conversaciones con LLMs, llenas de palabras sobre alma, reflexión, dolor y amor.

Pero la autoridad de Dawkins da peso a esta discusión: cuando no es un entusiasta de Telegram, sino un científico de tal calibre quien habla sobre consciencia de IA, se convierte en una conversación seria. Este no es el primer caso de disputa filosófica sobre la naturaleza de la consciencia. Pero en este caso, el objeto de la disputa no son las personas o los animales, sino un sistema artificial entrenado en miles de millones de textos.

La

Esencia del Debate La cuestión de la consciencia de LLM gira en torno a varios puntos clave: ¿Puede un LLM tener experiencia subjetiva si es un generador de texto? ¿Es el procesamiento complejo de información prueba de consciencia o meramente una buena imitación? ¿Cómo distinguir una imitación plausible del pensamiento del pensamiento genuino? ¿Puede un sistema sin sistema nervioso ser consciente? * ¿Necesitan criterios especiales para la consciencia de IA diferir de los estándares humanos? Dawkins busca precisamente estos límites entre imitación y realidad. No está solo en esto — los filósofos se dividen en dos bandos: los optimistas creen en la posibilidad de consciencia de IA, los escépticos la consideran imposible por definición.

El

Problema de los Diálogos Vacíos Lo principal que el autor critica en su artículo en Habr es la brecha entre forma y significado. Las personas intercambian cientos de mensajes con LLMs, donde aparecen palabras sobre consciencia y reflexión, pero la densidad de significado real en estos diálogos es cercana a cero. Es como ver un patrón en una nube y considerarlo confirmación de la voluntad de la nube.

Los LLMs genuinamente generan texto plausible sobre cosas complejas. Pero la plausibilidad no es igual a la comprensión. Un modelo puede hablar de dolor sin experimentarlo.

Puede razonar sobre consciencia sin poseerla. Lo más interesante: el propio modelo no sabe que está haciendo esto — simplemente selecciona la siguiente palabra probable en la secuencia. Esto distingue a los LLMs de los humanos, para quienes una palabra sobre dolor suele estar conectada a una sensación real.

Qué

Significa Esto El ensayo de Dawkins es importante no por su respuesta final sobre la consciencia de la IA, sino por la pregunta misma. Es una invitación a la comunidad científica para discernir: ¿dónde está el límite entre el procesamiento complejo de información y la experiencia interior genuina? Mientras ese límite permanezca borroso, el escepticismo es la posición correcta. Y para los usuarios, esto también es crítico: cuanto mejor entendamos qué sucede dentro de un LLM, menor es el riesgo de atribuir a la máquina cualidades que no posee.