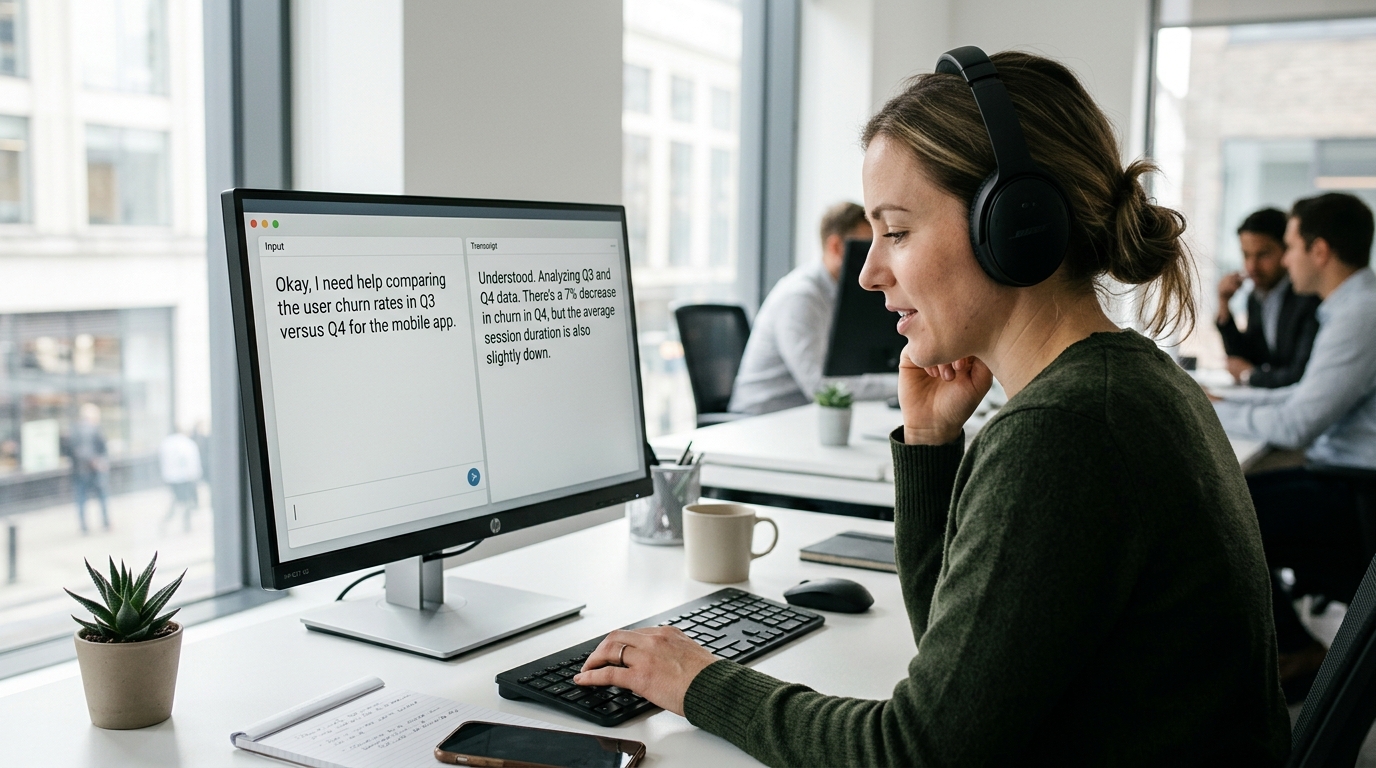

Thinking Machines crea AI que habla y escucha al mismo tiempo

Thinking Machines trabaja en una AI que escucha y responde al mismo tiempo, como en una conversación telefónica. Los modelos convencionales funcionan de forma s

Ahora, cada modelo de IA funciona bajo un único principio: tú escribes, el modelo escucha. Esperas, el modelo responde. Thinking Machines está intentando cambiar esto, creando una arquitectura que procesa tu mensaje y genera una respuesta simultáneamente — como una conversación telefónica normal.

El Problema del Enfoque Actual

Todos los modelos de lenguaje modernos — de ChatGPT a Claude — funcionan bajo el principio de solicitud-respuesta. Envías un mensaje completo, el modelo lo procesa completamente y luego genera una respuesta completa. Esto crea la sensación de que estás hablando con un robot, no con una persona.

En una conversación real, es diferente. Las personas escuchan mientras generan una respuesta. Puedes interrumpir a alguien, aclarar un detalle, añadir contexto — y la persona reacciona al vuelo, sin empezar de cero. Nadie espera a que el otro termine un discurso completo para repensar completamente la respuesta.

Esto crea un flujo natural y orgánico del diálogo. El enfoque actual de IA establece un límite rígido: entrada completa → procesamiento → salida completa. No hay flexibilidad, no hay adaptación durante el proceso, no hay sensación de comunicación bidireccional.

Lo Que Hace Thinking Machines

La startup está desarrollando un modelo que procesa el flujo de entrada en tiempo real y simultáneamente genera un flujo de salida. En lugar de esperar la entrada completa, el sistema comienza a responder mientras recibe información del usuario. Esto abre varias posibilidades fundamentalmente nuevas:

- Escuchar mientras responde — reaccionar a nuevos datos sin recargar el contexto

- Interrupciones naturales — interrumpir, como en un diálogo vivo entre personas

- Adaptación de entonación — cambiar el tono en respuesta a señales de voz en tiempo real

- Señales no verbales — tener en cuenta gestos y expresiones faciales en conversaciones por vídeo

- Latencia mínima — sin pausas muertas entre intercambios

Para asistentes de voz, esto es crítico. Cuando llamas a un call center u ordenas un taxi por voz, no quieres esperar 3–5 segundos de procesamiento. Hablas — el asistente escucha e inmediatamente responde, como una persona.

La Complejidad Arquitectónica del Problema

El procesamiento simultáneo de entrada y la generación de salida es una revisión arquitectónica profunda. Los Transformers, sobre los que se construyen casi todos los LLMs modernos, están diseñados para operación secuencial: lee todo el contexto, genera tokens uno por uno. Cambiar este principio fundamental significa reescribir la mecánica de atención, caché y predicción.

Necesitas mantener un contexto creciente del flujo de entrada mientras simultáneamente generas salida, sin perder coherencia y lógica de la respuesta. Los desafíos prácticos no son menos serios: calidad de la respuesta (¿no se vuelven apresuradas e incompletas?), latencia (se necesita latencia mínima para la naturalidad), gestión de memoria para flujos crecientes. ¿Cómo mantienes el hilo de la conversación si la respuesta se ejecuta en paralelo a la entrada? ¿Cómo no pierdes un detalle al final de un mensaje si ya has comenzado a responder al principio?

Lo Que Esto Significa

Si este enfoque tiene éxito, el diálogo con IA dejará de parecer una interacción con un sistema. Será un diálogo — una conversación real, sin la sensación de rigidez y retraso, más cercano a la comunicación humana.

Para asistentes de voz, chatbots y especialmente call centers, esta es una mejora crítica. Un cliente llamó — el asistente escucha inmediatamente y responde, puede interrumpir para aclarar, adaptar la respuesta basándose en nueva información. Esto aumentará la satisfacción y la velocidad de resolución de problemas muchas veces.