Habr AI explicó el álgebra lineal para redes neuronales con ejemplos prácticos y código

Habr AI publicó una explicación clara de álgebra lineal para principiantes que quieren pasar a las redes neuronales sin lagunas en los fundamentos. El material

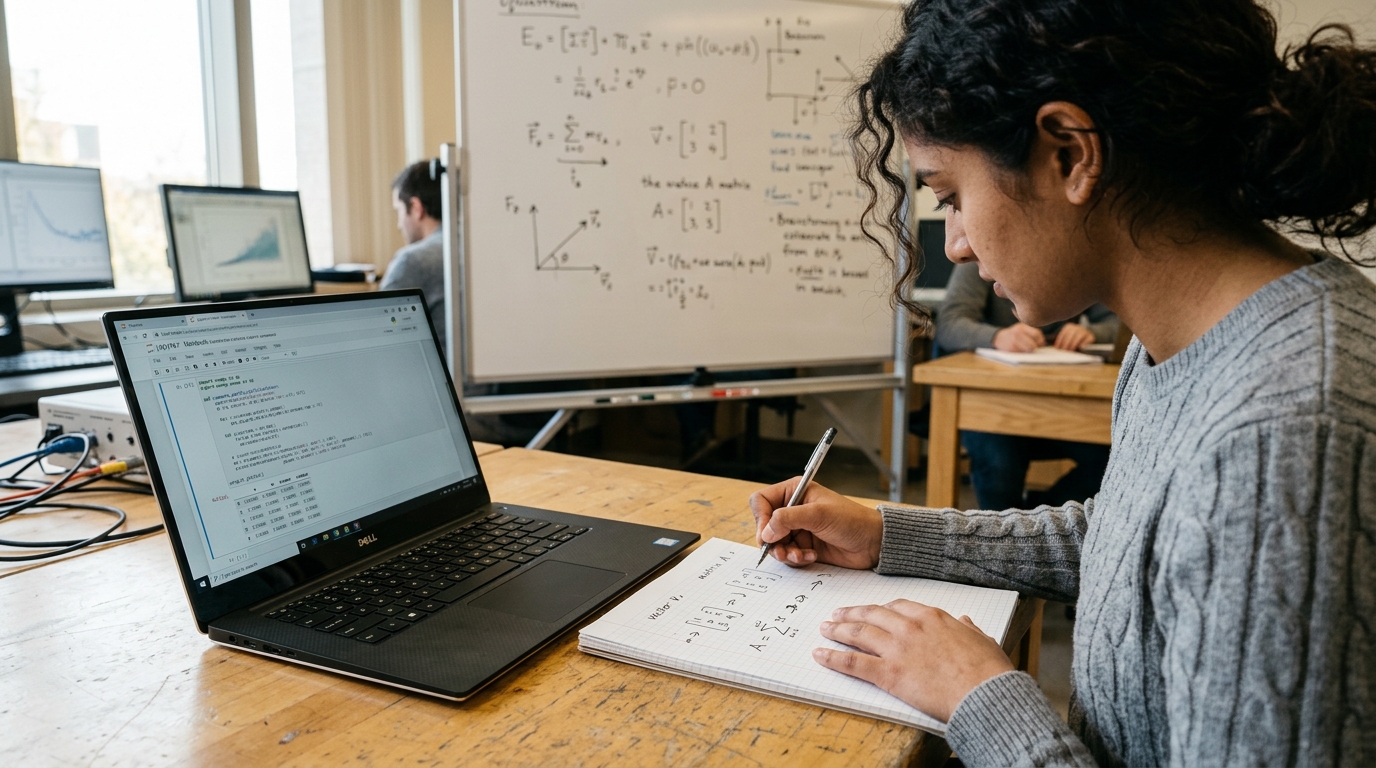

Habr AI выпустил вводный материал по линейной алгебре для тех, кто только подбирается к нейросетям. Текст рассчитан на новичков и объясняет, почему без базовой математики сложно уверенно работать даже с готовыми моделями.

Почему без базы нельзя

Автор сразу задаёт правильную рамку: линейная алгебра нужна не только исследователям, которые строят новые архитектуры, но и инженерам, внедряющим модели в продукт. Если ты настраиваешь параметры, дообучаешь сеть, выбираешь представление данных или просто пытаешься понять, почему модель ведёт себя так, а не иначе, без понимания векторов и операций над ними быстро упрёшься в потолок. Это не академическое украшение, а язык, на котором нейросети описываются и считаются.

При этом материал не пытается отпугнуть формулами с порога. Он собран как входная точка для человека со школьной математикой и без серьёзной подготовки по Data Science. Важный акцент в том, что линейная алгебра здесь подаётся не как отдельный курс ради курса, а как практическая база перед следующими шагами: кодом, слоями, представлением признаков и построением собственной модели.

Такой заход полезен тем, кто хочет не заучить термины, а быстро связать математику с задачами ML.

Что разбирают в статье В центре материала — вектор как базовый объект,

через который потом удобно объяснять почти все вычисления в нейросетях. Автор идёт по темам последовательно: сначала вводит само понятие, затем показывает, как данные переводятся в векторный вид и какие операции над такими объектами встречаются на практике. За счёт этого статья выглядит не как набор формул, а как маршрут от интуиции к прикладному использованию.

понятие вектора и его связь с представлением данных векторизацию признаков, чтобы числа можно было подавать в модель умножение на скаляр и сложение векторов как базовые преобразования норму, скалярное и векторное умножение для измерений и сравнений * практику с кодом и домашнее задание для закрепления Отдельно полезно, что автор не ограничивается сухим перечислением тем. В описании курса прямо сказано, что объяснение идёт на наглядных примерах и в лёгком, почти игровом формате. Для русскоязычной аудитории, которая часто пугается слова «алгебра» ещё до первого абзаца, это хороший ход: сначала снять барьер, потом показать смысл операций, и только после этого переходить к практике.

В результате статья подходит и как быстрый старт, и как опорный конспект перед более глубоким погружением.

Как связан код Самая важная часть в таких материалах — мост между теорией и применением.

Здесь он обозначен довольно чётко: читателю обещают не только объяснение терминов, но и самостоятельную практику с кодом в финале. Это хороший формат для новичков, потому что после чтения можно сразу проверить, понял ли ты, как вектор выглядит в программе, что делает операция умножения, как считается норма и где появляются ошибки в интуиции. Без такого шага даже понятная теория быстро забывается.

Ещё один сильный момент — задел на продолжение. Автор заранее анонсирует следующую статью о линейном представлении нейросетей, где полученные знания уже будут адаптированы под прикладные задачи, написание слоёв на Python и сборку реальной модели. Это делает текущий материал не разрозненной заметкой, а первой ступенью в последовательной обучающей серии.

Если серия сохранит тот же темп и уровень объяснения, она может стать удобной точкой входа для тех, кто хочет перейти от чтения про AI к собственным экспериментам.

Что это значит

Для русскоязычных новичков это полезный формат: не очередной абстрактный разговор о «магии нейросетей», а спокойное введение в математику, на которой всё реально держится. Чем раньше разработчик или аналитик разберётся с векторами и базовыми операциями, тем проще ему будет понимать модели, код и ограничения инструментов.