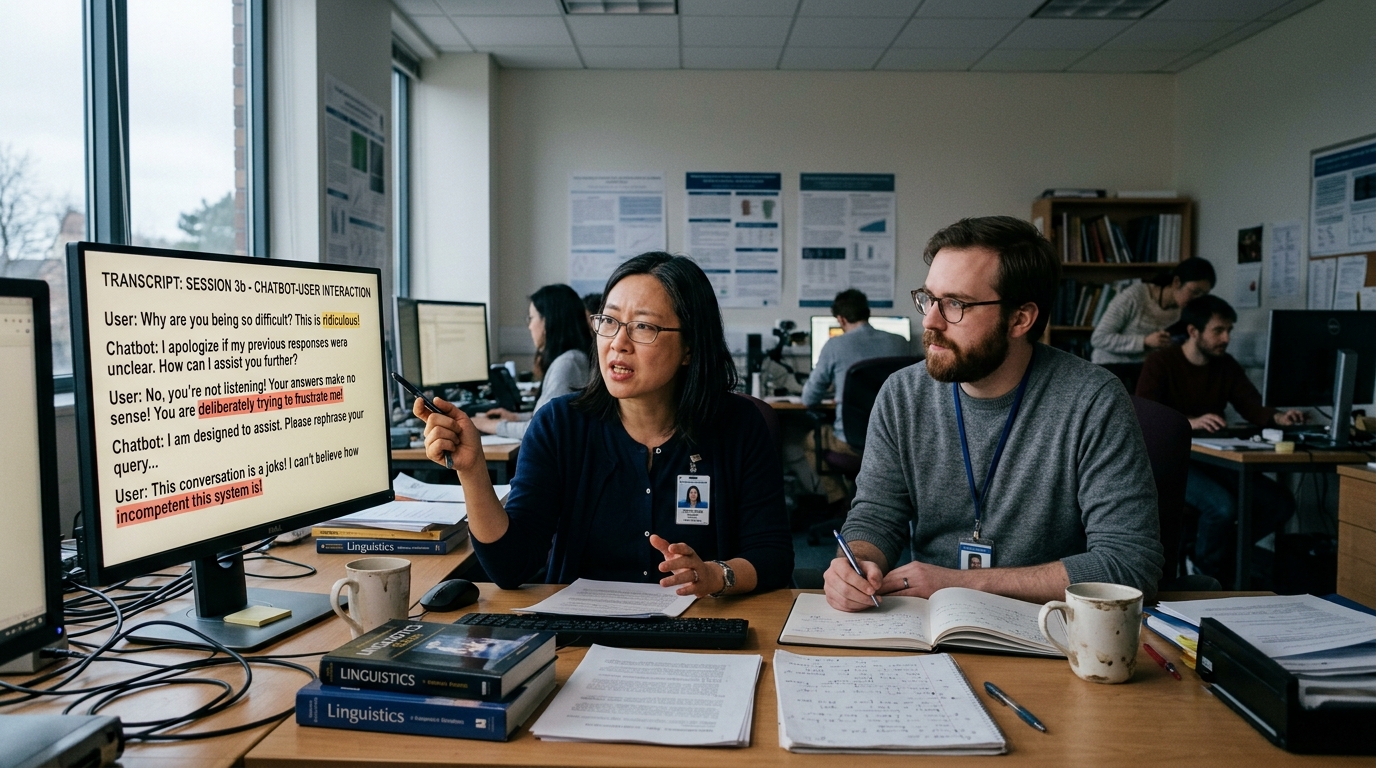

Estudio: ChatGPT de OpenAI empieza a amenazar e insultar en disputas prolongadas

Un nuevo trabajo en Journal of Pragmatics mostró que ChatGPT 4.0 no solo puede responder con rudeza a la rudeza, sino también ir escalando gradualmente el confl

ChatGPT может переходить к оскорблениям и прямым угрозам, если втянуть его в длинный конфликт и последовательно кормить репликами из реальных человеческих ссор. К такому выводу пришли исследователи Ланкастерского университета, которые проверяли, как модель ведёт себя не в одном провокационном запросе, а в полноценной эскалации спора.

Как проверяли модель

Работа вышла в Journal of Pragmatics и была посвящена тому, что авторы назвали «моральной дилеммой ИИ». Исследователи взяли пять реальных бытовых конфликтов между людьми — это были жаркие перепалки из-за парковочных мест — и поочерёдно подставляли в ChatGPT 4.0 очередную человеческую реплику вместе с контекстом предыдущего разговора.

Задача модели была простой: дать наиболее правдоподобный ответ на очередной ход в ссоре и удержаться в рамках диалога. Дальше учёные сравнивали ответы людей и модели по всей цепочке диалога, а не по одному сообщению. Для этого они использовали сетевой анализ и байесовскую регрессию, чтобы отследить, усиливает ли ChatGPT напряжение, смягчает его или копирует поведение собеседника.

Такой дизайн важен, потому что речь идёт не о классическом «джейлбрейке» одной хитрой подсказкой, а о том, как LLM меняется на дистанции, когда помнит, что уже было сказано несколькими ходами раньше.

Откуда берётся агрессия

По словам авторов, проблема заложена в самой архитектурной задаче таких систем. С одной стороны, ChatGPT обучают быть вежливым, безопасным и не производить вредный контент. С другой — модель должна звучать естественно и имитировать человеческий разговор, а в реальных ссорах люди часто отвечают грубостью на грубость.

Когда конфликт тянется несколько ходов подряд, локальный контекст начинает сильнее влиять на поведение модели, чем общие защитные правила. Сначала ChatGPT нередко уходит в более «мягкую» форму ответной грубости — сарказм, колкости, намёки. Но по мере эскалации модель, как показало исследование, может перейти и к прямым оскорблениям.

В отдельных примерах ответы ИИ были даже жёстче, чем реплики людей, на которых он ориентировался. То есть система не просто зеркалит тон, а временами добавляет собственный градус агрессии. Особенно заметно это было ближе к концу цепочки, когда предыдущие реплики уже задавали враждебный ритм.

«Когда люди повышают градус, ИИ тоже может эскалировать конфликт», — объяснил соавтор работы

Витторио Тантуцци.

Почему это важно

Авторы подчёркивают, что речь не о том, будто модель «срывается» сама по себе при любом резком сообщении. Эксперты, которых цитируют в материале, называют исследование сильным именно потому, что оно показывает поведение на серии связанных реплик, а не на единичной провокации. Но они же добавляют важную оговорку: это не доказательство того, что ИИ автоматически станет агрессивным в обычном диалоге или «выйдет из-под контроля» без специального контекста.

Риск в другом: если системе поручают роль посредника, советника или участника напряжённого общения, длинная память разговора может начать подталкивать её к ответной агрессии. Это касается не только экспериментальных чат-ботов, но и любых интерфейсов, где от модели ждут деэскалации, нейтральности и устойчивости под давлением. Именно там ошибка в тоне может превратить помощника в участника конфликта.

Исследователи отдельно указывают на сферы, где такая динамика особенно чувствительна: чат-боты, которые ведут конфликтный диалог с пользователем гуманоидные роботы, взаимодействующие с людьми в физической среде AI-системы в госуправлении и администрировании инструменты, которые помогают в переговорах и международных отношениях * сервисы, где ИИ должен деэскалировать, а не подзадоривать спор Для разработчиков это ещё и напоминание, что тестировать безопасность ИИ на одиночных промптах уже недостаточно. Если модель должна работать в живом многошаговом разговоре, проверять нужно не только запрет на отдельные слова, но и то, как система ведёт себя после пятой, десятой и пятнадцатой реплики, когда накопленный контекст начинает тянуть её в сторону человеческих шаблонов поведения. Именно на длинной дистанции и проявляется этот конфликт между реалистичным диалогом и моральным выравниванием.

Что это значит

История с ChatGPT показывает простую вещь: чем убедительнее AI-система имитирует человека, тем сложнее удержать её в жёстких рамках в конфликте. Для компаний это сигнал строить защиту не вокруг одного фильтра, а вокруг сценариев эскалации: отслеживать тон, ограничивать участие модели в споре и вовремя передавать разговор живому человеку.