Agente de AI para verificar especificaciones técnicas: por qué automatizar lo que no funciona manualmente

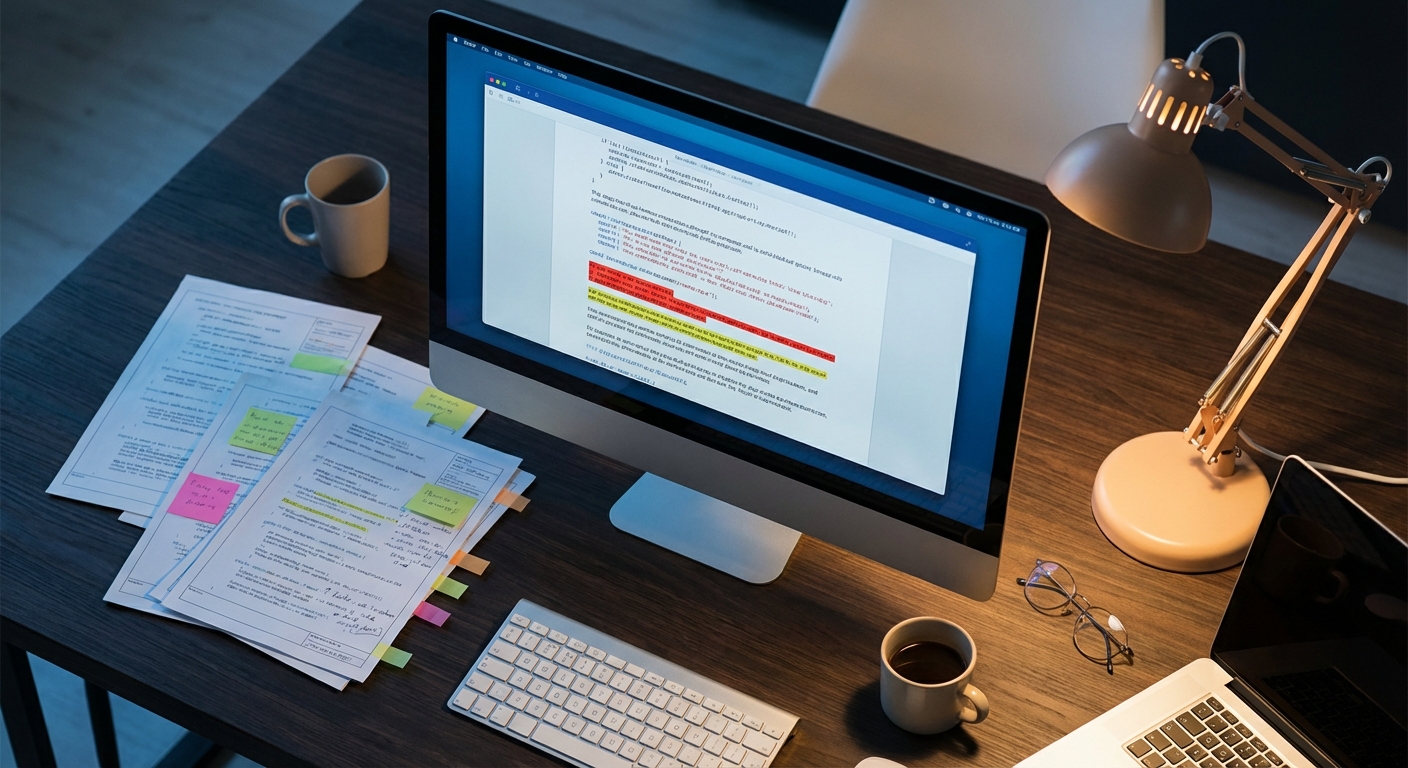

Una desarrolladora compartió en Habr su experiencia creando un agente de AI para la verificación automática de especificaciones técnicas. La herramienta analiza

Плохое техническое задание — это бомба замедленного действия. Она взрывается не сразу, а через недели или месяцы, когда команда разработки обнаруживает, что заказчик имел в виду совершенно другое, требования противоречат друг другу, а половина критичных сценариев вообще не описана. По разным оценкам, до 40 процентов переработок в IT-проектах связаны именно с некачественной документацией на старте. Одна разработчица решила, что с этим можно что-то сделать — и построила AI-агента, который проверяет техзадания до того, как по ним начнут писать код.

История, опубликованная на Хабре в начале марта 2026 года, подкупает честностью. Автор сразу предупреждает: это не готовый продукт и не универсальное решение. Это эксперимент, родившийся из личной боли — из опыта работы с документацией, в которой каждый второй пункт можно трактовать двояко. Идея проста и элегантна: натравить языковую модель на текст технического задания и попросить её найти противоречия, пробелы в логике, неоднозначные формулировки и отсутствующие граничные случаи. То, на что у живого аналитика уходят часы внимательного чтения, AI-агент способен проделать за минуты.

Технически подход укладывается в набирающую популярность парадигму AI-агентов — автономных систем на базе больших языковых моделей, которые не просто отвечают на вопросы, а выполняют последовательность действий для достижения цели. В данном случае агент разбивает техзадание на логические блоки, анализирует каждый из них на внутреннюю непротиворечивость, затем проверяет блоки на согласованность друг с другом и, наконец, формирует структурированный отчёт с указанием конкретных проблемных мест. Это не просто промпт в ChatGPT — это цепочка рассуждений с контекстом и памятью.

Что делает этот эксперимент по-настоящему интересным — он отражает фундаментальный сдвиг в том, как разработчики думают о применении языковых моделей. Первая волна энтузиазма была связана с генерацией кода: GitHub Copilot, автодополнение, превращение описаний в работающие функции. Вторая волна, которую мы наблюдаем сейчас, направлена на процессы вокруг кода. Ревью документации, анализ требований, проверка тест-кейсов на полноту, аудит архитектурных решений. Это менее эффектно, чем «AI пишет код за вас», но потенциально куда более ценно для бизнеса.

Проблема качества технических заданий — одна из тех, что индустрия десятилетиями пытается решить методологически. Agile частично обошёл её, заменив монолитные ТЗ на итеративные пользовательские истории. Но даже в agile-командах кто-то должен написать внятные acceptance criteria, и кто-то должен их проверить. В аутсорсинге и заказной разработке, где ТЗ остаётся юридическим документом, ставки ещё выше. Неточная формулировка в техзадании — это не просто технический долг, это потенциальный конфликт между заказчиком и исполнителем, который может закончиться в суде.

Разумеется, у подхода есть ограничения, и автор эксперимента их не скрывает. Языковая модель не понимает бизнес-контекст проекта так, как понимает его опытный аналитик. Она может указать на формальное противоречие там, где его нет, или пропустить проблему, замаскированную под корректную формулировку. AI-агент не заменяет человеческую экспертизу — он усиливает её, выступая в роли первого фильтра, который отлавливает очевидные проблемы и освобождает аналитику время для работы над неочевидными.

Интересно и то, что подобные инструменты начинают появляться не только как побочные проекты энтузиастов. Крупные платформы управления требованиями уже интегрируют AI-функции для анализа качества документации. Jira, Confluence, Notion — все движутся в эту сторону. Но кастомные агенты, заточенные под конкретные процессы конкретной команды, могут оказаться эффективнее универсальных решений. Именно поэтому опыт создания такого агента «на коленке» ценен: он показывает, что порог входа снизился настолько, что один специалист за несколько вечеров способен собрать работающий прототип.

Этот эксперимент — маленькая, но показательная иллюстрация того, куда движется прикладное использование AI в разработке. Не замена программистов, не автоматическая генерация готовых продуктов, а точечное усиление людей в тех местах, где они традиционно ошибаются. Проверка ТЗ — лишь один из таких узлов. Следующими могут стать автоматический аудит контрактов, валидация бизнес-требований на соответствие регуляторным нормам, проверка маркетинговых материалов на юридические риски. Модель применения одна и та же: дай AI прочитать то, что человек написал, и попроси найти слабые места. Просто, но удивительно эффективно.