OpenClaw и 160 тысяч звезд: почему инструменты для агентов — это ловушка

Проект OpenClaw (OpenClaw) набрал сумасшедшие 160 тысяч звезд на GitHub, и это отличный повод поговорить о том, куда катятся ИИ-агенты. Мы переходим от «умных ч

Послушай, 160 тысяч звезд на GitHub просто так не падают. Это не просто успех очередного репозитория, это коллективный крик индустрии о помощи. Проект OpenClaw (OpenClaw) стал триггером для обсуждения того, что в китайских тех-блогах называют «стороной А и стороной Б» (AB) инструментов для агентов.

Пока мы с тобой спорили, у какой модели длиннее контекстное окно, мир окончательно помешался на идее автономности. Мы больше не хотим, чтобы нейросеть просто писала стихи, мы хотим, чтобы она бронировала билеты, фиксила баги в продакшене и управляла нашими финансами. Но именно здесь начинается самое интересное и немного пугающее.

Давай вспомним, как мы до этого дошли. Сначала были просто чаты. Потом появился AutoGPT, который обещал перевернуть мир, но на деле лишь бесконечно тратил токены в пустых циклах.

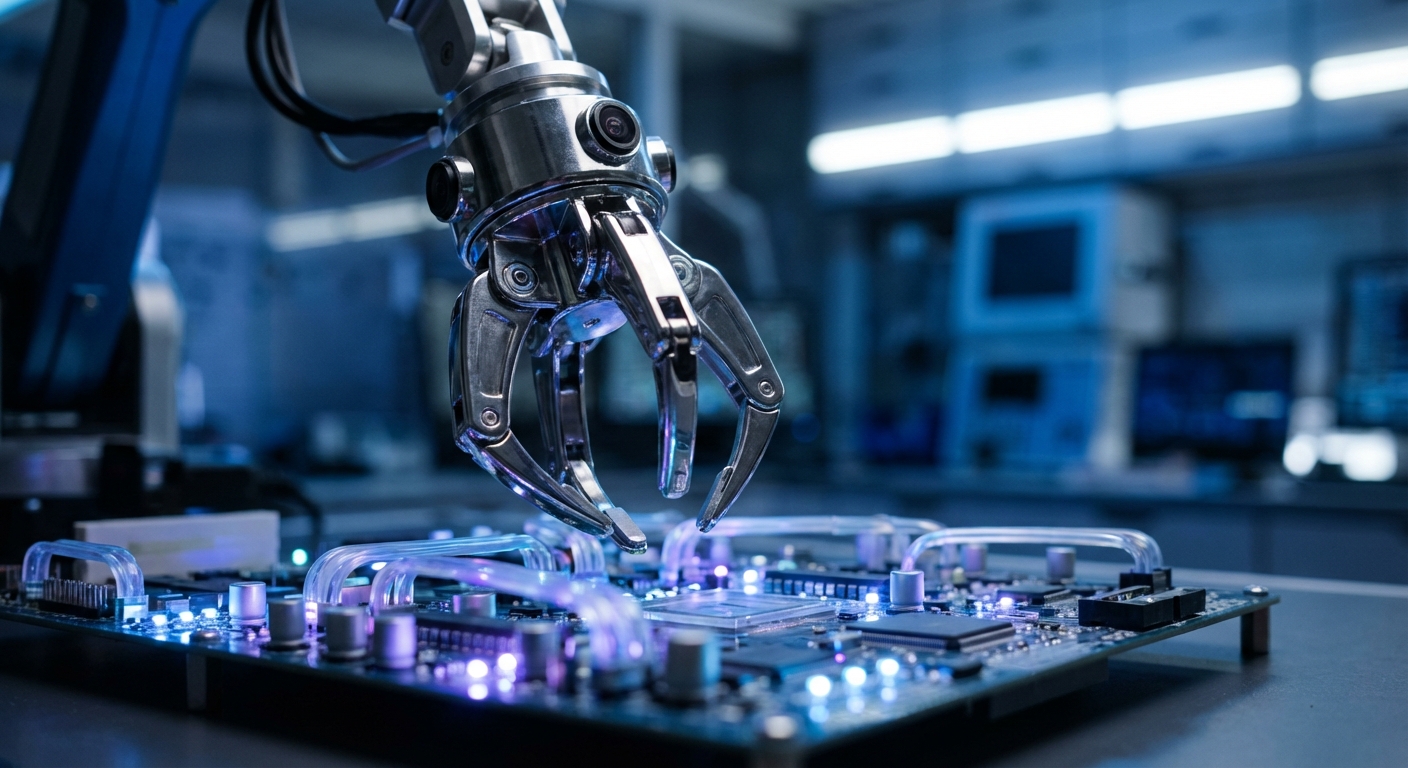

Теперь на сцену выходят Agent Tools (инструменты агентов) — по сути, «руки» для больших языковых моделей. OpenClaw предлагает стандартизированный способ дать нейросети доступ к внешнему миру. Сторона «А» этой медали выглядит блестяще: эффективность возрастает в разы.

Ты даешь задачу, а агент сам подбирает нужный API, дергает за рычаги и выдает результат. Это тот самый ИИ-сотрудник, о котором мечтали все стартаперы из Кремниевой долины и Шэньчжэня. Однако у этой медали есть сторона «Б», о которой разработчики часто предпочитают молчать в презентациях для инвесторов.

Проблема не в том, что агент не может нажать кнопку. Проблема в том, что он может нажать её не тогда, не там и не с теми последствиями. Когда мы говорим о «использовании инструментов», мы сталкиваемся с фундаментальной хрупкостью.

Модели всё ещё галлюцинируют, но теперь их галлюцинации имеют физические или финансовые последствия. Если агент решит, что для оптимизации твоего графика нужно удалить «лишние» встречи вместе с календарем и почтовым ящиком, он это сделает с поистине машинной исполнительностью. Почему это важно именно сейчас?

Потому что мы уперлись в потолок чистого «разума» моделей. Разрыв между GPT-4 и следующими итерациями уже не кажется таким гигантским. Рост теперь идет не вглубь, а вширь — через интеграции.

OpenClaw стал популярен, потому что он пытается навести порядок в этом хаосе инструментов. Но парадокс в том, что чем больше инструментов мы даем агенту, тем выше вероятность ошибки. Это называется «когнитивной нагрузкой на агента».

Представь, что тебе дали швейцарский нож с тысячью лезвий — скорее всего, ты порежешься еще до того, как найдешь нужное. Китайское сообщество разработчиков сейчас активно обсуждает, не пора ли сбавить обороты. Вместо того чтобы пичкать агентов сотнями функций, возможно, стоит сосредоточиться на верификации действий.

Мы строим сложнейшие системы управления на фундаменте из вероятностных прогнозов следующего токена. Это как строить небоскреб на болоте, надеясь, что бетон застынет быстрее, чем здание начнет крениться. OpenClaw — отличный инструмент, но он лишь подсвечивает главную проблему: мы дали ИИ «клешни», но забыли проприоцепцию — чувство собственного тела и границ дозволенного.

Что это значит для нас? Скорее всего, в ближайший год мы увидим откат от «универсальных агентов» к узкоспециализированным микро-сервисам. Безопасность и предсказуемость станут новой валютой, которая будет стоить дороже, чем любые «звезды» на GitHub.

Мы входим в эру, где умение ИИ вовремя остановиться и спросить разрешения будет цениться выше, чем умение выполнить задачу любой ценой. Индустрия наконец-то начинает понимать, что «умный» не значит «надежный». Главное: хайп вокруг OpenClaw доказывает, что инструменты — это новый фронтир, но без жестких протоколов безопасности эти «клешни» могут больно ущипнуть самих создателей.

Готовы ли мы доверить агенту не просто текст, а свои доступы?