TTT-Discover: Stanford y NVIDIA obligan a la IA a "pensar" sobre la marcha y superar a los científicos

Пока индустрия гонится за размером моделей, Стенфорд и NVIDIA решили пойти другим путем. Их новая разработка TTT-Discover использует концепцию Test-Time Trainin

Научный прогресс всегда упирался в одну и ту же стену: проверку гипотез. Вы можете быть гениальным физиком, но симуляция сложного процесса в жидкости или расчет структуры нового материала на суперкомпьютере все равно займет недели. Традиционные методы вычислений точны, но мучительно медленны.

С другой стороны, современные языковые модели обещают скорость, но в точных науках они ведут себя как самоуверенные дилетанты — часто галлюцинируют и выдают красивые, но физически невозможные результаты. Стенфорд и NVIDIA решили, что пора прекратить этот компромисс между скоростью и точностью, представив TTT-Discover. В основе новинки лежит концепция обучения во время тестирования (Test-Time Training,).

Если обычная нейросеть после завершения обучения становится «застывшим» набором весов, то TTT-Discover продолжает учиться прямо в процессе решения конкретной задачи. Представьте себе студента, который не просто зазубрил учебник, а прямо во время экзамена начинает проводить мини-эксперименты, чтобы лучше понять вопрос. Система использует усиленное обучение (Reinforcement Learning) для динамической подстройки под условия задачи здесь и сейчас.

Это позволяет модели адаптироваться к физическим константам и граничным условиям, которые она могла не встречать в обучающей выборке. Зачем это нужно индустрии? Давайте честно: мы достигли предела в простом масштабировании моделей.

Добавление еще пары триллионов параметров уже не дает того качественного скачка в «интеллекте», которого все ждут. TTT-Discover показывает, что будущее за эффективностью вычислений на этапе вывода (inference). Вместо того чтобы знать все обо всем, модели выгоднее научиться глубоко концентрироваться на одной проблеме в момент ее появления.

В тестах на решение дифференциальных уравнений и моделирование сложных систем TTT-Discover показал скорость, в два раза превышающую показатели экспертов-людей, и при этом сохранил точность, недоступную обычным нейросетям. Особенно иронично здесь выглядит участие NVIDIA. Компания, которая зарабатывает миллиарды на продаже «грубой силы» в виде GPU, теперь активно инвестирует в алгоритмы, которые позволяют использовать эту силу гораздо умнее.

Это явный сигнал рынку: эпоха «наваливания терафлопсов» на проблему заканчивается. Теперь важно не сколько у тебя видеокарт, а насколько эффективно твой алгоритм умеет распределять их ресурс для самокоррекции в реальном времени. Для научного сообщества это означает, что сроки разработки новых лекарств или материалов могут сократиться с лет до месяцев.

Важно понимать, что TTT-Discover — это не просто очередной бенчмарк. Это архитектурный сдвиг. Мы переходим от статичных моделей к динамическим агентам, которые осознают контекст задачи.

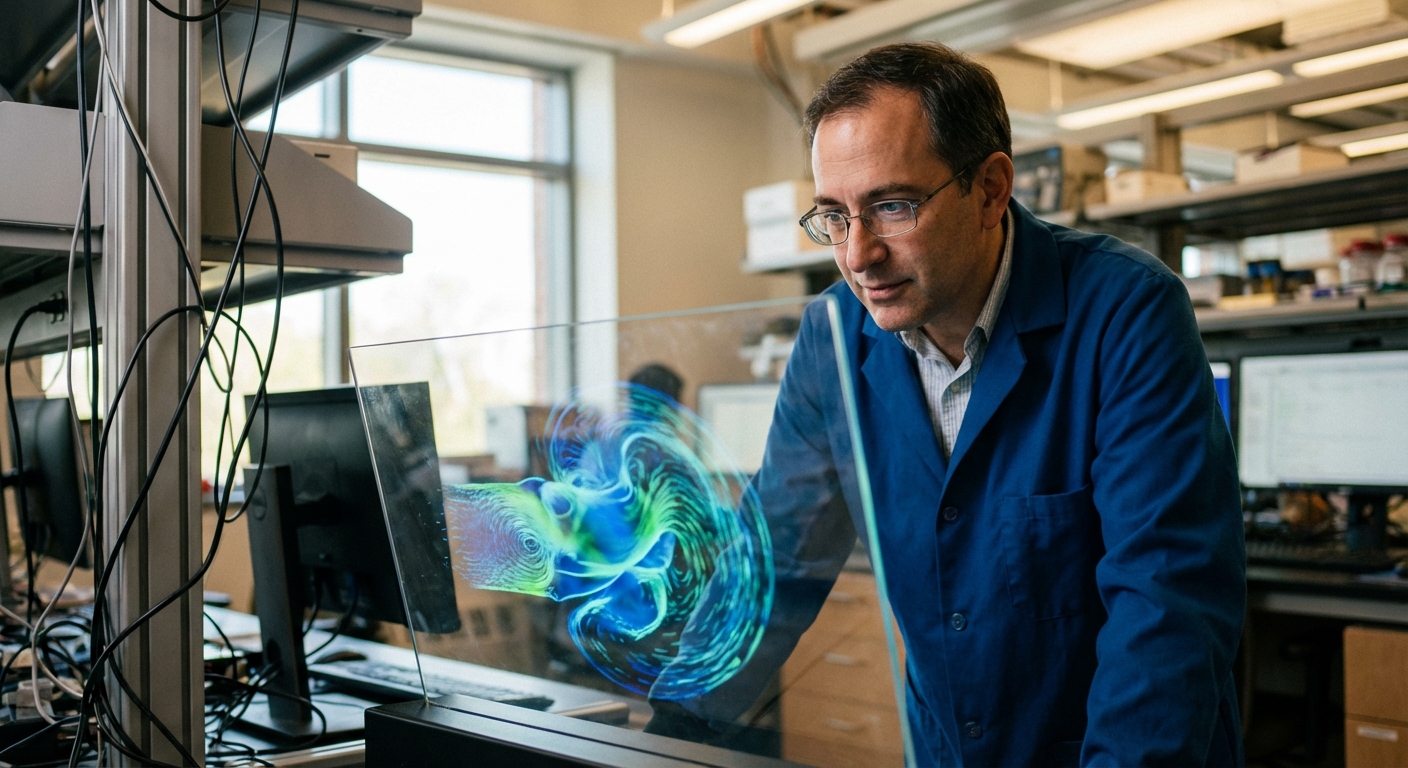

Если раньше ИИ был библиотекой, где нужно было найти правильную страницу, то теперь он становится лабораторией, которая проводит опыты по вашему запросу. И судя по результатам, этот лаборант уже готов занять место ведущего исследователя. Главное: Эпоха статичного ИИ заканчивается.

Смогут ли разработчики других LLM внедрить Test-Time Training достаточно быстро, чтобы не остаться в хвосте научной гонки?