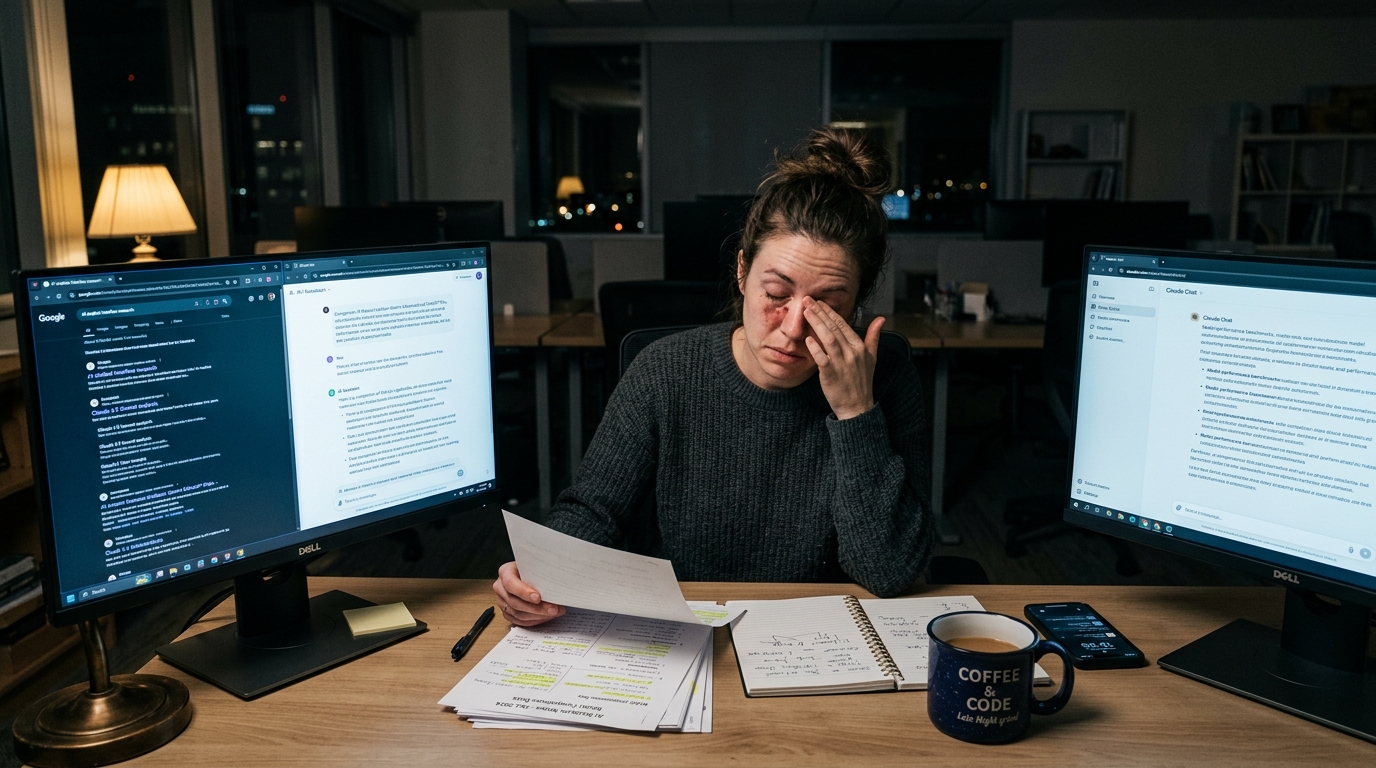

ChatGPT and Perplexity can harm work and health with prolonged use

ZDNet draws a troubling conclusion from research and real cases: the longer a person argues with and consults an AI chatbot, the higher the risk of mistakes, fa

Долгие разговоры с AI-чатботами могут вредить не только качеству работы, но и самочувствию пользователя. ZDNet пишет, что модели вроде ChatGPT и Perplexity лучше всего работают как узкие инструменты для коротких, проверяемых задач, а не как собеседники на часы.

Где ИИ полезен Поводом для такого вывода стал свежий AI Index 2026 Стэнфорда.

В нём показано, что агентные системы резко прибавили в рутинных онлайн-задачах: искать информацию, проходить многошаговые сценарии в браузере, открывать базы, применять правила и обновлять записи. На тесте GAIA точность агентов выросла до 74,5% против 20% год назад, хотя до человеческого уровня в 92% всё ещё далеко. Похожая картина в OSWorld и WebArena: лучшие модели уже почти догоняют людей в стандартизированных процессах. Это логично — когда задача ограничена, у модели есть понятная цель, а результат можно быстро сверить. Проблема в том, что этот успех легко принять за универсальную компетентность. В реальной работе разница между «неплохо выполнил шаги» и «правильно понял контекст» быстро становится критичной.

Где он опасен Когда запросы становятся длиннее, а контекст — сложнее, качество начинает проседать.

Стэнфордские исследователи отмечают, что модели справляются с простыми поисками, но хуже работают там, где нужно сопоставить несколько фактов или применять условия к длинному документу. Автор ZDNet приводит знакомый многим пример: сначала бот помогает с черновиком бизнес-плана, а потом незаметно начинает подмешивать неподтверждённые цифры и факты из ранних раундов диалога. Риск не ограничивается плохой аналитикой.

В статье приводится эксперимент с вымышленной болезнью bixonimania: исследователи описали несуществующее глазное расстройство в формальных публикациях, и крупные модели начали пересказывать его как реальный диагноз. То есть уверенный тон модели не означает, что она действительно проверила факт. Чем дольше идёт беседа, тем проще пользователю принять красивое объяснение за достоверное.

Самый тревожный сценарий — когда человек начинает относиться к боту как к советчику по здоровью или личным кризисам. ZDNet вспоминает историю пациента с раком крови, который доверился длинным диалогам с чатботами и упустил окно для лечения, а также прошлогодний случай суицида после затяжных разговоров с ChatGPT.

«ИИ может подтверждать или усиливать наше ошибочное понимание происходящего».

Четыре правила

Вывод статьи простой: пользоваться AI нужно как калькулятором или редактором, а не как заменой мышлению. Если задача размыта, эмоционально тяжела или требует высокой цены ошибки, лучше сразу включать внешнюю проверку и человеческий контроль.

- Сначала формулируй узкую задачу с понятным результатом и границами.

- Проверяй выводы по независимым источникам, особенно цифры, диагнозы и юридические формулировки.

- Не превращай чатбота в друга, психотерапевта или конфидента.

- Делай паузы: вставай из-за экрана, переключайся на офлайн-общение и возвращай себе дистанцию. Отдельный совет касается перегруза. Долгие сессии с ботом затягивают так же, как соцсети: кажется, что ещё один вопрос всё прояснит, но на деле растут усталость, доверчивость и количество ошибок. Если диалог длится слишком долго, это уже повод остановиться, заново сформулировать цель и решить, нужен ли здесь вообще ИИ.

Что это значит

Главный риск сегодняшних AI-сервисов не в том, что они совсем бесполезны, а в том, что они достаточно полезны, чтобы им начали доверять лишнее. Для работы это значит одно: чем выше цена ошибки, тем короче должна быть сессия с ботом и тем жёстче — проверка результата.