Democratic Alliance ministers in South Africa embroiled in scandal over AI errors

In South Africa, two Democratic Alliance ministers have found themselves at the center of a scandal over AI hallucinations in official documents. Solly Malatsi

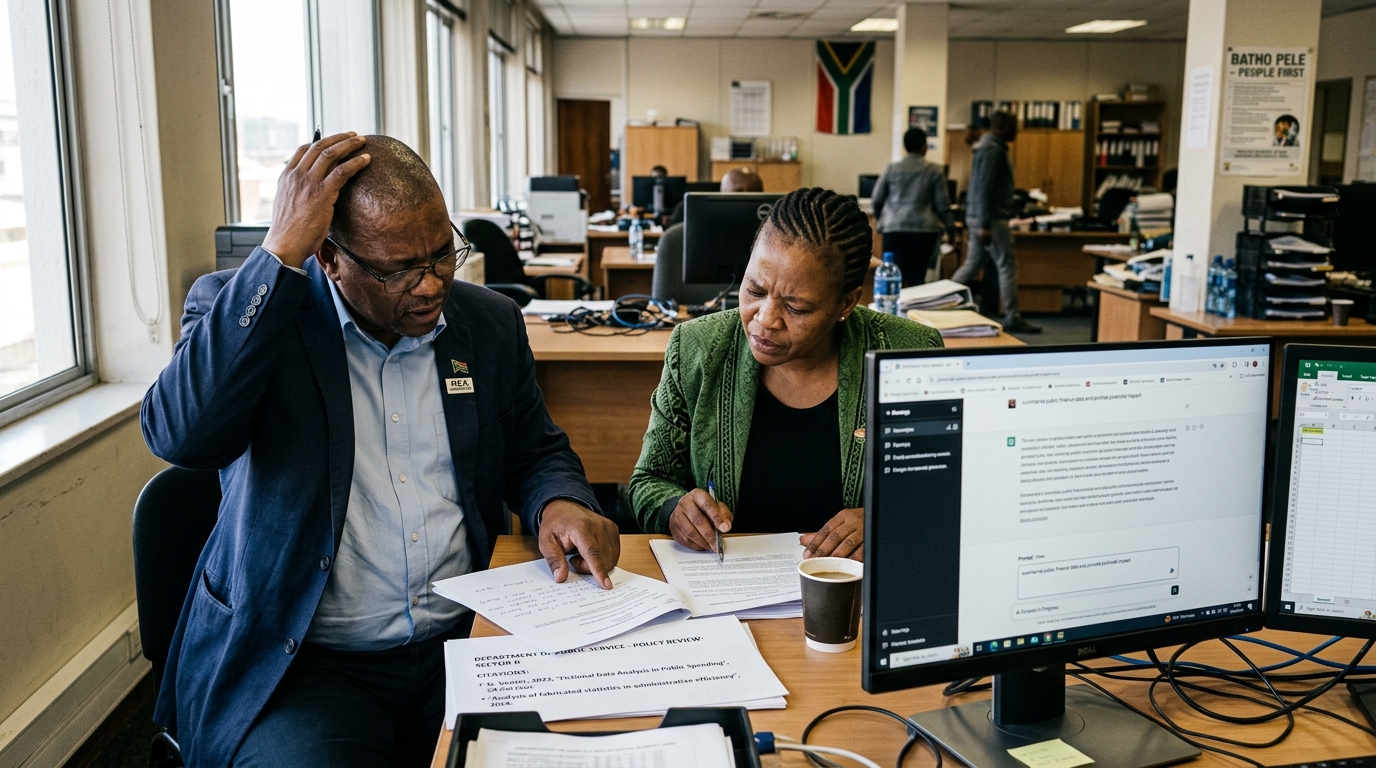

Власти ЮАР получили редкий и болезненный пример того, как галлюцинации ИИ превращаются из абстрактного риска в политический скандал. За одну неделю из-за недостоверных ссылок в официальных документах оказались под давлением сразу два министра от Демократического альянса.

Два сбоя подряд Для Демократического альянса эта история особенно неудобна.

Партия с 2024 года входит в правящую коалицию как вторая по величине сила и постоянно продвигает идею технологической модернизации государства. На этом фоне серия ошибок выглядит не как частная оплошность чиновников, а как удар по собственному политическому тезису: если ты обещаешь сделать госаппарат быстрее и умнее с помощью новых инструментов, то должен первым показать, что умеешь контролировать их качество. 30 апреля министр внутренних дел Леон Шрайбер отстранил двух высокопоставленных сотрудников после того, как в одобренном кабинетом документе по иммиграционной политике нашли ссылки, похожие на галлюцинации ИИ.

А 26 апреля министр коммуникаций и цифровых технологий Солли Малатси был вынужден полностью отозвать проект национальной политики по ИИ, вынесенный на общественное обсуждение. Ирония в том, что проблемы нашлись именно в документе, который должен был задать правила ответственного использования искусственного интеллекта.

Как нашли ошибки

Скандал вокруг проекта политики по ИИ начался после того, как журналисты и эксперты проверили список литературы в конце документа. В 86-страничном проекте, опубликованном 10 апреля 2026 года после одобрения кабинетом 25 марта, было 67 ссылок. Как минимум часть из них оказалась фиктивной: издания либо не публиковали указанные статьи, либо сами названия работ выглядели сгенерированными моделью.

В итоге министерство признало, что в текст, вероятнее всего, попали сгенерированные ИИ цитаты без должной ручной проверки, а сам документ утратил доверие еще до завершения консультаций. Сам документ был амбициозным: он предлагал создать несколько новых структур для регулирования ИИ, включая национальную комиссию, совет по этике, институт безопасности и специальный страховой фонд на случай ущерба от таких систем. Поэтому скандал ударил не только по форме, но и по содержанию: обсуждение архитектуры регулирования почти сразу ушло в тень, потому что доверия к исходному тексту уже не осталось.

«Это не должно было случиться.

Мы усвоим этот урок со смирением», — сказал Малатси. Через четыре дня похожая проблема всплыла уже в другом ведомстве — в проекте пересмотренной белой книги по гражданству, иммиграции и защите беженцев. Этот документ тоже имел высокий статус, потому что уже прошел кабинет министров и описывался как крупнейшая реформа миграционной системы за поколение. Когда сомнительные ссылки заметили и там, история перестала выглядеть как единичный промах одного департамента. Она превратилась в сигнал, что в госаппарате ИИ может использоваться быстрее, чем появляются процедуры проверки его результатов.

Политическая цена ошибки

Для правительства национального единства это неприятный эпизод сразу на нескольких уровнях. Во-первых, он бьет по репутации министров, которые пришли с обещанием большей дисциплины и технологичности. Во-вторых, дает оппонентам готовый аргумент против ускоренного внедрения ИИ в государственное управление.

В-третьих, откладывает саму дискуссию о регулировании: вместо обсуждения архитектуры будущей политики страна вынуждена разбираться с тем, кто и как допустил публикацию недостоверных данных в официальных бумагах. срочная проверка ссылок и приложений в действующих проектах политик обязательная верификация материалов, созданных с помощью ИИ, в процессе согласования документов внутренние расследования и дисциплинарные меры в двух ведомствах задержка с новой редакцией национальной политики по ИИ * рост недоверия к тезису, что цифровизация сама по себе делает государство эффективнее При этом сам повод для спора не отменяет сути проблемы, которую партия поднимала раньше. Южноафриканский госаппарат и правда страдает от медленных процессов и слабого контроля качества.

Но эта история показала неудобную вещь: генеративные модели не исправляют бюрократию автоматически. Если поверх старых процедур просто наложить чат-ботный слой, ошибки будут не исчезать, а становиться более убедительными на вид.

Что это значит

История в ЮАР — хороший тест на зрелость для любого государства и бизнеса, которые уже встраивают генеративный ИИ в рабочие процессы. Модель может ускорить черновик, подобрать формулировку и собрать структуру, но не несет ответственности за факты. Чем официальнее документ и выше цена ошибки, тем важнее ручная проверка ссылок, источников и выводов. Иначе ИИ становится не инструментом эффективности, а фабрикой правдоподобных провалов.