MIT develops 'humble' AI for diagnosis that honestly shows doubts

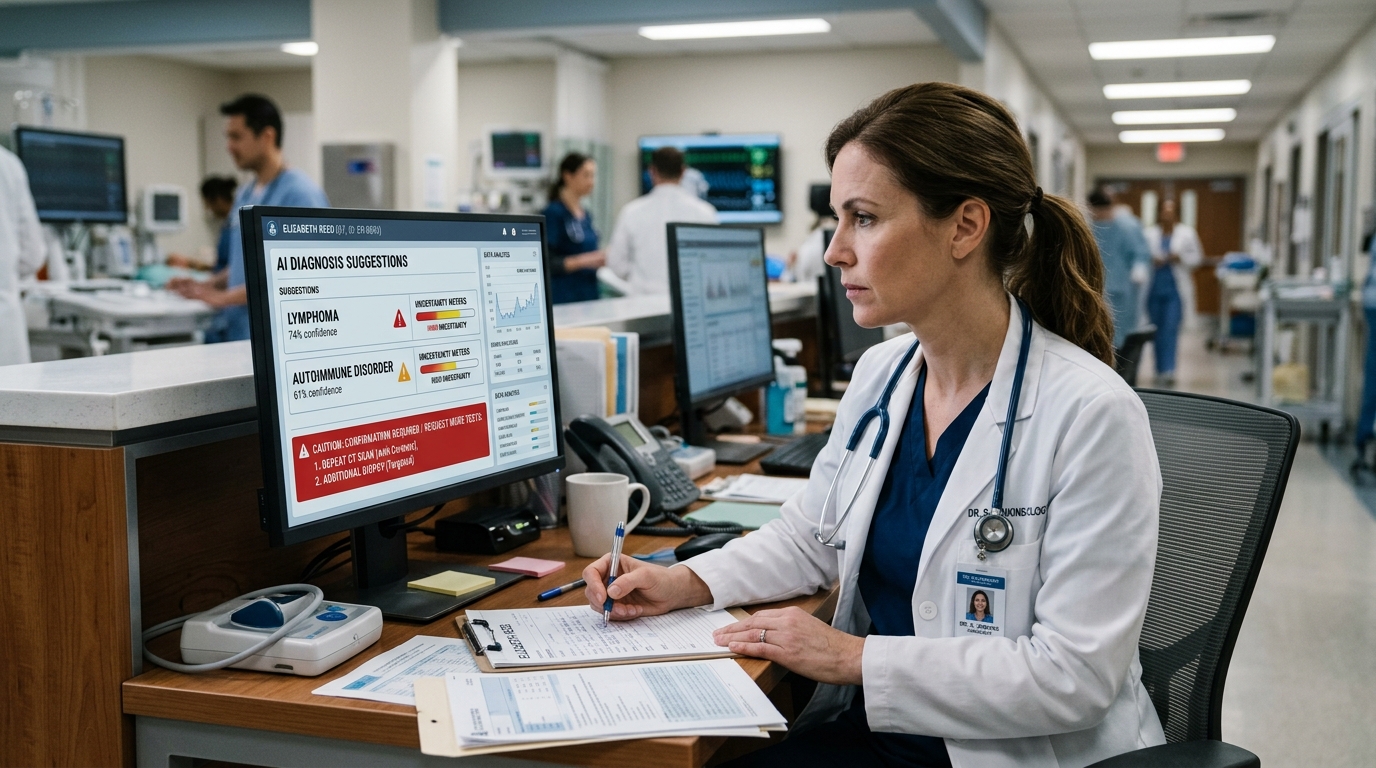

MIT proposes making medical AI not omniscient, but 'humble': the model should show when it lacks data for a diagnosis. Instead of a confident but potentially er

Исследователи MIT предложили новый подход к медицинскому ИИ: система для клинической диагностики должна не изображать всезнайку, а открыто показывать, когда ей не хватает данных. Вместо «оракула» команда хочет сделать из модели партнёра для врача, который помогает собрать недостающую информацию и не давит авторитетным ответом.

Почему это нужно ИИ-системы давно обещают ускорить диагностику и

помочь с подбором лечения, но в клинике у них есть опасная слабость: они часто звучат слишком уверенно даже тогда, когда ошибаются. Команда MIT ссылается на предыдущие исследования, где врачи интенсивной терапии склонялись к совету алгоритма, если считали его надёжным, даже когда собственная интуиция подсказывала обратное. Та же логика работает и с пациентами: авторитетный тон повышает доверие даже к неправильной рекомендации.

Проблема не только в точности моделей, но и в том, как они подают ответ. Если система выдаёт диагноз как окончательную истину при неполном контексте, врач получает ложное чувство определённости. В отделениях неотложной помощи и реанимации это особенно рискованно: там решение часто принимается быстро, а цена ошибки высока.

Поэтому исследователи предлагают учить модель не просто отвечать, а явно сигнализировать о границах своей уверенности.

Как устроен подход

Команда описывает рамку, которую можно встроить в уже существующие системы клинической поддержки решений. Её первый модуль заставляет модель оценивать собственную уверенность перед тем, как выдать диагностический прогноз. Для этого исследователи используют показатель Epistemic Virtue Score, разработанный вместе с учёными из Университета Мельбурна.

По сути это проверка на самосознание: уверенность модели должна соответствовать сложности случая и объёму доступных данных. Если система видит, что её уверенность выше, чем позволяют доказательства, она должна не дожимать вывод, а изменить поведение: пометить расхождение между уверенностью и качеством данных запросить конкретные анализы, детали анамнеза или недостающие признаки предложить консультацию профильного специалиста подсказать, какая информация поможет снять неопределённость * предупредить, что текущий ответ требует осторожной интерпретации > «Сейчас мы используем ИИ как оракула, но его можно превратить в тренера и настоящего со-пилота», — говорит Лео Энтони Сели. Команда Сели раньше участвовала в создании крупных наборов данных для медицинского ИИ, включая базу MIMIC.

Теперь исследователи пытаются встроить новый подход в системы, работающие на этих данных, и показать его клиницистам в сети Beth Israel Lahey Health. По их словам, тот же подход можно применять не только в текстовых диагностических помощниках, но и в системах анализа рентгеновских снимков или выбора тактики лечения в приёмном покое.

Проблема данных Работа про «скромный»

ИИ — часть более широкой программы MIT по созданию медицинских моделей, которые проектируются не только для людей, но и вместе с ними. Исследователи отдельно подчёркивают риск перекосов в данных: многие популярные модели обучаются на публичных датасетах из США и неизбежно наследуют определённый взгляд на болезни, лечение и организацию помощи. То, что хорошо описано в одной системе здравоохранения, может хуже работать в другой или незаметно исключать целые группы пациентов.

Есть и более приземлённая проблема: электронные медкарты изначально создавались не как идеальный источник для обучения диагностических моделей. В них часто не хватает контекста, который врач получает из разговора, наблюдения или опыта. Кроме того, часть пациентов вообще не попадает в такие наборы данных из-за ограниченного доступа к медицине — например, люди из сельских районов.

На воркшопах MIT Critical Data исследователи, врачи, социологи и сами пациенты вместе проверяют, кого не хватает в датасете и какие структурные перекосы модель может закрепить.

Что это значит

Следующий этап развития медицинского ИИ — не только борьба за ещё пару процентов точности в бенчмарках, но и умение вовремя сомневаться. Если такой подход дойдёт до реальной клиники, ценность модели будет не в замене врача, а в более прозрачной, осторожной и совместной работе с ним.