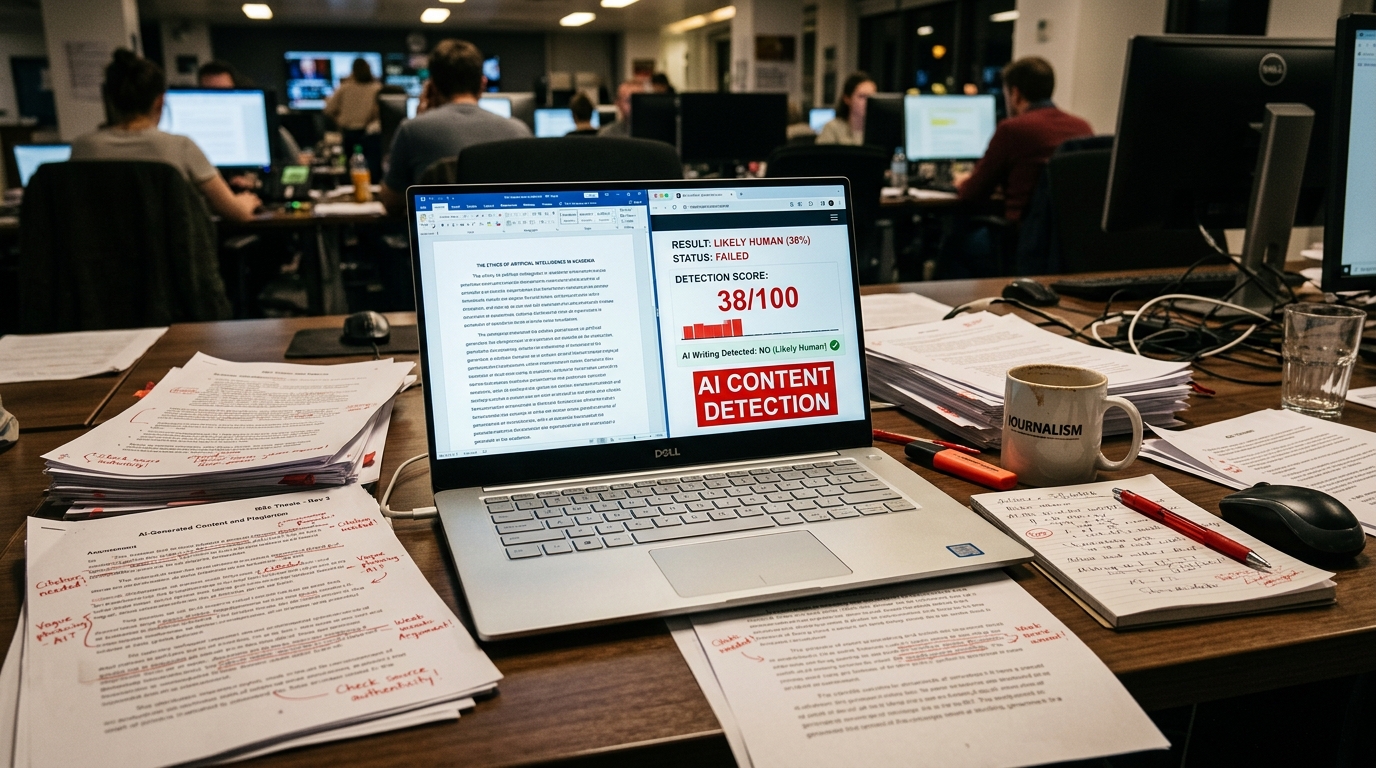

Turnitin and OpenAI Are Losing: Why AI Detectors Can No Longer Distinguish Humans From Models

AI detectors are rapidly losing relevance: modern language models now imitate human speech too convincingly. Research shows accuracy at the level of random gues

Языковые модели подошли к точке, где по одному тексту все сложнее понять, писал его человек или машина. Поэтому ИИ-детекторы превращаются в слабый фильтр: они пропускают синтетику и одновременно все чаще ошибаются на живых авторах.

Почему модели похожи

Еще недавно казалось, что машинный текст можно узнать по стерильной гладкости, повторяемым оборотам и слишком правильной структуре. Но современные LLM ушли далеко от примитивного «угадай следующее слово». Поверх базового языкового предсказания появились механизмы, которые помогают удерживать смысл, копировать интонацию и адаптировать ответ под конкретную аудиторию.

Модель учится не только говорить связно, но и звучать похоже на человека, который пишет курсовую, спорит в чате или объясняет тему коллеге. На это работают сразу несколько слоев. Стилевой перенос помогает воспроизводить индивидуальную манеру письма, fine-tuning шлифует речь на реальных примерах, inference использует контекст беседы, а RLHF подгоняет ответы под человеческие ожидания по логике, вежливости и естественности.

В результате пропадает прежняя дистанция между «машинным» и «человеческим» текстом. Модель может быть сухой и академичной, разговорной и неровной или даже намеренно грубоватой, если такой стиль лучше проходит за живую речь.

Где детекторы ломаются На этом фоне сами детекторы теряют опору.

Исследование 2025 года, на которое ссылается автор материала, показало почти ничейный результат: и люди, и алгоритмы определяли ИИ-тексты с точностью около 57%. Это уже не инструмент контроля, а почти подбрасывание монеты. Отдельная проблема в том, что текст можно дополнительно прогнать через парафразирование, и тогда статистические следы генерации стираются еще сильнее. Чем лучше модели умеют переписывать самих себя, тем хуже работают системы, которые ищут старые сигнатуры.

«ГПТ, не ГПТ?» — слишком часто проверка сегодня сводится именно к этому.

- В исследованиях точность детекции все чаще оказывается близкой к случайному угадыванию.

- Повторное парафразирование убирает шаблонность, предсказуемость и другие заметные маркеры генерации.

- Ложно-положительные срабатывания бьют по реальным авторам сильнее, чем по тем, кто массово использует ИИ.

- OpenAI закрыла свой AI Classifier после слабых результатов: инструмент находил около 26% сгенерированных текстов. Самый болезненный эффект — ошибки против людей. В 2023 году в США громкий случай с Turnitin ударил по школьнице, чье эссе система почти полностью записала в ИИ-работы. Позже независимая проверка показала, что сам детектор далеко не безошибочен и распознает лишь часть машинных текстов. Такая асимметрия опасна: генератор может пройти незамеченным, а добросовестный автор — получить репутационный удар. Если речь идет о дипломе, научной публикации или аттестации, цена одной ошибки становится слишком высокой.

Что менять сейчас

Главный вывод для образования и науки простой: проверять нужно не только итоговый текст, а весь процесс его появления. Чем сильнее система вознаграждает объем, формальную структуру и канцелярскую «воду», тем легче ее обмануть с помощью LLM. Значит, полезнее смещать акцент на устную защиту, черновики, историю правок, качество источников, воспроизводимость выводов и способность автора объяснить свою аргументацию без шпаргалки.

Там, где нужно показать понимание темы, а не просто выдать много ровного текста, у модели меньше пространства для незаметной подмены. Вне академической среды проблема не менее практическая. Слабые детекторы не останавливают дезинформацию и почти бесполезны против социальной инженерии, где важны скорость, масштаб и убедительный тон.

Поэтому в редакциях, компаниях и обычной переписке нужен не «магический сканер ИИ», а нормальная верификация: проверка фактов по нескольким источникам, подтверждение личности через второй канал, внимательность к слишком быстрым и слишком отполированным сообщениям. Гладкий текст может быть сигналом, но не доказательством — и ровно это делает человеческую проверку снова центральной.

Что это значит ИИ-детектор больше нельзя воспринимать как судью,

который выносит окончательный вердикт по тексту. Максимум — это вспомогательный индикатор. Доверие теперь смещается от поверхности текста к происхождению, процессу создания и способности автора подтвердить, что он действительно понимает написанное.