How Hugging Face Builds Scalable Web Apps with OpenAI Privacy Filter

Hugging Face explored how to turn OpenAI Privacy Filter into real web products, not just a text editing model. The example includes three applications: a PDF an

Через несколько дней после того, как OpenAI выпустила модель Privacy Filter, команда Hugging Face показала не абстрактную презентацию, а три рабочих сценария, в которых этот инструмент превращается в полноценные веб-приложения. Идея простая: сначала локально находить и маскировать персональные данные, а уже потом отдавать текст, документ или скриншот дальше по AI-конвейеру. Для команд, которые строят интерфейсы вокруг чувствительных данных, это важнее очередного чат-демо, потому что вопрос не только в качестве модели, но и в том, как встроить её в реальный продукт без лишней инфраструктуры.

Сам Privacy Filter OpenAI выпустила 22 апреля 2026 года. Это open-weight модель для поиска и редактирования PII в тексте с лицензией Apache 2.0, так что её можно запускать в своём окружении, дообучать под собственные кейсы и использовать в коммерческих продуктах.

У модели 1,5 млрд параметров, но активными остаются около 50 млн, а контекст достигает 128 тысяч токенов. Она размечает текст за один проход и ищет восемь типов чувствительных сущностей: имена частных лиц, адреса, email, телефоны, URL, даты, номера счетов и разные секреты вроде паролей или API-ключей. По данным OpenAI, модель показывает F1 96% на бенчмарке PII-Masking-300k, а на исправленной версии датасета — 97,43%.

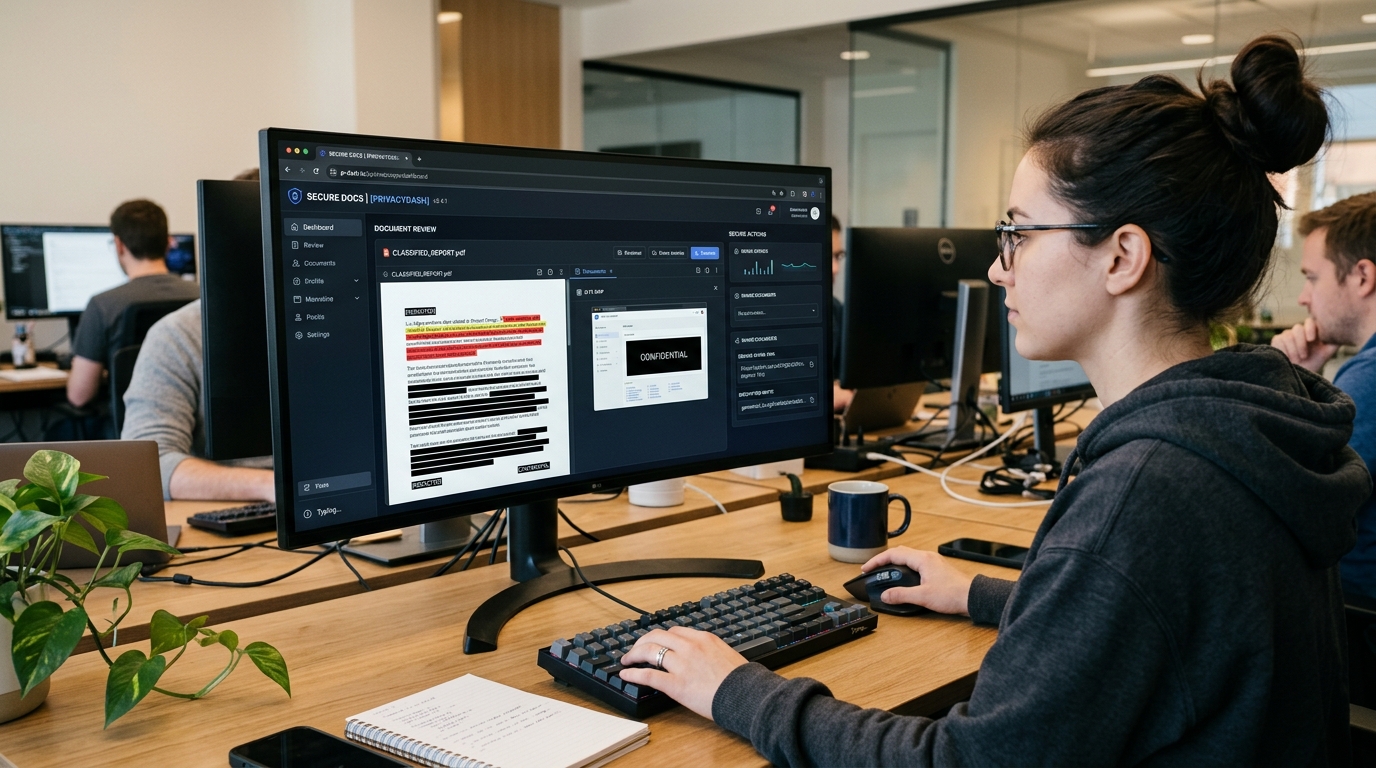

Важная деталь: это не генератор текста, а специализированный классификатор токенов, поэтому он подходит именно для быстрых privacy-задач в логах, документах, индексах и пайплайнах разметки. Первый пример от Hugging Face — Document Privacy Explorer. Пользователь загружает PDF или DOCX и получает документ обратно с подсвеченными фрагментами PII, фильтром по категориям и сводной статистикой сверху.

За счёт длинного контекста модель может обработать большой документ целиком, без разбиения на чанки и последующей склейки, а значит, смещения символов совпадают с тем, что видит пользователь в интерфейсе. Команда отдельно подчёркивает, что такой reader-интерфейс проще было написать вручную на HTML и JavaScript, чем собирать из готовых UI-блоков. Серверная часть при этом остаётся компактной: один endpoint через gradio.

Server принимает файл, извлекает текст, прогоняет его через Privacy Filter и возвращает текст, найденные спаны и статистику. Второй сценарий — Image Anonymizer для скриншотов и изображений. Здесь пайплайн чуть сложнее: сначала OCR через Tesseract получает текст и координаты слов, затем Privacy Filter определяет чувствительные фрагменты, а после этого backend переводит найденные спаны обратно в прямоугольники на изображении.

На выходе пользователь получает не просто замазанный скриншот, а интерактивный canvas: чёрные плашки можно включать и выключать по категориям, двигать, дорисовывать вручную и экспортировать готовый PNG без повторной отправки изменений на сервер. Для приватных сценариев это сильный аргумент: вся постобработка остаётся в браузере, а модель нужна только на шаге первичного детекта. Третий пример — SmartRedact Paste, по сути pastebin для чувствительного текста.

Пользователь вставляет лог, письмо или тикет и получает две ссылки: публичную версию с масками вроде PRIVATE_EMAIL и PRIVATE_PERSON, а также приватную ссылку с токеном, где можно увидеть оригинал с подсветкой найденных фрагментов. Этот пример хорошо показывает, зачем Hugging Face использует именно gradio.Server.

Всё, что связано с моделью, идёт через очередь @server.api, а обычные страницы и просмотр вставок обслуживаются простыми маршрутами FastAPI в том же процессе. Благодаря этому у сервиса могут сосуществовать кастомные URL, токен-гейт для приватного просмотра и одна и та же функция детекта, доступная и из браузера, и из Python-клиента.

В статье отдельно отмечают, что весь сервис вместе с хранилищем помещается примерно в 200 строк прикладного кода. Главный вывод из этих примеров не в том, что Gradio умеет показывать красивые демо, а в том, что privacy-инфраструктура начинает выглядеть как нормальный продуктовый слой. Hugging Face предлагает простое правило архитектуры: тяжёлые операции с моделью отправлять в очереди gradio.

Server, а всю остальную логику — страницы, выдачу файлов, дешёвые чтения, токен-проверки — оставлять на обычных FastAPI-маршрутах. Такой расклад даёт масштабируемость без дублирования backend-кода и позволяет делать собственные интерфейсы вместо шаблонных форм. Для рынка это сигнал, что локальная фильтрация персональных данных перестаёт быть задачей только для крупных enterprise-команд.

При этом OpenAI прямо предупреждает: Privacy Filter — не сертификат соответствия и не замена policy review. В юридических, медицинских и финансовых сценариях всё равно нужны проверка человеком, оценка на доменных данных и аккуратная настройка порогов. Но как базовый строительный блок для безопасных AI-приложений это уже очень практичный инструмент.