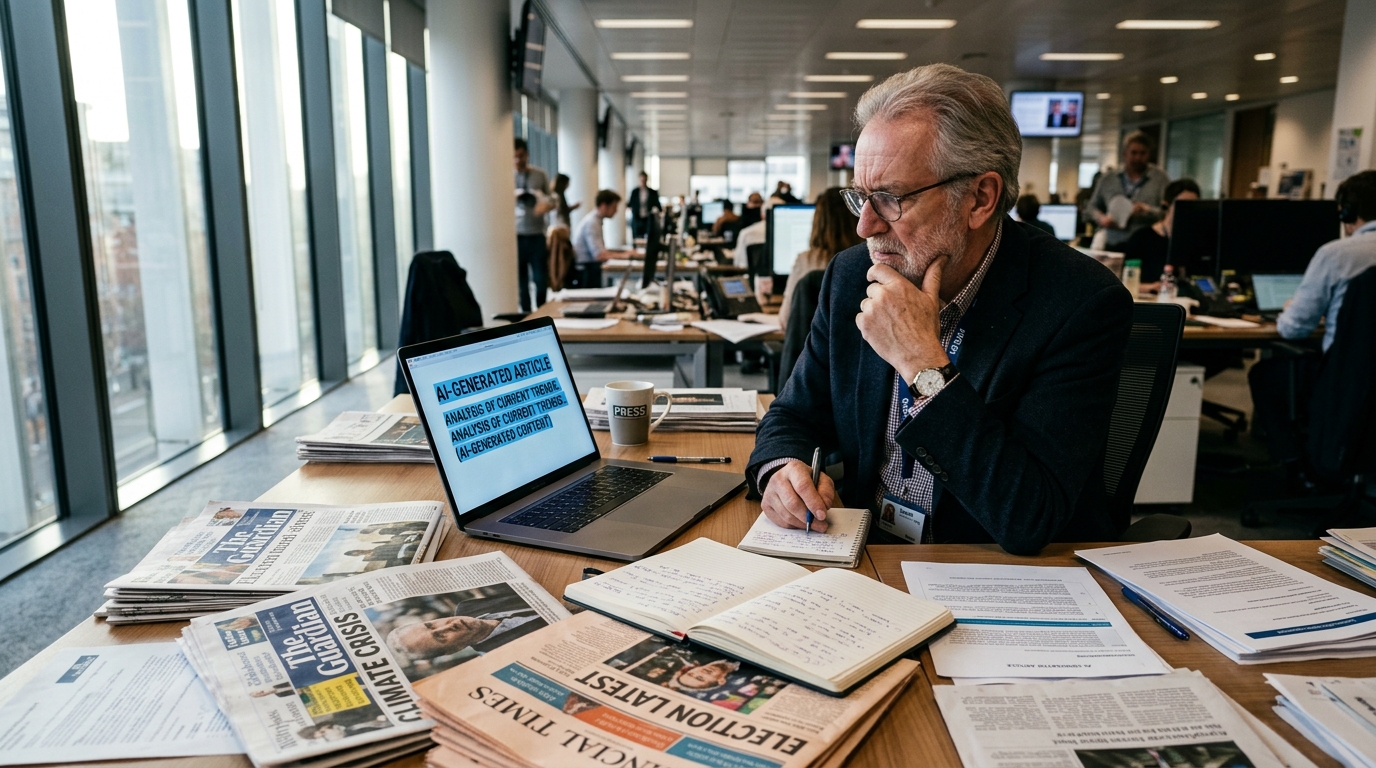

Wired: Editorial offices secretly deploy AI assistants for article writing — and remain silent about the consequences

AI writing quietly takes over newsrooms. Publishers call it efficiency — journalists speak of loss of voice and meaning. Wired examines how text automation chan

AI-письмо тихо проникает в редакции — не через громкие объявления, а через небольшие уступки: сначала черновик новостной заметки, потом сводка финансовых данных, потом первая версия репортажа. Издатели называют это эффективностью. Журналисты видят в этом нечто другое.

Wired поднимает тему, которую медиаиндустрия предпочитает обходить стороной: что происходит с журналистикой, когда AI начинает делать первый — и самый важный — шаг в работе над материалом? Черновик задаёт структуру. Черновик определяет угол зрения.

Черновик — это уже половина готовой статьи. Если его пишет машина, кто несёт ответственность за то, что выйдет на полосе? Давление на редакции нарастает с нескольких сторон одновременно.

Рекламные доходы продолжают падать. Читатель всё чаще получает информацию из соцсетей и поисковиков — порой вообще минуя сайт издания. На этом фоне сокращение себестоимости текста выглядит привлекательно: AI-инструменты обещают ту же скорость при меньших затратах на персонал.

BuzzFeed, CNET, Sports Illustrated, G/O Media — все они так или иначе экспериментировали с автоматизацией текстов в последние два-три года. Результаты неоднозначны: были и фактические ошибки, и откровенные провалы, и тихие отказы от экспериментов без официальных объяснений. Но проблема глубже, чем фактические ошибки в AI-черновиках.

Журналистика существует не потому, что нужно быстро собрать факты в один абзац. Она существует потому, что живой человек с опытом, источниками и точкой зрения способен найти историю там, где никто не ищет, задать неудобный вопрос и взять на себя ответственность за каждое слово. AI может имитировать структуру текста.

Он не может имитировать суждение. Ещё одна скрытая цена — репутационная. Когда выясняется, что материал написан или составлен машиной, доверие читателя к изданию падает — и восстанавливается крайне медленно.

CNET столкнулся с этим в 2023 году, когда выяснилось, что десятки финансовых материалов создавались AI без должного раскрытия. Редакция была вынуждена отозвать часть публикаций и ввести обязательную пометку. Урок оказался болезненным и дорогим.

Технологические компании, продающие инструменты для редакций, предпочитают другой язык. Они говорят об «ускорении рабочего процесса», «снижении когнитивной нагрузки», «помощи, а не замене». На практике граница между «помощью» и «заменой» размыта и постоянно сдвигается.

Сегодня AI пишет черновик новостной ленты. Завтра — аналитический обзор. Послезавтра — редакционную колонку с именем живого автора на обложке.

Показательна и реакция самих журналистов. В редакциях, где AI-инструменты внедряются без открытого обсуждения с командой, растёт скрытое сопротивление. Люди чувствуют, что их профессиональная идентичность размывается.

Когда твоя работа — редактировать чужой черновик, а не создавать свой, ты перестаёшь быть журналистом в полном смысле слова. Происходящее — не просто вопрос технологий или экономики. Это вопрос о том, чем является журналистика как институт.

Если редакции принимают AI-письмо как норму под давлением краткосрочных финансовых стимулов, они рискуют разрушить именно то, что отличает их от алгоритмических агрегаторов новостей. Читатель выбирает живые издания не за скорость — её давно выиграли боты. Он выбирает их за доверие, за голос, за суждение конкретного человека.

Это нельзя автоматизировать — и попытки сделать это незаметно рано или поздно становятся очевидными.